diffusers 文本生成图片怎么弄

-

【AIGC-文本/图片生成视频系列-9】MagicVideo-V2: 多阶段高美感视频生成

目录 一. 项目概述与贡献 二. 方法详解编辑 三. 文本生成视频相关结果 四. 与其他方法对比结果 五. 个人感悟 最近得益于扩散模型的快速发展,文本到视频(T2V)模型的激增。 今天要介绍的是字节的MagicVideo-V2,一个新颖的多阶段 T2V 框架,它集成了 文本到图像 (T2I)、图像

-

【兔子王赠书第8期】AI短视频制作一本通: 文本生成视频+图片生成视频+视频生成视频

1本书精通AI短视频制作,文本生成视频+图片生成视频+视频生成视频+AI短视频应用!高效视频制作技巧,助你快速成长为行业大咖! 《AI短视频制作一本通: 文本生成视频+图片生成视频+视频生成视频》 当当网链接:http://product.dangdang.com/29632771.html 京东的链接:https://item.jd

-

在线试用Stable Diffusion生成可爱的图片

https://inscode.csdn.net/@inscode/Stable-Diffusion 采样迭代次数设为80,生成批次和每批数量均设为4,其他均为默认参数。 下面先找几个stable diffusion内测时用到的提示词,来测试一下inscode的生成效果,然后再给一组相似的中文提示词,看一下二者的区别。 提示词1 英文提示词 sun and

-

自动生成文本内容怎么弄?推荐三个ai写作生成器

随着人工智能技术的不断发展,ai写作生成器已经成为一种越来越受欢迎的文本创作工具。这些ai写作生成器可以快速生成高质量的文章、新闻报道、产品描述等文本内容,帮助我们提高工作效率和文本创作质量。那么,ai写作生成器有哪些呢?在本文中,我将为大家介绍几款

-

React实现文本框输入文字内容动态给图片添加文字信息(多个)并生成新的图片

收到这个需求的时候,我的内心是崩溃的,脑子里已经跑过一万匹草泥马,内心想这种事为啥不交给ps去做,哪怕是手机里图片编辑也可以做到吧,专业的事交给专业的工具去干不就好了,何必出这种XX需求。后来想想就释然了,反正拿钱干活,干啥不是干,只要给钱,再XX的

-

Stable Diffusion 1 - 初识跑通 文字生成图片

A latent text-to-image diffusion model Stable Diffusion 是一个文本到图像的潜在扩散模型,由C

-

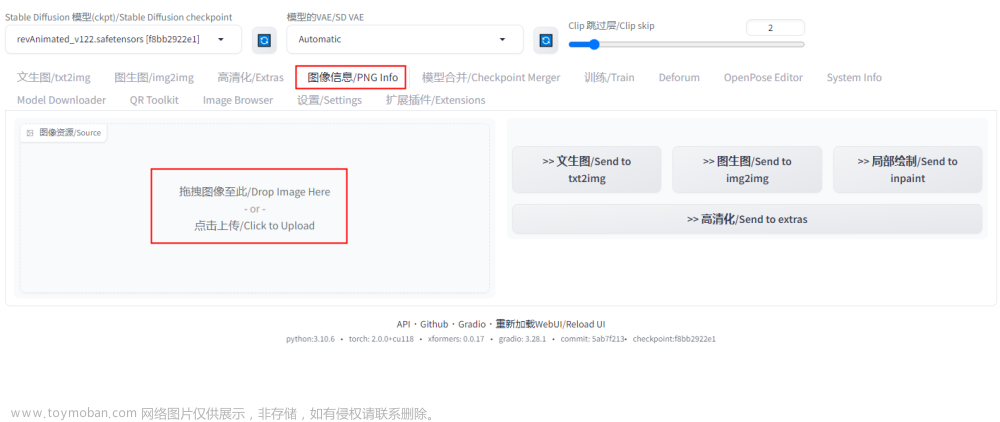

Stable Diffusion生成图片参数查看与抹除

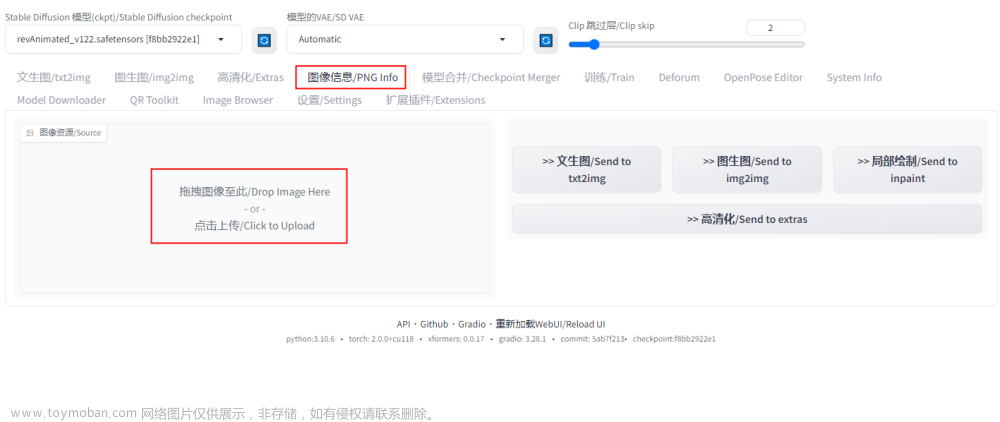

前几天分享了几张Stable Diffusion生成的艺术二维码,有同学反映不知道怎么查看图片的参数信息,还有的同学问怎么保护自己的图片生成参数不会泄露,这篇文章就来专门分享如何查看和抹除图片的参数。 1、打开Stable Diffusion WebUI,点击Tab菜单中的【图像信息/PNG Info】,不同版

-

Stable Diffusion 文字生成图片如何写提示词

Stable Diffusion是一种基于神经网络的技术,通过输入提示词来生成相应的图片。为了获得高质量的图片输出,您需要选择合适的提示词,并确保它们能够激发模型的想象力和创造力。 以下是一些编写提示词的建议: 确定主题:首先,确定您希望生成的图片的主题或内容。例如

-

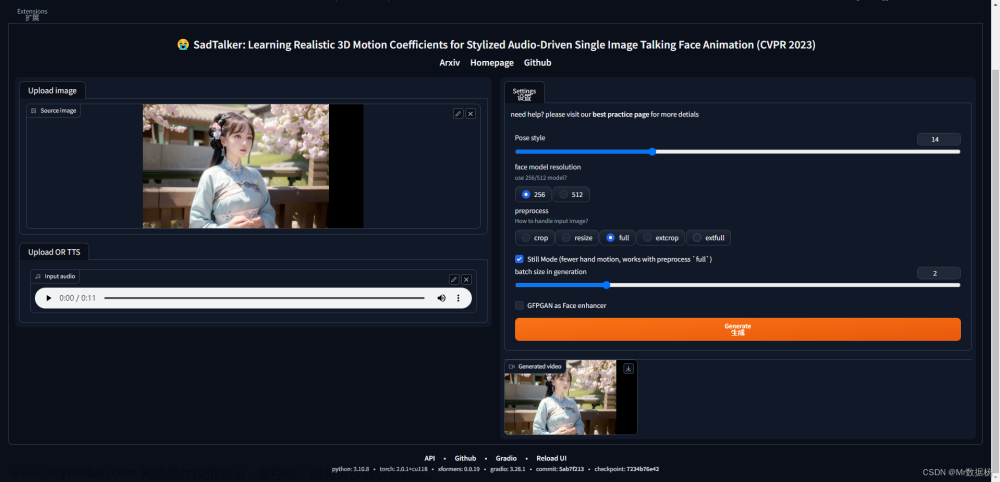

Stable Diffusion 使用 SadTalker 生成图片数字人

Heygen和D-ID等照片转视频的工具,都需要在线付费使用。本次介绍一个SadTalker数字人。SadTalker有多种使用方式,包括完整安装程序和stable diffusion插件模式。安装程序操作较繁琐,因此推荐stable diffusion插件模式。 打开SD进入扩展复制链接 https://github.com/OpenTalker/SadTalker.git 到安装

-

Python 使用 Stable Diffusion API 生成图片示例

代码: 输出: 说明: 运行后,图片以及 JSON 将会输出到当前目录下 output 中; TIP: 当然前提是你已经部署好 Stable Diffusion API 服务; 并且安装好跟我一样的模型以及一些相关的 LoRA ;

-

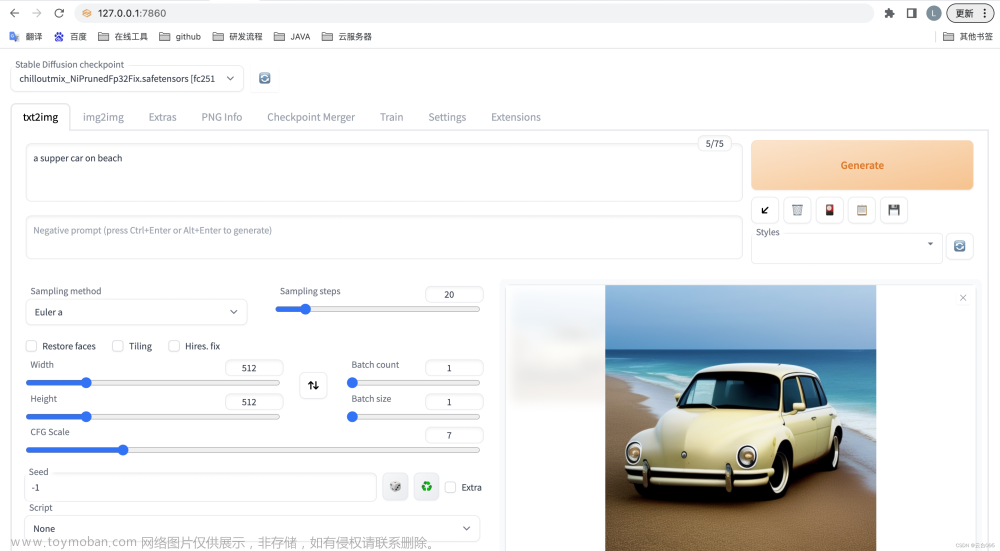

文字转图片生成系统-Stable diffusion稳定扩散模型

二话不说先上效果图:(附带代码和模型资源文件) 让它画一个超级汽车在海边。。 近期百度推出了文言一心, 一个能回答问题,能根据文字描述绘制图片的服务,前期可能不太完善出现了一些失误,不过这个idea还是相当不错的 这个东西挺好哈,作为文学创作,生成

-

AI图片生成Stable Diffusion环境搭建与运行

Stable Diffusion是一种基于扩散过程的生成模型,由Ge et al.在2021年提出。该模型利用了随机变量的稳定分布,通过递归地应用扩散过程来生成高质量的图像。与其他生成模型相比,Stable Diffusion在生成高质量的图像方面具有显着优势。具体而言,该模型所生成的图像具

-

优秀图片生成参数-stable-diffusion-webui

模型:chiloutmixni prompt: 前述:stable-diffusion好不好用,stable-diffusion V2好不好用? 请关注我的图像领域专栏,代码公开领域专栏。 (RAW photo, best quality), (realistic, photo-realistic:1.3), best quality ,masterpiece, an extremely delicate and beautiful, extremely detailed ,CG ,unity ,8k wallpaper, Amazing, finely detai

-

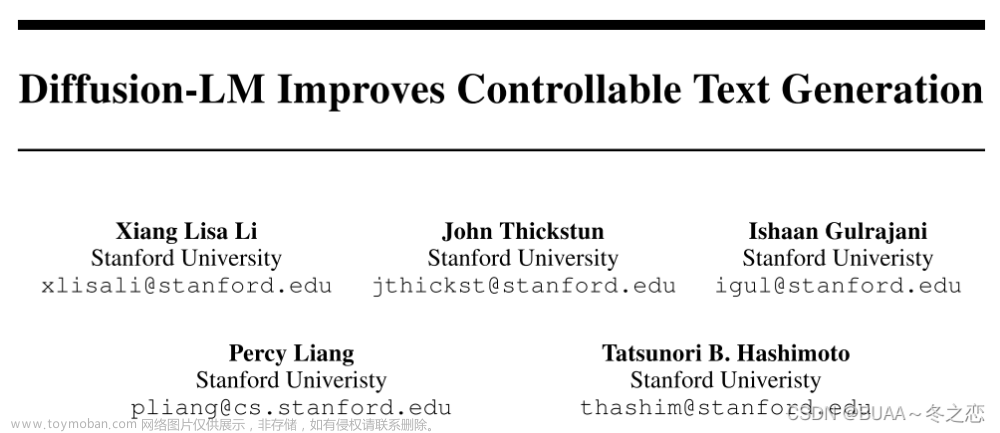

Diffusion-LM Improves Controllable Text Generation 扩散语言模型改善可控文本生成

论文链接:https://arxiv.org/abs/2205.14217 代码链接:https://github.com/XiangLi1999/Diffusion-LM 无需重训模型控制语言模型的表现是自然语言生成(NLG)的一个重要开放问题,近期工作已经在简单句子属性控制生成上取得了一定的进展,但是在复杂的、细粒度的控制上的进展还远远不够。

-

图片生成视频来了:Stable Video Diffusion使用教程

11月22日 Stability AI 发布了一个AI视频的开源项目:Stable Video Diffusion,它可以基于一张图片生成数秒钟的视频,效果比较惊艳,本文就给大家分享下如何安装和使用。 视频不方便分享,我这里做成了gif动图,可以看到画面很稳定,基本上是没有闪烁的。 这个程序对显卡的要求

-

LLM(大语言模型)解码时是怎么生成文本的?

transformers==4.28.1 源码地址:transformers/configuration_utils.py at v4.28.1 · huggingface/transformers (github.com) 文档地址:Generation (huggingface.co) 对于生成任务而言:text-decoder, text-to-text, speech-to-text, and vision-to-text models,有以下几种生成的方法: greedy decoding by calling [ ~generation.GenerationMixin.gre

-

Stable Diffusion生成图片的参数查看与抹除方法

1、打开Stable Diffusion WebUI,点击Tab菜单中的【图像信息/PNG Info】,不同版本的WebUI可能显示的文字或略有不同。 2、在左侧选择本地的一张图片,如果是Stable Diffusion生成的图片,我们可以在右边看到图片的生成参数,依次是:提示词、反向提示词、模型详细参数。 我们还可

-

AI图片生成Stable Diffusion参数及使用方式详细介绍

Stable Diffusion环境搭建与运行请参考上一篇博文《AI图片生成Stable Diffusion环境搭建与运行》,地址为“https://blog.csdn.net/suiyingy/article/details/128896426”。运行成功后,网页浏览器显示页面主要包括txt2img、img2img、Extras、PNG Info、Checkpoint Merger、Train、Settings和Extensions等八

-

仅做笔记用:Stable Diffusion 获取历史生成图片的 prompt

不知怎么搞的,图库浏览器点开图片看不到生成图片的信息了。但是据信这些信息是写在 PNG 数据的某个附加区段的(参考博客文章《Python - PNG图掺入隐藏文本信息》)。Stable Diffusion 原生支持读取这些信息。并且除了图库浏览器,还有一个地方可以读取。 从资源管理器里面

-

Stable Diffusion 图片生成AI模型 Windows Mac部署指南

Stable Diffusion是2022年发布的深度学习文本到图像生成模型。它主要用于根据文本的描述产生详细图像,它也可以应用于其他任务,如内补绘制、外补绘制,以及在提示词(英语)指导下产生图生图的翻译。 DreamStudio 现已推出了 Stable Diffusion XL Preview 版本,你可以在官方画抢