日志分析系统ELK搭建

ELK

ELK是日志收集、索引与检索三件套,包含了三个组件

- ElasticSearch

- Logstash

- Kibana

其中ElasticSearch完成日志的索引,并提供查询接口,Logstash完成日志的收集,Kibana则提供可视化展示

有了ELK,我们不再需要到线上的每一台机器上grep日志,而且能可视化查询任何你想查询的日志信息。通过Kibana能非常直接漂亮的展示很多信息,ELK还能作为监控系统使用。先看看效果图:

image.png

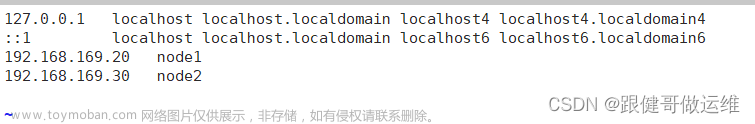

机器要求

三台机器,机器的配置视线上日志量而定

ES集群:三台机器

Logstash:一台机器

Kibana:一台机器

其中一台机器不存储ES数据,这台机器同时安装了ES、Logstash和Kibana

架构

系统架构图如下

image.png

- Shipper安装在每一台需要收集日志的客户机上,即需要在每一台客户机上安装logstash

- Redis作为中转

- Indexer安装在服务器上

- Kibana提供可视化展示

软件版本

ElasticSearch:5.0.2

Logstash:5.1.1

Kibana:5.0.2

1. Java

1.1 Java版本要求

java版本要求为1.8+,最低版本为1.8

1.2 Centos Java版本升级

查看java版本

java -version

如果版本号达不到要求则需要升级java版本

1.2.1 下载java 1.8 jdk

前往地址http://www.oracle.com/technetwork/java/javase/downloads/jdk8-downloads-2133151.html

下载tar.gz结尾的jdk文件进行下载

1.2.2 上传至服务器

使用rz命令将下载的jdk8上传到服务器的/usr/lib/jvm 目录下

使用命令解压

tar -xzf jdk-8u111-linux-x64.tar.gz

1.2.3 加入到alternatives列表中

alternatives --install /usr/bin/java java /usr/lib/jvm/jdk1.8.0_111/bin/java 400

1.2.4 更改java版本号

alternatives --config java

选择java 8对应的序号即可。

1.2.5 查看java版本号

1.2.6 卸载系统自带jdk

如果不卸载会致使elasticsearch没法运行

详见:http://linux.it.net.cn/CentOS/server/set/2014/1006/6242.html

2. 安装Elasticsearch

切记不要以root身份安装

安装教程:https://www.elastic.co/guide/en/elasticsearch/reference/5.0/zip-targz.html

选择通过tar.gz文件安装

启动elasticsearch时遇到三种类型的错误(WARN):

-

log文件写入无权限,解决办法:root用户下chmod加权限

-

CONFIG_SECCOMP and CONFIG_SECCOMP_FILTER,可以忽略,不影响启动

-

max file descriptors,root用户下修改配置文件vim /etc/security/limits.conf,将soft nofile和hard nofile的值全部改为65536,保存推出,重新登录

-

max virtual memory,root用户下执行命令sysctl -w vm.max_map_count=262144

java.lang.UnsupportedOperationException: seccomp unavailable: requires kernel 3.5+ with CONFIG_SECCOMP and CONFIG_SECCOMP_FILTER compiled in

at org.elasticsearch.bootstrap.Seccomp.linuxImpl(Seccomp.java:349) ~[elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Seccomp.init(Seccomp.java:630) ~[elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.JNANatives.trySeccomp(JNANatives.java:215) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Natives.trySeccomp(Natives.java:99) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Bootstrap.initializeNatives(Bootstrap.java:104) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Bootstrap.setup(Bootstrap.java:158) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Bootstrap.init(Bootstrap.java:291) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:121) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Elasticsearch.execute(Elasticsearch.java:112) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.cli.SettingCommand.execute(SettingCommand.java:54) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.cli.Command.mainWithoutErrorHandling(Command.java:96) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.cli.Command.main(Command.java:62) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:89) [elasticsearch-5.0.2.jar:5.0.2]

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:82) [elasticsearch-5.0.2.jar:5.0.2]**** ERROR: bootstrap checks failedmax file descriptors [65535] for elasticsearch process is too low, increase to at least [65536]

max virtual memory areas vm.max_map_count [65530] is too low, increase to at least [262144]

解决完上述问题后退出重新以普通用户身份登录,重新启动elasticsearch

浏览器访问http://ip:port/

这里的ip和port是在ElasticSearch的配置文件中配置的

访问效果如下:

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-eCxcdWE4-1660618941750)(//upload-images.jianshu.io/upload_images/6087407-0c1ad36fa91fae9b.png?imageMogr2/auto-orient/strip%7CimageView2/2/w/700)]

image.png

ElasticSearch集群配置

参考https://my.oschina.net/shyloveliyi/blog/653751

可以在同一台机器上的不同节点配置集群,也可以在不同机器上配置集群,测试中采用的是后一种方式。

实际的配置如下:

cluster.name: es-cluster

node.name: node0

path.data: /tmp/elasticsearch/data

path.logs: /tmp/elasticsearch/logs

network.host: ***

http.port: 9200

discovery.zen.ping.unicast.hosts: ["***"]

该配置说明如下:

- cluster.name,集群名,同一个集群下配置同一个名字

- node.name,节点名,同一个集群下不同节点配置不同的名称

- path.data,数据存储目录,生产环境中需要指定一个容量比较大的磁盘

- path.logs,日志存储目录

- network.host,本机ip

- http.port,默认为9200

- discovery.zen.ping.unicast.hosts,集群中其他机器的ip地址

配置完毕后重启ES,另一台机器上配置类似后重启,ES即可自动发现。

访问http://ip:port/_cat/health?v查看集群状态

image.png

node.total=2表示集群中有两个节点

集群配置完毕后,集群间的数据是共享的。即使其中任何一台机器挂了,通过另一台机器也能访问全部的数据。

查看集群master状态

http://ip:port/_cat/master?pretty

ElasticSearch删除索引

使用命令

curl -XDELETE 'http://ip:port/logstash-2016.12.12?pretty'

其中logstash-2016.12.12为索引名

查看ElasticSearch所有索引

http://ip:port/_cat/indices

ES后台运行

一般来说我们不希望关闭终端时,ES进程中止,这时需要以后台运行的方式运行ES

./elasticsearch -d

安装xpack

链接https://www.elastic.co/downloads/x-pack

按照教程来就行,如果下载比较慢,可以先下载到本地然后上传到服务器。

使用本地文件安装的命令:

./elasticsearch-plugin install file:///search/odin/xpackfilename

注意:安装完xpack后会导致访问es需要认证,可以在配置文件中将其关闭,在elasticsearch.yml中添加如下配置

# x-pack

xpack.security.enabled: false

xpack.monitoring.enabled: true

xpack.graph.enabled: false

xpack.watcher.enabled: false

重启es即可

3. 安装logstash

logstash要求java版本为1.8及以上

安装过程为下载tar.gz文件后上传至服务器

3.1 配置文件

在logstash的config同级目录下新建etc文件夹用于存放配置文件,新建配置文件es-test.conf,内容如下:

input

{

file

{

path =>"/home/contentdev/elk/test.log"

}

}

output

{

elasticsearch{

hosts => ["ip:port"]

index => "logstash-%{type}-%{+YYYY.MM.dd}"

}

}

具体的释义见https://www.elastic.co/products/logstash

大致解释如下:

- input:从指定的文件中读取内容

- output:存储至指定的es中,index为索引名,自定义

3.2 测试配置文件语法是否正确

执行命令:

./logstash -t -f ../etc/es-test.conf

测试过程中可能遇到如下错误:

Could not find any executable java binary. Please install java in your PATH or set JAVA_HOME.

使用命令打印出JAVA_HOME的值:

echo $JAVA_HOME

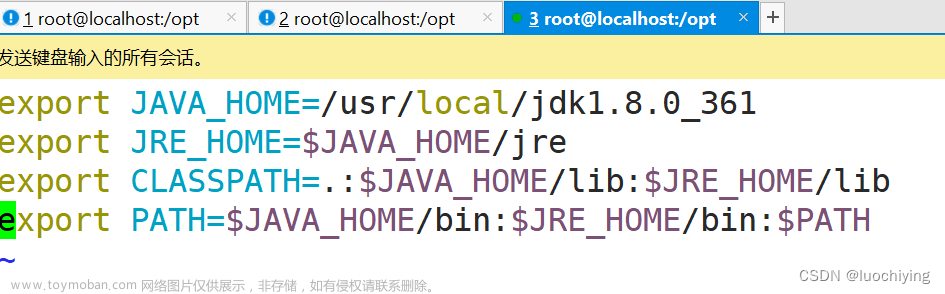

看看是否正确,如果不正确,则切换到root角色登录,修改配置文件/etc/profile,在末尾设置JAVA_HOME

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_111

export PATH=$PATH:$JAVA_HOME/bin

设置完后执行命令

source /etc/profile

重新以普通用户的身份登录,再次执行测试命令即可

3.3 正式启动logstash

以后台执行的方式启动

nohup ./logstash -f ../etc/redis-test.conf --config.reload.automatic &

3.4 写入测试数据

向/home/contentdev/elk/test.log中写入测试数据

3.5 访问elasticsearch

访问elasticsearch验证数据是否被存储

http://ip:port/_search?pretty

3.6 使用grok解析日志

关于logstash中的grok插件正则表达式的例子详见:http://blog.csdn.net/liukuan73/article/details/52318243

3.7 服务端logstash配置文件

服务端的logstash可能需要从redis中读取多个key的日志信息存储到不同的ES索引中,这时可以在配置文件中使用type来表示。

input

{

redis { type => "A-nginx-log" host => "***" port => ** password => "***" data_type => "list" key => "A_nginx_log"}

redis { type => "B-nginx-log" host => "***" port => *** password => "***" data_type => "list" key => "B_nginx_log" }

}

output

{

elasticsearch{

hosts => ["ip:port"]

index => "%{type}-%{+YYYY.MM.dd.HH}"

}

}

最终的索引名会包含type,ES的索引名最好能包含日期,这样方便归类以及按日期删除

elasticsearch中的hosts最好是配置为不存储数据的那台机器。

3.8 安装xpack

安装命令跟es安装xpack类似,安装完毕后需要在配置文件logstash.yml最后加上一行

xpack.monitoring.elasticsearch.url: "http://**:9200"

4. 安装kibana

安装流程详见:https://www.elastic.co/guide/en/kibana/current/targz.html

安装完毕后需要配置config下的kibana.yml配置文件,配置一下几项即可:

- server.port:5601,打开注释即可

- server.host,配置本机ip,启动后可以通过ip+端口访问

- elasticsearch.url,配置es的域名(ip)+端口

- kibana.index,打开注释即可

image.png

4.1 启动kibana

cd到bin目录,执行下面的命令

nohup ./kibana &

4.2 访问web页面

http://ip:port/

如果es中已经存在index,kibana会自动展示出来

4.3 安装xpack

同elasticsearch安装xpack教程一样

安装完毕后即可在左侧看到monitoring等新面板

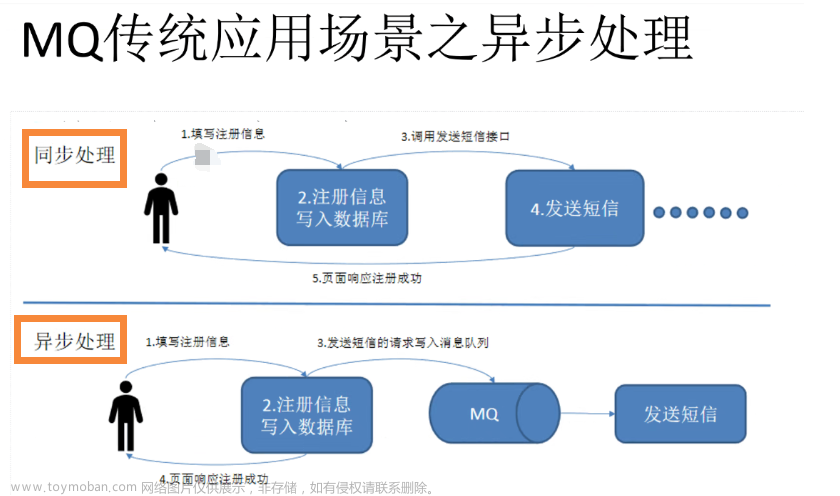

5. Redis

Redis在ELK系统中可以扮演两种角色:消息订阅和消息中转。Redis存在的意义是为了解决log写入ES的瓶颈。

- 消息订阅。自行google

- 消息中转。该模式下,shipper将日志内容写入到redis中,indexer从redis中读取并存入ES

本次搭建采用第二种模式。需要说明的是,indexer从redis中读取相应的数据后会将其删除,不会导致redis中数据的堆积

6. ELK系统监控与报警

ELK系统可能出现的问题

-

进程死亡

-

ES进程死亡,如果是logstash indexer写入的机器ES进程死亡,会导致数据无法存入ES,但不清楚redis中的数据能否被正常消耗

-

解决办法:

脚本定时检查ES进程是否存活,死亡则邮件报警

-

-

logstash shipper进程死亡,会导致客户机的日志无法被收集

-

解决办法:

脚本定时检查进程是否存活

-

-

logstash indexer进程死亡,会导致redis中暂存的数据堆积,撑爆redis

- 解决办法:

- 脚本定时检查ES进程是否存活,死亡则邮件报警

- redis用量预警,如果系统运行正常,redis的用量应该是在一个比较稳定的数值,异常时会导致redis用量激增

- 解决办法:

-

-

机器宕机

- 检查redis用量

-

ES数据存储磁盘空间不足

- 使用监控脚本监控磁盘用量并配置报警

总的来说,系统异常可以通过以下方式发现

- 脚本检查进程存活状态

- redis用量是否正常

- 监控脚本上报磁盘使用量

7. ES数据定期删除

如果不删除ES数据,将会导致ES存储的数据越来越多,磁盘满了之后将无法写入新的数据。这时可以使用脚本定时删除过期数据。

#/bin/bash

#es-index-clear

#只保留15天内的日志索引

LAST_DATA=`date -d "-15 days" "+%Y.%m.%d"`

#删除上个月份所有的索引

curl -XDELETE 'http://ip:port/*-'${LAST_DATA}'*'

可以视个人情况调整保留的天数,这里的ip和port同样设置为不存储数据的那台机器。该脚本只需要在ES中一台机器定时运行即可。

crontab -e添加定时任务:

0 1 * * * /search/odin/elasticsearch/scripts/es-index-clear.sh

每天的凌晨一点清除索引。

8. 其他

- 存储到ES的数据会有一个字段名为@timestamp,该时间戳和北京时间差了8小时,不需要进行调整,Kibana在展示的时候会自动加上8小时

作者:冰火人生

链接:https://www.jianshu.com/p/5e0ed65cd820

來源:简书

简书著作权归作者所有,任何形式的转载都请联系作者获得授权并注明出处。文章来源:https://www.toymoban.com/news/detail-404291.html

。文章来源地址https://www.toymoban.com/news/detail-404291.html

到了这里,关于elasticsearch定期删除策略 - 日志分析系统ELK搭建的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[ELK] ELK企业级日志分析系统](https://imgs.yssmx.com/Uploads/2024/01/810686-1.png)