问题描述

问题:

es容器自己停止,重启之后启动失败,报错如下:

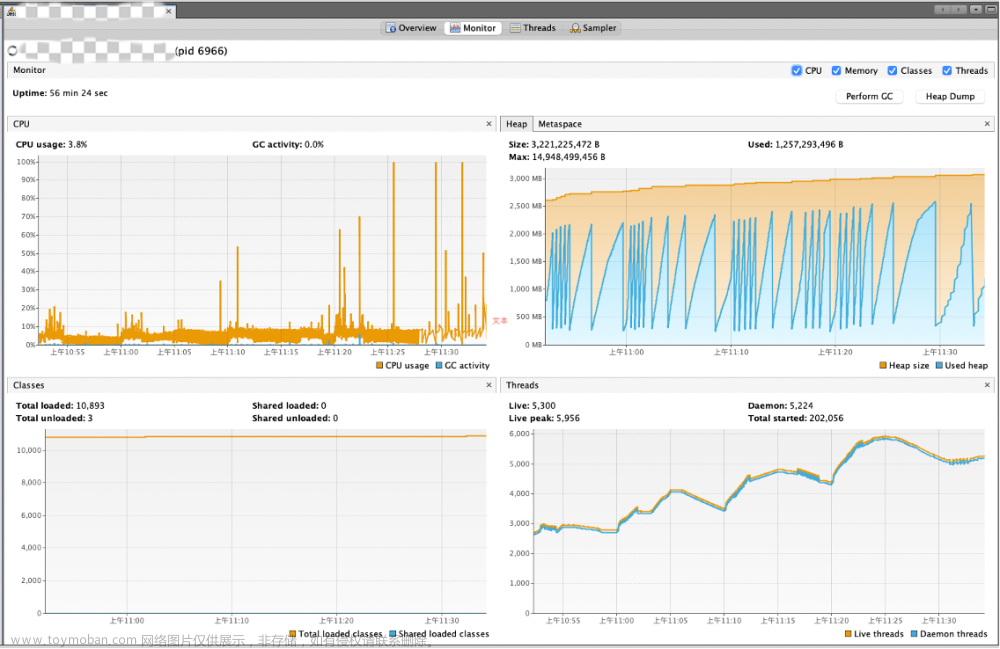

java.lang.OutOfMemoryError: Java heap space:

Unable to create data/java_pid6.hprof: File exists

Terminating due to java.lang.OutOfMemoryError: Java heap space

原因分析

原因:

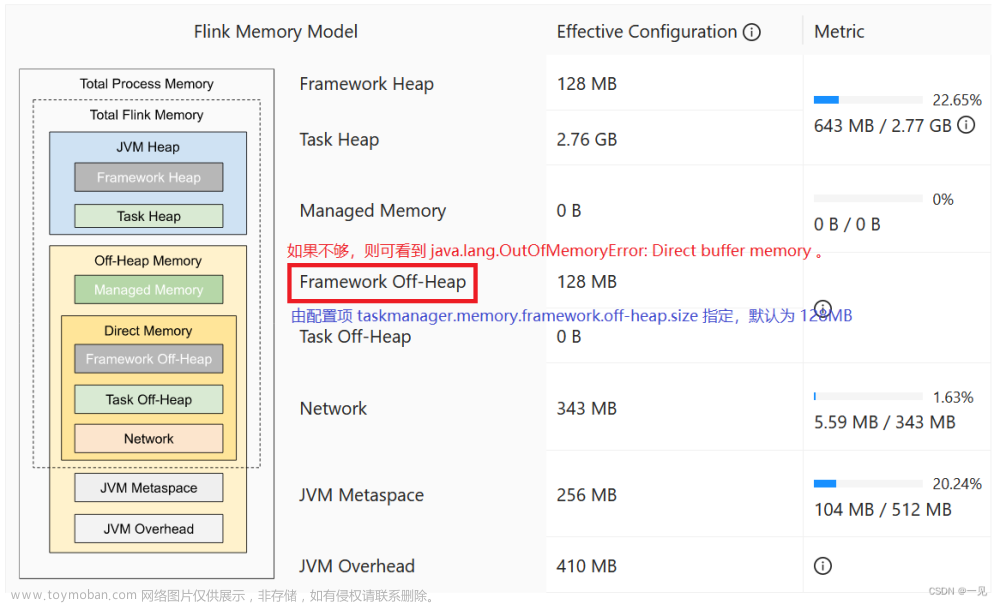

容器中es由于数据量过大,超过了elasticsearch进程的最大内存量,elasticsearch 会将启动脚本中的JAVA_OPTS 选项传递给 JVM 来启动elasticsearch. 其中最重要的一个参数是 -Xmx ,此参数用于控制系统分配给elasticsearch 进程的最大内存量。另外 -Xms用于控制系统分配给elasticsearch进程的最小内存量(通常情况下,分配的内存越多越好)

解决方案

解决办法:

[root@localhost]# docker run -d \

--name es7.17.4 -p 9200:9200 -p 9300:9300 \

-e "discovery.type=single-node" -e ES_JAVA_OPTS="-Xms64m -Xmx128m" \

-v /var/lib/docker/volumes/es-data/_data:/usr/share/elasticsearch/data \

-v /var/lib/docker/volumes/es-plugins:/usr/share/elasticsearch/plugins \

-v /var/lib/docker/volumes/es-config/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml \

--privileged \

--network es-net \

elasticsearch:7.17.4

将其中的: -e ES_JAVA_OPTS="-Xms64m -Xmx128m" \这个配置中的内存大小改大,我的直接全部改成512.问题解决。

其他可能

1.读取过多的数据到内存,尤其是field data字段(在使用sorting和aggregations)

2.配置出错,设置的heap size没有生效,可能是设置错地方了。默认的heap size(min 256M,max 1G)是不够用的。

3.做索引的数据过多,比如bulk size设置过大

4.查询时,要求返回的数据量太大(size设置过大)

5.主节点的内存不够用,这种情况下可能是由于cluster state引起的。若索引使用大量的别名(alias),cluster state就会使用大量的内存。

其他解决方案

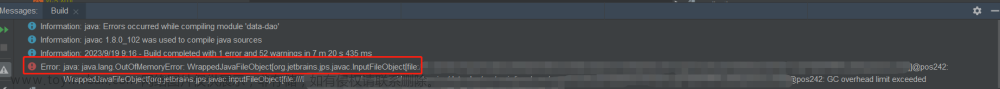

修改ES的配置文件,增大ES的JVM的Heap Size大小,默认是1G的启动内存。我们可以根据自己的机器情况,适当增加。修改容器内的config目录下jvm.options文件,但有一个问题是你容器启动不了没办法进入容器修改这个文件,除非你提前挂载出来了。 文章来源:https://www.toymoban.com/news/detail-413455.html

文章来源:https://www.toymoban.com/news/detail-413455.html

两种解决方案大家都试试,万一好了呢.文章来源地址https://www.toymoban.com/news/detail-413455.html

到了这里,关于es内存溢出启动报错java.lang.OutOfMemoryError: Java heap space的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!