问题描述:

1、使用A30显卡,使用分布式并行Distributed Data Parallel,运行程序时显卡显存充满,卡在设置local_rank处,并未启动进程组

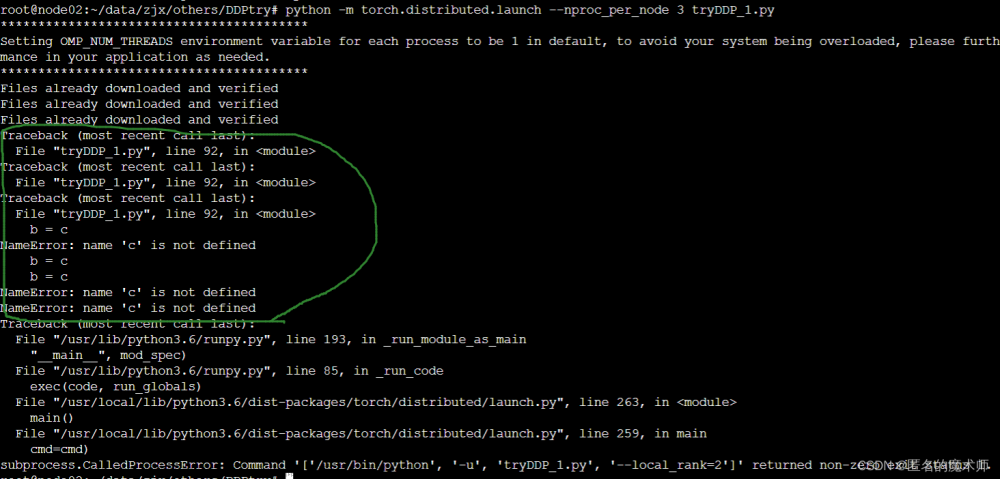

2、如图:

解决方案:

0、最新解决方案,针对Supermicro主板:BIOS->Advanced->NB Configuration->IOMMU->Disabled

==其它型号的主板的BIOS可能还需要禁用ACS:

https://zhuanlan.zhihu.com/p/607203976

https://www.supermicro.com/support/faqs/faq.cfm?faq=20264

https://www.supermicro.com/support/faqs/faq.cfm?faq=22226

后面的1-4可不看了~

1、更换后端为“Gloo”,正常执行shell命令运行程序。

torch.distributed.init_process_group(backend="Gloo")

python -m torch.distributed.launch --nproc_per_node=7 --master_port 8888 main.py

2、仍旧使用“NCCL”后端,但需要更改环境变量,在shell命令前加入禁用P2P。

torch.distributed.init_process_group(backend="NCCL")

NCCL_P2P_DISABLE=1 python -m torch.distributed.launch --nproc_per_node=7 --master_port 8888 main.py

3、仍旧使用“NCCL”后端,但需要更改环境变量,永久更改环境设置,正常执行shell命令运行程序。

torch.distributed.init_process_group(backend="NCCL")

vim ~/.bashrc

export NCCL_P2P_DISABLE=1

source ~/.bashrc.

python -m torch.distributed.launch --nproc_per_node=7 --master_port 8888 main.py

4、建议使用第3个方案,据我测试,Gloo后端没有NCCL后端通信速度快,程序运行速度NCCL较快。另外,每次加上修改环境变量的命令也挺烦的,修改bash环境变量一劳永逸。

bug分析:

NCCL_P2P_DISABLE=1将禁用GPU之间直接通信(如使用NVlink或者PCIe),鉴于NVDIA官网显示A30支持NVlink或者PCIe,因此判断可能是硬件故障或者是软件版本不匹配导致P2P通信受阻,使得进程阻塞,程序挂起。文章来源:https://www.toymoban.com/news/detail-413937.html

参考:

1:https://zhuanlan.zhihu.com/p/60054075

2:https://github.com/pytorch/pytorch/issues/23074文章来源地址https://www.toymoban.com/news/detail-413937.html

到了这里,关于Pytorch 分布式并行DDP 卡死 挂起的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!