大家好,我是herosunly。985院校硕士毕业,现担任算法研究员一职,热衷于机器学习算法研究与应用。曾获得阿里云天池比赛第一名,CCF比赛第二名,科大讯飞比赛第三名。拥有多项发明专利。对机器学习和深度学习拥有自己独到的见解。曾经辅导过若干个非计算机专业的学生进入到算法行业就业。希望和大家一起成长进步。文章来源:https://www.toymoban.com/news/detail-419730.html

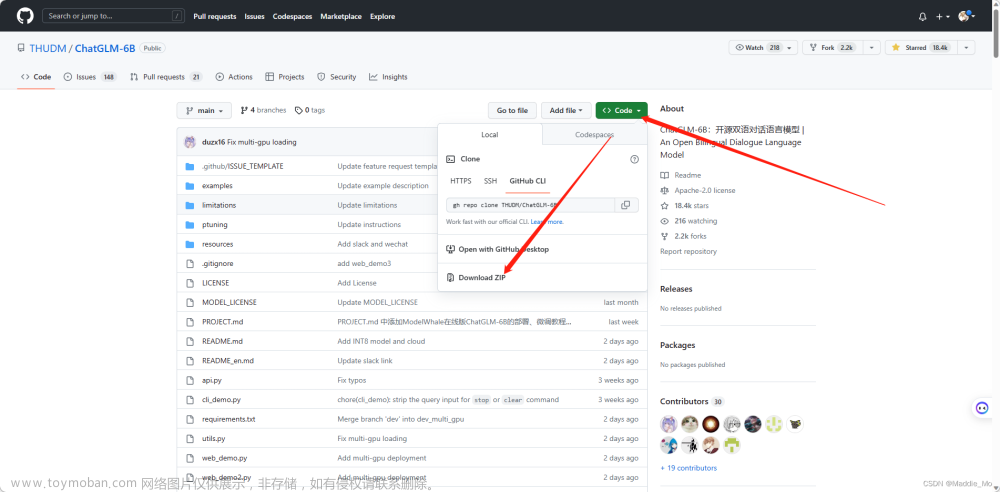

本文主要介绍了ChatGLM本地部署应用的实战方案,希望对学习大语言模型的同学们有所帮助。 文章来源地址https://www.toymoban.com/news/detail-419730.html

文章来源地址https://www.toymoban.com/news/detail-419730.html

到了这里,关于ChatGLM本地部署应用的实战方案的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!