大家都是希望让预训练语言模型和下游任务靠的更近,只是实现的方式不一样。Fine-tuning中:是预训练语言模型“迁就“各种下游任务;Prompting中,是各种下游任务“迁就“预训练语言模型。

区别与联系

微调(fine-tuning)和prompt是自然语言处理领域中常用的两个术语,它们都是指训练和生成语言模型的过程中使用的技术。

区别

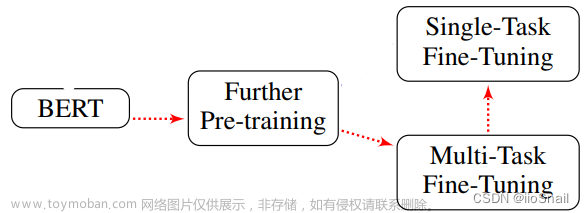

微调是指在已有的预训练语言模型基础上,通过少量的数据来对模型进行进一步的训练,使得模型能够更好地适应新的任务或领域。微调的目的是利用已有的语言模型,尽量减少训练新模型的时间和资源消耗。因此,微调是一种快速迁移学习的方法。

而prompt是指为了训练特定类型的语言模型而设计的一系列文本或代码提示。prompt可以看作是一种能够帮助语言模型更好地理解特定任务或领域的“指令”。prompt通常包括一个问题、任务描述或预定义的文本片段,用于指导模型生成合适的文本结果。融入了Prompt的新模式大致可以归纳成”pre-train, prompt, and predict“。在该模式中,下游任务被重新调整成类似预训练任务的形式。例如,通常的预训练任务有Masked Language Model,在文本情感分类任务中,对于 “I love this movie.” 这句输入,可以在后面加上prompt “The movie is ___” 这样的形式,然后让PLM用表示情感的答案填空如 “great”、“fantastic” 等等,最后再将该答案转化成情感分类的标签,这样以来,通过选取合适的prompt,我们可以控制模型预测输出,从而一个完全无监督训练的PLM可以被用来解决各种各样的下游任务。

联系

微调和prompt都是针对自然语言处理任务的训练技术,用于提高模型的性能。微调通常用于改进模型的通用性,以便将预训练模型适应到新的任务或领域,而prompt通常用于指导模型在特定任务上的表现。

在某些情况下,微调和prompt也可以一起使用,即使用预训练语言模型进行微调,并通过定义适当的prompt来指导模型生成合适的文本结果。这种方法可以提高模型在特定任务上的性能,并减少针对该任务的训练时间和资源消耗。

优缺点

微调的优点

可以快速迁移学习:利用已有的预训练模型,可以快速迁移学习到新的任务或领域中。

可以减少训练时间和资源消耗:微调只需要使用少量的数据对模型进行进一步训练,可以显著减少训练时间和资源消耗。

微调的缺点

可能存在过拟合问题:在微调过程中,可能会因为过度拟合而导致模型的泛化性能下降。

需要适当的数据量和质量:微调需要使用足够数量且高质量的数据来训练模型,否则可能会影响模型的性能。

prompt的优点

可以帮助模型更好地理解任务和领域:prompt可以为模型提供指导性信息,帮助模型更好地理解任务和领域,从而提高模型的性能。

可以缩短训练时间:prompt可以有效减少训练时间,因为它可以提供更加准确的指导信息,帮助模型更快地学习到任务和领域的规律。

prompt的缺点

需要设计合适的prompt:为了获得良好的模型性能,需要精心设计合适的prompt,这需要一定的人工成本和专业知识。

可能存在过拟合问题:如果prompt设计得不好或者过于复杂,可能会导致模型在训练集上表现良好,但在测试集上表现不佳的过拟合问题。

在CV领域

在CV领域中,Prompt其实可以理解为图像label的设计,从这个角度看,Prompt(预测文本中mask的字符,类似完形填空)其实是介于Image caption(迭代预测出每一个字符)和one-hot label(one-hot可以认为是prompt的特例,单字符通过text encoder编码成one-hot)之间的任务。文章来源:https://www.toymoban.com/news/detail-425825.html

Reference

如何看待NLP领域最近比较火的prompt,能否借鉴到CV领域?

NLP新宠——浅谈Prompt的前世今生文章来源地址https://www.toymoban.com/news/detail-425825.html

到了这里,关于一分钟搞懂 微调(fine-tuning)和prompt的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!