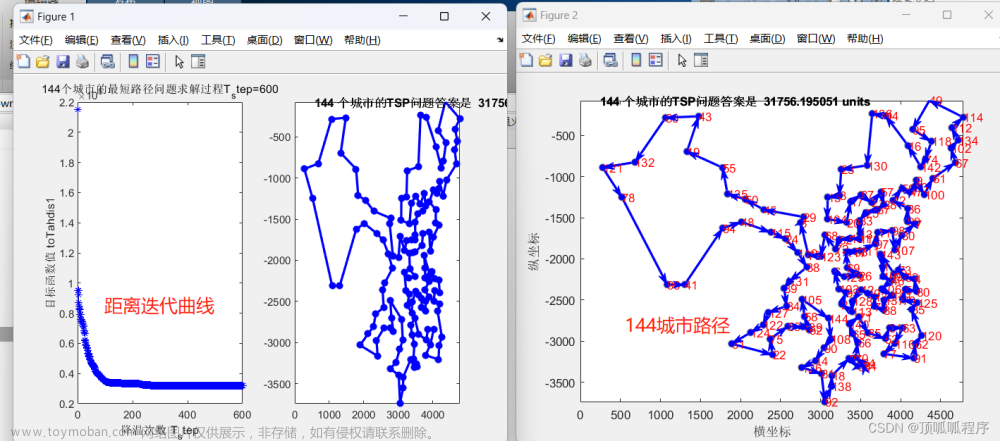

一、模拟退火算法

模拟退火算法是一种全局优化算法,解决的问题通常是找到一个最小化(或最大化)某个函数的全局最优解。它通过模拟物理退火的过程来搜索解空间,在开始时以一定的温度随机生成初始解,然后一步步降低温度,同时在当前解的周围随机搜索新的解,并根据一定概率接受更差的解,从而有可能跳出局部最优解,最终得到全局最优解。

下面我们来看一个简单的示例,假设要求解目标函数 f(x,y)=sin(10x)+cos(3y)的全局最小值,取 −2≤x≤2,−1≤y≤1 作为搜索范围。我们可以使用以下代码来实现:

import math

import random

# 定义目标函数

def objective_function(x, y):

return math.sin(10*x) + math.cos(3*y)

# 定义模拟退火算法

def simulated_annealing(initial_temperature, cooling_rate, num_iterations):

# 设置初始解和初始温度

current_solution = [random.uniform(-2, 2), random.uniform(-1, 1)]

current_energy = objective_function(current_solution[0], current_solution[1])

current_temperature = initial_temperature

# 迭代固定次数

for i in range(num_iterations):

# 根据当前温度随机生成新的解

new_solution = [current_solution[0] + 0.1*random.uniform(-1, 1),

current_solution[1] + 0.1*random.uniform(-1, 1)]

new_energy = objective_function(new_solution[0], new_solution[1])

# 计算能量差

delta_energy = new_energy - current_energy

# 如果新解更优,则接受它

if delta_energy < 0:

current_solution = new_solution

current_energy = new_energy

# 否则以一定概率接受更差的解

else:

probability = math.exp(-delta_energy / current_temperature)

if random.uniform(0, 1) < probability:

current_solution = new_solution

current_energy = new_energy

# 降低温度

current_temperature *= cooling_rate

return current_solution, current_energy

# 设置初始温度、冷却速率和迭代次数

initial_temperature = 100

cooling_rate = 0.95

num_iterations = 1000

# 运行模拟退火算法

best_solution, best_energy = simulated_annealing(initial_temperature, cooling_rate, num_iterations)

# 输出结果

print("全局最优解:", best_solution)

print("全局最优值:", best_energy)

在这个示例中,我们使用了 objective_function 函数来定义目标函数。然后定义了 simulated_annealing 函数来实现模拟退火算法的核心部分,其中参数 initial_temperature 代表初始温度、cooling_rate 代表每迭代一次温度降低的比率、num_iterations 代表迭代次数。在 simulated_annealing 函数中,我们使用了当前温度和能量差来决定是否接受新的解,以及在新解较差时是否接受,这些都是模拟退火算法的核心步骤。

最后,我们设置了初始温度、冷却速率和迭代次数,并调用 simulated_annealing 函数运行模拟退火算法,得到了全局最优解和最优值,并将它们输出到控制台上。可以通过多次运行调整参数,得到更精确的结果。

二、遗传算法

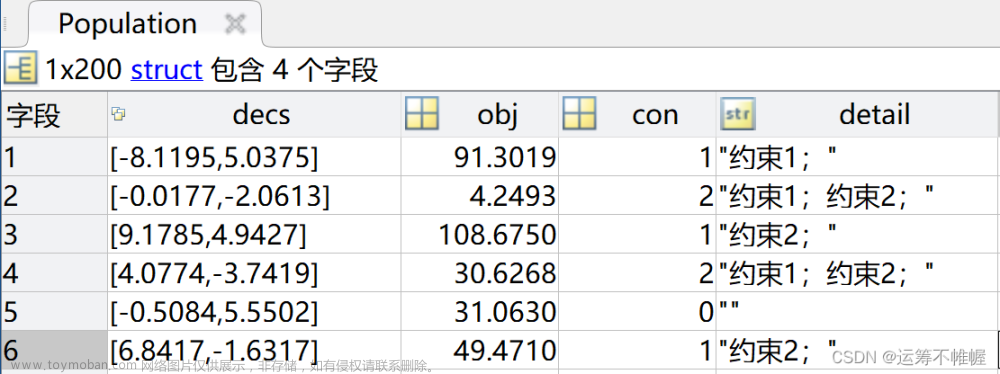

如果有多个目标函数,可以使用多目标函数优化算法。其中一个比较常用的算法是 NSGA-II(Non-dominated Sorting Genetic Algorithm II),它是一种利用遗传算法求解多目标优化问题的算法。

NSGA-II 算法的核心思想是通过维护一个帕累托前沿面来寻找非支配解,然后对这些解进行选择和交叉操作,生成下一代种群。具体的步骤如下:

- 初始化种群,并计算每个个体的适应度值以及帕累托等级和拥挤距离。

- 进行帕累托排序,将种群中所有个体按照帕累托等级从小到大排序,相同等级的个体再按照拥挤距离从大到小排序。

- 选择一部分高质量的个体作为父代,并进行交叉和变异操作,生成下一代种群。

- 重复以上步骤,直到满足停止条件。

下面是一个使用 Python 实现 NSGA-II 算法解决多目标问题的示例代码:

import random

import copy

# 定义目标函数

def objective_function(population):

fitness = []

for x in population:

obj_1 = pow(x[0], 2)

obj_2 = pow(x[0]-2, 2) + pow(x[1], 2)

# 将两个目标函数值合并成一个列表

fitness.append([obj_1, obj_2])

return fitness

# 定义帕累托排序

def pareto_ranking(fitness):

n = len(fitness)

p = []

rank = [0] * n

S = [[] for i in range(n)]

F = [[] for i in range(n+1)]

for i in range(n):

S[i] = []

rank[i] = 0

for j in range(n):

if i != j:

if fitness[i][0] <= fitness[j][0] and fitness[i][1] <= fitness[j][1]:

if j not in S[i]:

S[i].append(j)

elif fitness[j][0] <= fitness[i][0] and fitness[j][1] <= fitness[i][1]:

rank[i] += 1

if rank[i] == 0:

F[0].append(i)

i = 0

while len(F[i]) > 0:

Q = []

for j in range(len(F[i])):

p_j = F[i][j]

for k in range(len(S[p_j])):

q = S[p_j][k]

rank[q] -= 1

if rank[q] == 0:

Q.append(q)

i += 1

F[i] = copy.deepcopy(Q)

del F[len(F)-1]

for f in F:

for x in f:

p.append(x)

return p

# 定义拥挤距离

def crowding_distance(fitness, indices):

n = len(indices)

distance = [0.0] * n

for m in range(2):

sorted_indices = sorted(indices, key=lambda x:fitness[x][m])

distance[sorted_indices[0]] = float('inf')

distance[sorted_indices[n-1]] = float('inf')

for i in range(1, n-1):

distance[sorted_indices[i]] += (fitness[sorted_indices[i+1]][m] - fitness[sorted_indices[i-1]][m])

return distance

# 定义选择操作

def selection(population, fitness, num_parents):

parents = []

n = len(population)

indices = [i for i in range(n)]

for i in range(num_parents):

front = pareto_ranking(fitness)

distance = crowding_distance(fitness, front)

max_distance_index = indices[front[distance.index(max(distance))]]

parents.append(population[max_distance_index])

indices.remove(max_distance_index)

return parents

# 定义交叉和变异操作

def crossover(parents, offspring_size):

offspring = []

for i in range(offspring_size):

parent_1 = random.choice(parents)

parent_2 = random.choice(parents)

child = [parent_1[j] if random.random() < 0.5 else parent_2[j]

for j in range(len(parent_1))]

offspring.append(child)

return offspring

def mutation(offspring_crossover):

for i in range(len(offspring_crossover)):

if random.random() < 0.1:

offspring_crossover[i][0] += random.uniform(-0.5, 0.5)

if random.random() < 0.1:

offspring_crossover[i][1] += random.uniform(-0.5, 0.5)

return offspring_crossover

# 设置算法参数

num_generations = 50

population_size = 100

num_parents = 20

offspring_size = population_size - num_parents

# 初始化种群

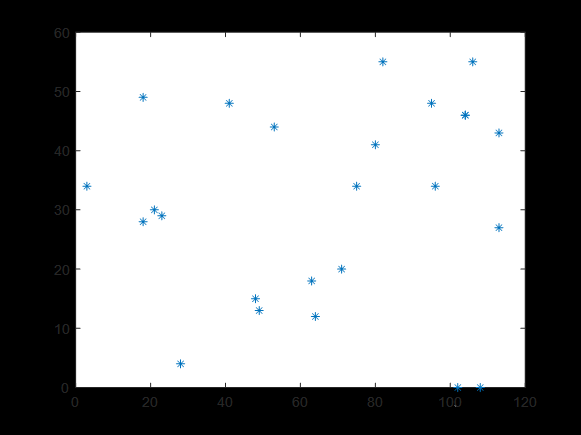

population = [[random.uniform(-5, 5), random.uniform(-5, 5)] for i in range(population_size)]

for i in range(num_generations):

# 计算适应度值和帕累托等级

fitness = objective_function(population)

# 选择操作

parents = selection(population, fitness, num_parents)

# 交叉操作

offspring_crossover = crossover(parents, offspring_size)

# 变异操作

offspring_mutation = mutation(offspring_crossover)

# 将父代和后代合并成一个种群

population = parents + offspring_mutation

# 输出当前最优解

best_individual_index = pareto_ranking(fitness)[0]

print("Generation ", i+1, ": Most optimal solution is ", population[best_individual_index])

# 输出所有 Pareto 最优解

pareto_front = pareto_ranking(fitness)

print("\nPareto front:")

for i in pareto_front:

print(population[i], objective_function([population[i]])[0])

在这个示例中,我们仍然使用 Python 来实现带有两个目标函数的多目标问题。首先定义了 objective_function 函数,它接收一个种群并返回每个个体的两个目标函数值。然后定义了 pareto_ranking 函数和 crowding_distance 函数来计算帕累托等级和拥挤距离。其中,pareto_ranking 函数用来对种群进行帕累托排序,得到每个个体的帕累托等级,crowding_distance 函数用来计算每个个体的拥挤距离。最后,定义了 selection 函数、crossover 函数和 mutation 函数来执行选择、交叉和变异操作,这些操作都是遗传算法的常见操作。

在主函数中,我们使用以上函数实现了 NSGA-II 算法,并使用种群的 Pareto 前沿面来输出所有的可行解。可以通过修改参数,例如种群大小、迭代次数等,来调整算法。

三、区别与联系

模拟退火算法(Simulated Annealing,SA)和 NSGA-II 遗传算法(Non-dominated Sorting Genetic Algorithm II)是两种不同的优化算法,它们具有以下几个区别:

算法思想不同

SA 算法是一种启发式随机搜索算法,基于模拟固体物质的退火过程,可以在接受劣解的概率下逐渐接近全局最优解。NSGA-II 算法是一种多目标遗传算法,主要针对多目标优化问题,通过维护帕累托前沿面来寻找非支配解。

应用场景不同

SA 算法适用于寻求单目标优化问题的全局最优解,尤其在搜索空间较小或者不存在明显的解析解时比较适用。NSGA-II 算法针对多目标优化问题,可以同时处理多个目标函数并生成 Pareto 前沿面上的一系列 Pareto 最优解。

优化方法不同

SA 算法通过改变温度来达到控制接受劣解的概率的目的,同时允许跳出局部最优解,从而在全局范围内搜索解空间。NSGA-II 算法主要通过选择、交叉和变异等操作来生成下一代种群,并通过帕累托排序来维护 Pareto 最优解。

算法复杂度不同

SA 算法的时间复杂度与温度下降速率有关,复杂度通常较低,但可能需要进行大量迭代才能收敛到全局最优解。NSGA-II 算法的时间复杂度主要受到种群大小、生成下一代种群的操作等因素的影响,通常情况下比 SA 算法更复杂。文章来源:https://www.toymoban.com/news/detail-432248.html

总的来说,模拟退火算法和 NSGA-II 遗传算法都是比较常见的优化算法,其适用的问题类型和搜索策略等方面有所不同,可以根据具体情况选择合适的算法。文章来源地址https://www.toymoban.com/news/detail-432248.html

到了这里,关于模拟退火算法与遗传算法求解多目标优化问题的算法实现(数学建模)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!