High-Resolution Image Synthesis with Latent Diffusion Models(CVPR 2022)

https://arxiv.org/abs/2112.10752

GitHub - CompVis/latent-diffusion: High-Resolution Image Synthesis with Latent Diffusion Models

GitHub - CompVis/stable-diffusion: A latent text-to-image diffusion model

贡献:大大减少计算复杂度、提出了cross-attention的方法来实现多模态训练,使得条件图片生成任务也可以实现

论文贡献

- Diffusion model相比GAN可以取得更好的图片生成效果,然而该模型是一种自回归模型,需要反复迭代计算,因此训练和推理代价都很高。论文提出一种在潜在表示空间(latent space)上进行diffusion过程的方法,从而能够大大减少计算复杂度,同时也能达到十分不错的图片生成效果。

- 相比于其它空间压缩方法,论文提出的方法可以生成更细致的图像,并且在高分辨率图片生成任务(如风景图生成,百万像素图像)上表现得也很好。

- 论文将该模型在无条件图片生成(unconditional image synthesis), 图片修复(inpainting),图片超分(super-resolution)任务上进行了实验,都取得了不错的效果。

- 论文还提出了cross-attention的方法来实现多模态训练,使得条件图片生成任务也可以实现。论文中提到的条件图片生成任务包括类别条件图片生成(class-condition), 文图生成(text-to-image), 布局条件图片生成(layout-to-image)。这也为日后Stable Diffusion的开发奠定了基础。

方法

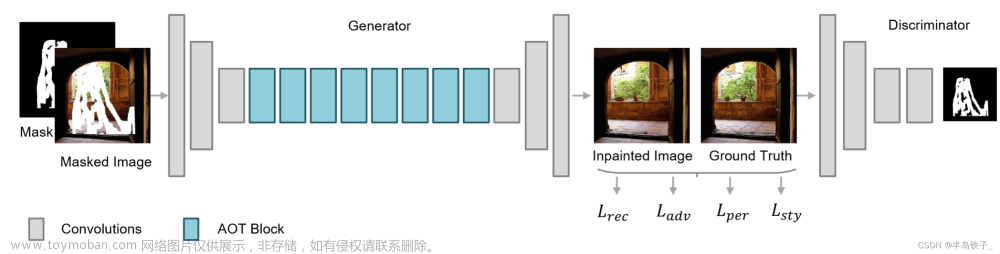

Latent Diffusion Models整体流程如图:

- 首先需要训练好一个自编码模型(AutoEncoder,包括一个编码器 E 和一个解码器 D )。

- 这样一来,我们就可以利用 Encoder 对图片进行压缩,

- 然后在潜在表示空间上做diffusion操作,

- 最后我们再用 Decoder 恢复到原始像素空间即可,

论文将这个方法称之为感知压缩(Perceptual Compression)。个人认为这种将高维特征压缩到低维,然后在低维空间上进行操作的方法具有普适性,可以很容易推广到文本、音频、视频等领域。

在潜在表示空间上做diffusion操作其主要过程和标准的扩散模型没有太大的区别,所用到的扩散模型的具体实现为 time-conditional UNet。但是有一个重要的地方是论文为diffusion操作引入了条件机制(Conditioning Mechanisms),通过cross-attention的方式来实现多模态训练,使得条件图片生成任务也可以实现。文章来源:https://www.toymoban.com/news/detail-432741.html

下面我们针对感知压缩、扩散模型、条件机制的具体细节进行展开。文章来源地址https://www.toymoban.com/news/detail-432741.html

到了这里,关于Latent Diffusion Models的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

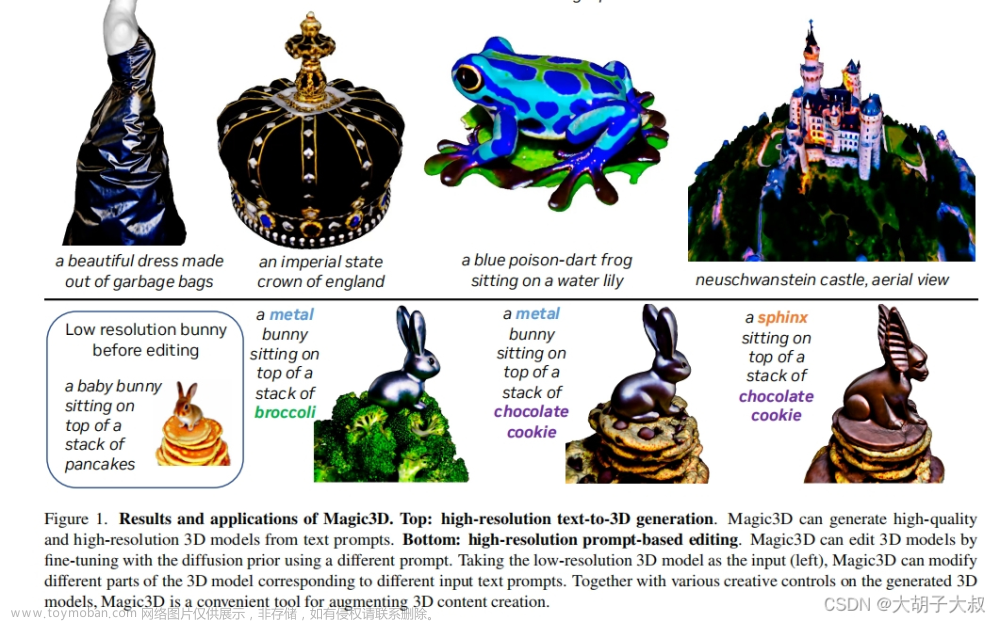

![[CVPR-23-Highlight] Magic3D: High-Resolution Text-to-3D Content Creation](https://imgs.yssmx.com/Uploads/2024/02/642215-1.png)