前言

之前的文章主要介绍Spark基础知识,例如集群角色、Spark集群运行流程等,接下来会进一步讨论Spark相对核心的知识,让我们拭目以待,同时也期待各位的精彩留言!

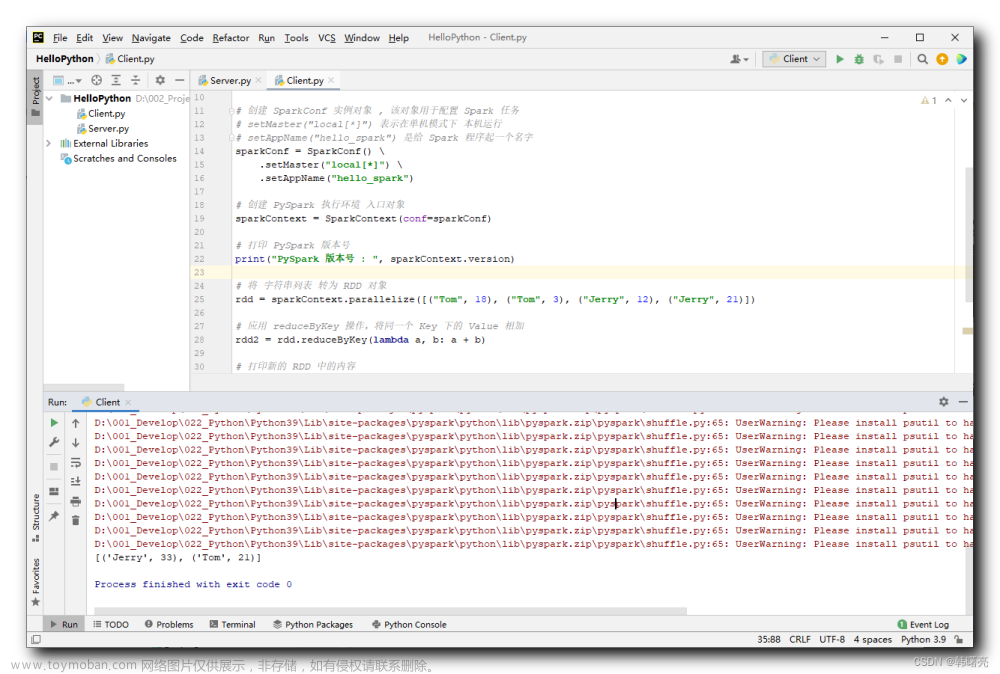

一、RDD简介

RDD称为弹性分布式数据集,是Spark中最基本的数据抽象,其为一个不可变、可分区、元素可并行计算的集合;RDD中的数据是分布式存储,可用于并行计算,同时,RDD中的数据可以存储在内存或者磁盘中,这就是“弹性”的意义所在。 文章来源:https://www.toymoban.com/news/detail-435565.html

文章来源:https://www.toymoban.com/news/detail-435565.html

二、RDD的特性

RDD有5大特性,前三个特性是每个RDD必备的,而后面两个特性是可选的,特性分别为:

(1)RDD数据集可分区;

(2)一个函数会作用在RDD的每一个分区上;

&#x文章来源地址https://www.toymoban.com/news/detail-435565.html

到了这里,关于大数据之PySpark的RDD介绍的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!