Windows部署

win10

通过wsl部署

常见问题:

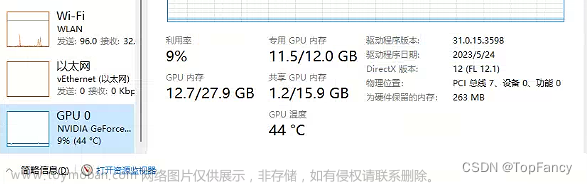

torch.cuda.OutOfMemoryError: CUDA out of memory.

在Windows的系统环境变量中增加

变量名:PYTORCH_CUDA_ALLOC_CONF

变量值:max_split_size_mb:32

文档书写时使用3090 24G显存配置,其他规格酌情调整 32 至其他值,如未设置变量默认值128极大概率导致 CUDA OOM

无法正常启动:比如命令卡死、无响应、不继续执行等等非报错异常

无敌三步走

1.Ctrl+C 终止命令执行,重新执行命令

2.退出实例exit,关闭实例wsl --shutdown,启动并进入实例wsl

3.重启电脑,重新进入实例,重新执行命令

查看虚拟化是否启用文章来源:https://www.toymoban.com/news/detail-440530.html

调取任务管理器

Ctrl+Shift+Esc或Win+X -> T或任务栏-> 右键 -> 任务管理器

性能 -> CPU -> 右下角虚拟化已启用

其他方式自行搜索文章来源地址https://www.toymoban.com/news/detail-440530.html

- 前置准备

到了这里,关于清华大学开源的chatGLM-6B部署实战的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!