当我们使用爬虫程序进行数据采集时,经常会遇到一些网站对爬虫的限制,例如IP封禁、访问频率限制等。为了解决这些问题,我们可以使用代理服务器来进行爬虫操作。本文将介绍爬虫代理的相关知识。

一、什么是爬虫代理?

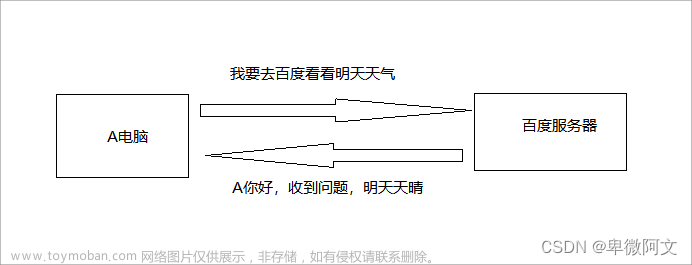

爬虫代理是指在爬虫程序中使用代理服务器进行数据采集的一种方式。代理服务器是一台位于互联网上的服务器,它充当了客户端和目标服务器之间的中间人,将客户端的请求转发给目标服务器,然后将目标服务器的响应返回给客户端。通过使用代理服务器,我们可以隐藏客户端的真实IP地址,从而避免被目标服务器封禁。

二、为什么需要使用爬虫代理?

1、隐藏真实IP地址

在进行爬虫操作时,我们经常需要访问一些反爬虫的网站,这些网站会对频繁访问的IP地址进行封禁。通过使用代理服务器,我们可以隐藏客户端的真实IP地址,从而避免被封禁。

2、提高访问速度

有些网站对访问频率进行了限制,如果我们使用同一个IP地址频繁访问该网站,就会被限制访问。通过使用代理服务器,我们可以轮流使用多个IP地址进行访问,从而提高访问速度。

3、突破地域限制

有些网站对不同地区的访问进行了限制,例如国外的视频网站只允许本地IP地址进行访问。通过使用代理服务器,我们可以模拟不同地区的IP地址进行访问,从而突破地域限制。

三、如何使用爬虫代理?

1、获取代理IP地址

我们可以通过购买代理IP地址或者使用免费的代理IP地址来进行爬虫操作。购买代理IP地址可以保证IP地址的稳定性和可靠性,但是需要付费。使用免费的代理IP地址可以节省成本,但是稳定性和可靠性较低。

2、设置代理服务器

在Python中,我们可以使用requests库来设置代理服务器。例如:

import requests

proxies = {

“http”: “http://10.10.1.10:3128”,

“https”: “http://10.10.1.10:1080”,

}

response = requests.get(“http://www.example.com”, proxies=proxies)

在上面的代码中,我们设置了HTTP代理服务器的地址为10.10.1.10:3128,HTTPS代理服务器的地址为10.10.1.10:1080。然后使用requests库发送GET请求,将proxies参数设置为我们定义的代理服务器。

四、爬虫代理的注意事项

1、选择稳定的代理服务器

在选择代理服务器时,我们需要选择稳定的代理服务器,避免频繁更换IP地址导致访问失败。

2、避免频繁访问同一个IP地址

虽然使用代理服务器可以隐藏客户端的真实IP地址,但是如果我们频繁访问同一个IP地址,也会被目标服务器封禁。

3、遵守网站的规定

在进行爬虫操作时,我们需要遵守网站的规定,不要进行恶意攻击或者侵犯网站的利益。文章来源:https://www.toymoban.com/news/detail-441650.html

总之,爬虫代理是进行数据采集的重要工具之一,它可以帮助我们突破一些限制,提高数据采集的效率。但是在使用代理服务器时,我们需要注意一些注意事项,避免被目标服务器封禁。文章来源地址https://www.toymoban.com/news/detail-441650.html

到了这里,关于关于Python爬虫使用代理的问题的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!