1、在测试clip-interrogator 发现BLIP CLIP模型需要离线加载,以下手工下载并指定路径。

并运行TRANSFORMERS_OFFLINE=1 python run.py, run.py如下

import pdb /from PIL import Imagefrom clip_interrogator import Interrogator, Config

image_path = "shot142.jpg"

image = Image.open(image_path).convert('RGB')

ci = Interrogator(Config(clip_model_name="ViT-L-14/openai"))print(ci.interrogate(image))其他huggingface的模型处理方法可参考。

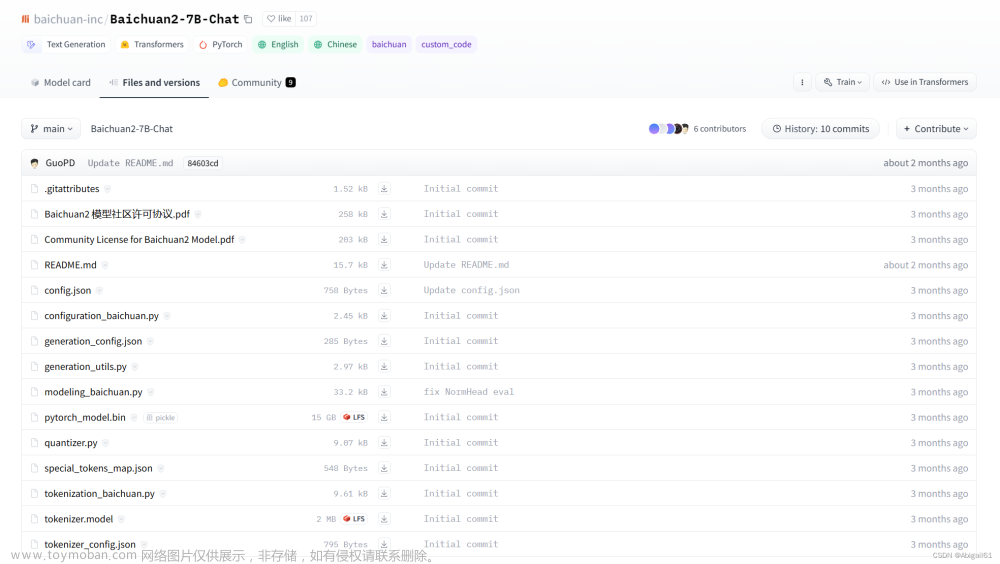

2、BLIP模型 根据Readme指引下载,存,指定路径即可。

BLIP//pretrained/model_base_caption_capfilt_large.pth BLIP//pretrained/model_large_caption.pth

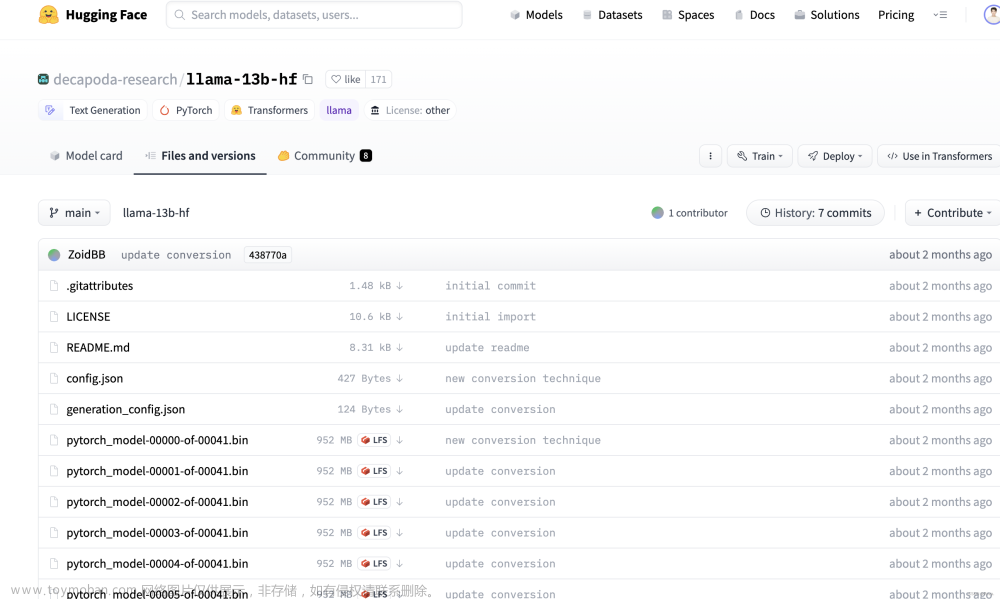

3、缺bert-base-uncased 模型,尝试一下方法下载

——git clone https://huggingface.co/bert-base-uncased

然后在文中'bert-base-uncased'位置指定为下载路径

4、代码中只有 clip_model_name: str = 'ViT-L-14/openai' 一行提示模型,无法通过上述clone下载,

——从出错位置跟踪找到模型下载路径,手工下载并存到指定路径

并且!!对环境中py379/lib/python3.7/site-packages/open_clip/openai.py的相关调用如58行有限判断下载,再读是否存在本地文件(求大神指教这是什么神仙逻辑?)

if os.path.isfile(name):

print(name)

model_path = name

elif get_pretrained_url(name, 'openai'):

print(name, get_pretrained_url(name, 'openai'), cache_dir)

model_path = download_pretrained_from_url(get_pretrained_url(name, 'openai'), cache_dir=cache_dir)

else:

raise RuntimeError(f"Model {name} not found; available models = {list_openai_models()}")5、成功加载文章来源:https://www.toymoban.com/news/detail-443029.html

文章来源地址https://www.toymoban.com/news/detail-443029.html

文章来源地址https://www.toymoban.com/news/detail-443029.html

到了这里,关于huggingface.co下载模型的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[NLP]Huggingface模型/数据文件下载方法](https://imgs.yssmx.com/Uploads/2024/02/603970-1.png)