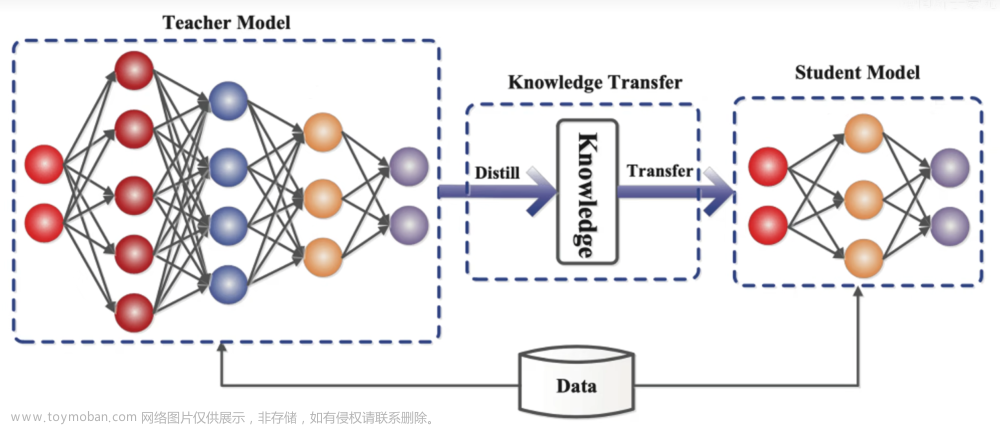

知识蒸馏

一个训练好的大型的老师网络,一个未训练的小的学生网络(可以是直接从大网络中裁掉一部分得到的小网络)

两个网络各选取几个关键的层(比如各5个,这些层两两之间是对应的),然后使用一种方法来衡量对应两层输出的相似度以计算损失,比如就将两个特征图的所有像素的均方差和作为该层的loss,这个loss就反映了学生网络的输出与老师网络输出的相似性,相似度越高说明小网络越能学到老师网络的精粹。同时也在输出层使用普通的loss。

具体过程就是同时对大小网络输入同一张图片,然后计算两个网络中间层输出的相似度损失,及小网络的输出损失,然后进行反向传播微调小网络。

核心思想:文章来源:https://www.toymoban.com/news/detail-445461.html

利用训练好的大网络辅助训练小网络,这样小网络就可以朝着更加像大网络文章来源地址https://www.toymoban.com/news/detail-445461.html

到了这里,关于一文弄懂模型知识蒸馏、剪枝、压缩、量化的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!