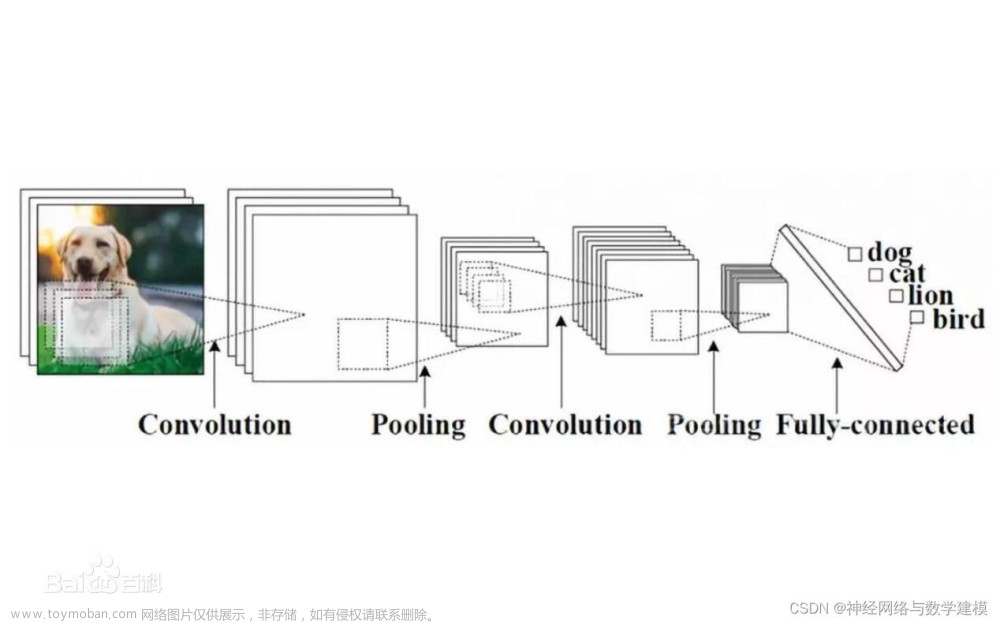

语义分割是对图像中的每个像素分类。 全卷积网络(fully convolutional network,FCN)采用卷积神经网络实现了从图像像素到像素类别的变换 。 与我们之前在图像分类或目标检测部分介绍的卷积神经网络不同,全卷积网络将中间层特征图的高和宽变换回输入图像的尺寸:这是通过在 转置卷积(transposed convolution)实现的。 因此,输出的类别预测与输入图像在像素级别上具有一一对应关系:通道维的输出即该位置对应像素的类别预测。

- FCN是用深度神经网络来做语义分割的奠基性工作

- 它用转置卷积层替换CNN最后的全连接层,从而可以实现每个像素的预测

1. 构造模型

%matplotlib inline

import torch

import torchvision

from torch import nn

from torch.nn import functional as F

from d2l import torch as d2l

全卷积网络先使用卷积神经网络抽取图像特征,然后通过 1×1 卷积层将通道数变换为类别个数,最后通过转置卷积层将特征图的高和宽变换为输入图像的尺寸。 因此,模型输出与输入图像的高和宽相同,且最终输出通道包含了该空间位置像素的类别预测。

下面,使用在ImageNet数据集上预训练的ResNet-18模型来提取图像特征,并将该网络记为pretrained_net。 ResNet-18模型的最后几层包括全局平均汇聚层和全连接层,然而全卷积网络中不需要它们。

pretrained_net = torchvision.models.resnet18(pretrained=True)

# 列出最后3层

list(pretrained_net.children())[-3:]

运行结果:

接下来,我们创建一个全卷积网络net。 它复制了ResNet-18中大部分的预训练层,除了最后的全局平均汇聚层和最接近输出的全连接层。

net = nn.Sequential(*list(pretrained_net.children())[:-2])

给定高度为320和宽度为480的输入,net的前向传播将输入的高和宽减小至原来的 1/32 ,即10和15,通道数从3变成512.

# 在语义分割中,输入图片是320 x 480的图片,因为是像素级别的,所以图片相对来说比较大

# 和ImageNet是不同的,在ImageNet中是224 x 224

X = torch.rand(size=(1, 3, 320, 480))

net(X).shape

运行结果:

ps:卷积神经网络最好的地方就是:不管输入图片的高宽如何都能进行计算,不像全连接,全连接一旦定了,输入的大小是不能变的,卷积没关系,因为要进行学习的权重kernel(卷积核)和输入大小无关,是和卷积层的定义是相关的

接下来使用 1×1 卷积层将输出通道数转换为Pascal VOC2012数据集的类数(21类)。最后需要(将特征图的高度和宽度增加32倍),从而将其变回输入图像的高和宽。

回想一下 卷积层输出形状的计算方法: 由于 (320−64+16×2+32)/32=10 且 (480−64+16×2+32)/32=15 ,我们构造一个步幅为 32 的转置卷积层,并将卷积核的高和宽设为 64 ,填充为 16 。 我们可以看到如果步幅为 𝑠 ,填充为 𝑠/2 (假设 𝑠/2 是整数)且卷积核的高和宽为 2𝑠 ,转置卷积核会将输入的高和宽分别放大 𝑠 倍。

num_classes = 21 # VOC一共21类

# final_conv 的输出是num_classes=21,选择21是因为这是把计算减小最快捷的方式

# 当然是可以选择21-512之间的数

# 1x1 卷积的重要作用之一就是减小参数从而减小计算量,而且图片信息也有一部分通过权重与偏置保留下来

net.add_module('final_conv', nn.Conv2d(512, num_classes, kernel_size=1))

# 转置卷积层:输入通道和输出通道都是21(分类数)

net.add_module('transpose_conv', nn.ConvTranspose2d(num_classes, num_classes,

kernel_size=64, padding=16, stride=32))

2. 初始化转置卷积层

在图像处理中,我们有时需要将图像放大,即上采样(upsampling)。 双线性插值(bilinear interpolation) 是常用的上采样方法之一,它也经常用于初始化转置卷积层。

为了解释双线性插值,假设给定输入图像,我们想要计算上采样输出图像上的每个像素。

- 将输出图像的坐标 (𝑥,𝑦) 映射到输入图像的坐标 (𝑥′,𝑦′) 上。 例如,根据输入与输出的尺寸之比来映射。 请注意,映射后的 𝑥′ 和 𝑦′ 是实数。

- 在输入图像上找到离坐标 (𝑥′,𝑦′) 最近的4个像素。

- 输出图像在坐标 (𝑥,𝑦) 上的像素依据输入图像上这4个像素及其与 (𝑥′,𝑦′) 的相对距离来计算。

双线性插值的上采样可以通过转置卷积层实现,内核由以下bilinear_kernel函数构造。 限于篇幅,我们只给出bilinear_kernel函数的实现,不讨论算法的原理。

def bilinear_kernel(in_channels, out_channels, kernel_size):

factor = (kernel_size + 1) // 2

if kernel_size % 2 == 1:

center = factor - 1

else:

center = factor - 0.5

og = (torch.arange(kernel_size).reshape(-1, 1),

torch.arange(kernel_size).reshape(1, -1))

filt = (1 - torch.abs(og[0] - center) / factor) * \

(1 - torch.abs(og[1] - center) / factor)

weight = torch.zeros((in_channels, out_channels,

kernel_size, kernel_size))

weight[range(in_channels), range(out_channels), :, :] = filt

return weight

让我们用双线性插值的上采样实验,它由转置卷积层实现。 我们构造一个将输入的高和宽放大2倍的转置卷积层,并将其卷积核用bilinear_kernel函数初始化。

# 构造出一个转置卷积层,会将输入的高和宽放大2倍

conv_trans = nn.ConvTranspose2d(3, 3, kernel_size=4, padding=1, stride=2,

bias=False)

# 用一个双线性的核bilinear_kernel出来的矩阵来初始化转置卷积层的权重

# 这样conv_trans就真的变成了双线性插值的操作了

conv_trans.weight.data.copy_(bilinear_kernel(3, 3, 4));

读取图像X,将上采样的结果记作Y。为了打印图像,我们需要调整通道维的位置。

# 把图片读进来,然后转成pytorch能用的形式

img = torchvision.transforms.ToTensor()(d2l.Image.open('drive/MyDrive/chapter13/img/catdog.jpg'))

X = img.unsqueeze(0)

# 对X做转置卷积的操作得到Y

Y = conv_trans(X)

out_img = Y[0].permute(1, 2, 0).detach()

可以看到,转置卷积层将图像的高和宽分别放大了2倍。 除了坐标刻度不同,双线性插值放大的图像和之前打印出的原图看上去没什么两样。

d2l.set_figsize()

print('input image shape:', img.permute(1, 2, 0).shape)

d2l.plt.imshow(img.permute(1, 2, 0));

print('output image shape:', out_img.shape)

d2l.plt.imshow(out_img);

运行结果:

由运行结果可以看出,输入图片是561x728的高宽,输出的图片把高宽加了一倍。

所以,假设构造了一个转置的卷积层,这个卷积层的作用是把高宽变大两倍,而且用了双线性插值的核来初始化它的权重,那么效果就真的变成了把图片放大。

双线性插值是一个很不错的用来初始化转置卷积的权重的方法。

全卷积网络用双线性插值的上采样初始化转置卷积层。对于 1×1 卷积层,我们使用Xavier初始化参数。

# 转置卷积初始化=转置卷积+双线性插值

W = bilinear_kernel(num_classes, num_classes, 64)

net.transpose_conv.weight.data.copy_(W);

3. 读取数据集

使用语义分割读取数据集。 指定随机裁剪的输出图像的形状为 320×480 :高和宽都可以被 32 整除。

# 批量大小为32,随机裁剪的输出图像的形状为 320×480

batch_size, crop_size = 32, (320, 480)

train_iter, test_iter = d2l.load_data_voc(batch_size, crop_size)

4. 训练

现在我们可以训练全卷积网络了。 这里的损失函数和准确率计算与图像分类中的并没有本质上的不同,因为我们使用转置卷积层的通道来预测像素的类别,所以需要在损失计算中指定通道维。 此外,模型基于每个像素的预测类别是否正确来计算准确率。

def loss(inputs, targets):

# 之前只有cross_entropy,因为以前是一个标量

# 现在一张图片中所有的像素都要做预测,所以要对每个像素做均值

# 因此现在损失是一个矩阵,因此要在高和宽两个维度做均值

# 这样每张图片的损失就拿到一个值

return F.cross_entropy(inputs, targets, reduction='none').mean(1).mean(1)

num_epochs, lr, wd, devices = 5, 0.001, 1e-3, d2l.try_all_gpus()

trainer = torch.optim.SGD(net.parameters(), lr=lr, weight_decay=wd)

d2l.train_ch13(net, train_iter, test_iter, loss, trainer, num_epochs, devices)

运行结果如下,可以看出精度不算特别高,很有可能是边缘做得不够好;另外,精度上升比较缓慢,损失下降明显,是因为一开始很容易把背景以及中间部分分好,边缘的损失一直在往下降,所以也许多迭代几个epoch,效果会更好:

5. 预测

在预测时,我们需要将输入图像在各个通道做标准化,并转成卷积神经网络所需要的四维输入格式。

def predict(img):

# 用测试集的dataset的normalization,对RGB来做normalize

X = test_iter.dataset.normalize_image(img).unsqueeze(0)

# 把X copy到GPU上,在通道维度上做argmax,因为输出是

# 每一个像素都有21个通道,在通道维度做argmax就会得到对每一个像素预测的标号

pred = net(X.to(devices[0])).argmax(dim=1)

# predict出来再reshape会得到和高宽一样的矩阵

# 之前做图片分类是得到一个标号,就是一个单个的值

# 现在在这里输出像素级别的值,就是一个和原图片高宽等同的矩阵

return pred.reshape(pred.shape[1], pred.shape[2])

为了可视化预测的类别给每个像素,我们将预测类别映射回它们在数据集中的标注颜色。

# 给每个像素的预测值,把它变成img,把每个类别的RGB值做成tensor,

# 预测值做成index,最后去colormap中找到对应的预测的RGB值

def label2image(pred):

colormap = torch.tensor(d2l.VOC_COLORMAP, device=devices[0])

X = pred.long() # index

return colormap[X, :]

测试数据集中的图像大小和形状各异。 由于模型使用了步幅为32的转置卷积层,因此当输入图像的高或宽无法被32整除时,转置卷积层输出的高或宽会与输入图像的尺寸有偏差。 为了解决这个问题,我们可以在图像中截取多块高和宽为32的整数倍的矩形区域,并分别对这些区域中的像素做前向传播。 请注意,这些区域的并集需要完整覆盖输入图像。 当一个像素被多个区域所覆盖时,它在不同区域前向传播中转置卷积层输出的平均值可以作为softmax运算的输入,从而预测类别。

为简单起见,我们只读取几张较大的测试图像,并从图像的左上角开始截取形状为 320×480 的区域用于预测。 对于这些测试图像,我们逐一打印它们截取的区域,再打印预测结果,最后打印标注的类别。

voc_dir = d2l.download_extract('voc2012', 'VOCdevkit/VOC2012')

test_images, test_labels = d2l.read_voc_images(voc_dir, False)

n, imgs = 4, []

for i in range(n):

# 在左上角进行剪裁

crop_rect = (0, 0, 320, 480)

X = torchvision.transforms.functional.crop(test_images[i], *crop_rect)

# 做预测并转成图片

pred = label2image(predict(X))

imgs += [X.permute(1,2,0), pred.cpu(),

torchvision.transforms.functional.crop(

test_labels[i], *crop_rect).permute(1,2,0)]

d2l.show_images(imgs[::3] + imgs[1::3] + imgs[2::3], 3, n, scale=2);

运行结果如下,第一行是原始图片,第二行是预测,第三行是标号,可以看到总的来看,还行,类别没有搞错,但是边缘没弄好,这就是上面的大概87%的精度。要改进的话,可以继续增大epoch,然后把网络参数,超参数调好一些:

6. Q&A

Q1:请问网络中间1x1卷积,将7x7x512压缩到7x7xclass_num,这样原来512通道的信息,被强制压缩到class_num,不会造成很大的信息损失吗?文章来源:https://www.toymoban.com/news/detail-446672.html

A1: 在精度上会有比较大的损失,这里是从速度上考虑而设置的。可以把1x1的通道数设置得高一点会好一点文章来源地址https://www.toymoban.com/news/detail-446672.html

到了这里,关于72.全卷积神经网络(FCN)及代码实现的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!