Python可以使用内置的urllib和第三方库requests来进行HTTP数据抓取。

使用urllib进行HTTP数据抓取的示例代码:

```python

import urllib.request

url = 'Example Domain'

response = urllib.request.urlopen(url)

html = response.read()

print(html)

```文章来源:https://www.toymoban.com/news/detail-446925.html

使用requests进行HTTP数据抓取的示例代码:

```python

import requests

url = 'Example Domain'

response = requests.get(url)

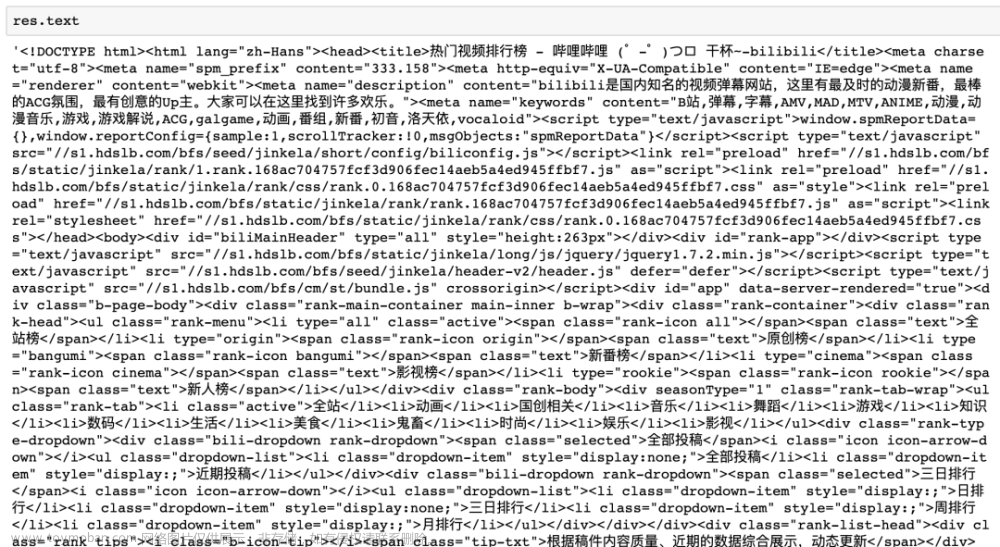

html = response.text

print(html)

```

需要注意的是,进行HTTP数据抓取时需要注意网站的robots.txt文件,遵守网站的爬虫规则,以免触犯法律或被封禁IP。另外,一些网站可能会对爬虫进行反爬虫处理,需要使用一些技巧来绕过反爬虫机制。文章来源地址https://www.toymoban.com/news/detail-446925.html

#! -*- encoding:utf-8 -*-

import requests

# 要访问的目标页面

targetUrl = "http://ip.hahado.cn/ip"

# 代理服务器

proxyHost = "ip.hahado.cn"

proxyPort = "39010"

# 代理隧道验证信息

proxyUser = "username"

proxyPass = "password"

proxyMeta = "http://%(user)s:%(pass)s@%(host)s:%(port)s" % {

"host" : proxyHost,

"port" : proxyPort,

"user" : proxyUser,

"pass" : proxyPass,

}

proxies = {

"http" : proxyMeta,

"https" : proxyMeta,

}

resp = requests.get(targetUrl, proxies=proxies)

print resp.status_code

print resp.text到了这里,关于python使用HTTP做数据抓取的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!