目录

项目介绍

整体流程

调试环境

项目流程

1.预处理

2.汽车识别——去背景算法(KNN/MOG2)

3.统计车流量数目

结尾

源代码

测试视频资料

流程图

项目介绍

本次项目主要采用了传统视觉的方法,对车道车流实现检测,能较为准确的识别出来车道上的车辆数目。由于传统视觉算法本身的局限性,因此也会有识别不准的地方。

整体流程

话不多说,先讲思路,直接上流程图

这里把所有预先设定的参数和变量统一称为了“宏”,然后对识别到的每一帧图像进行处理,最后得到理想的效果图。

效果图如下:

调试环境

- Jupyter Notebook(Anaconda)

- Python 3.9.12

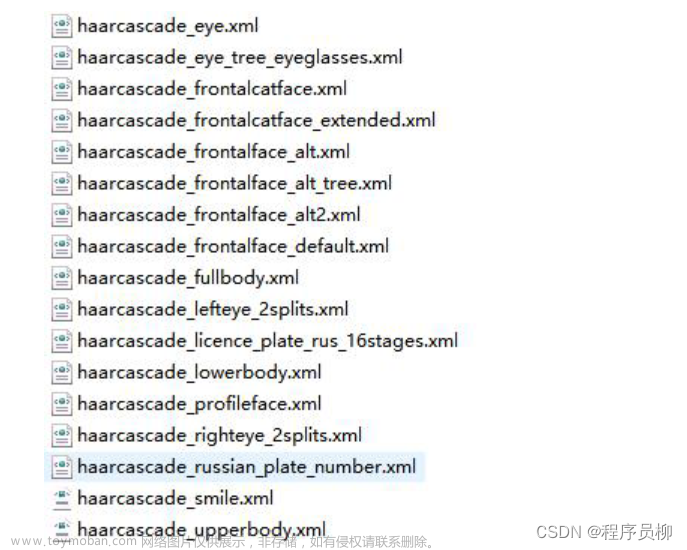

- OpenCv 4.5.5

项目流程

1.预处理

#灰度

cv2.cvtColor(frame,cv2.COLOR_BGR2GRAY)

#高斯去噪

blur=cv2.GaussianBlur(frame,(5,5),5)

mask=removebg.apply(blur)

#腐蚀

erode=cv2.erode(mask,kernel,iterations=2))#iteration=n 迭代n次

#膨胀

dilate=cv2.dilate(erode,kernel,iterations=2

#cv2.imshow("x",dilate)

dst=cv2.morphologyEx(dilate,cv2.MORPH_CLOSE,kernel)2.汽车识别——去背景算法(KNN/MOG2)

先介绍KNN算法(因为本次采用的算法为KNN)

KNN最邻近分类算法的实现原理:为了判断未知样本的类别,以所有已知类别的样本作为参照,计算未知样本与所有已知样本的距离,从中选取与未知样本距离最近的K个已知样本,根据少数服从多数的投票法则(majority-voting),将未知样本与K个最邻近样本中所属类别占比较多的归为一类。

在Opencv中,KNN算法已经被封装好了,所以我们直接调用就可以。

#KNN算法去背景

removebg=cv2.createBackgroundSubtractorKNN()MOG2是一个以混合高斯模型为基础的前景/背景分割算法。使用 K(K=3 或 5)个高斯分布混合对背景像素进行建模。使用这些颜色(在整个视频中)存在时间的长短作为混合的权重。背景的颜色一般持续的时间最长,而且更加静止。这个函数有些可选参数,比如要进行建模场景的时间长度,高斯混合成分的数量,阈值等。将他们全部设置为默认值。然后在整个视频中我们是需要使用backgroundsubtractor.apply() 就可以得到前景的掩模了。移动的物体会被标记为白色,背景会被标记为黑色的。使用方法同上,在此不过多赘述。

3.统计车流量数目

本次统计采用的方法为:找到矩形框的中心点经,当该点经过提前所设定好的直线时,车辆数+1

计算中心点的函数:

def center(x,y,w,h):

x1=int(w/2)

y1=int(h/2)

cx=x+x1

cy=y+y1统计车流量的代码部分:

cpoint=center(x,y,w,h)

cars.append(cpoint)#将中心点储存到cars数组中

for (x,y) in cars:

if(y>lineHeight-7 and y<lineHeight+7):

Car_nums +=1

cars.remove((x,y))

print(Car_nums)最后在经过一些简单的处理,该项目就实现了。文章来源:https://www.toymoban.com/news/detail-447792.html

结尾

附源代码:

import cv2

import numpy as np

lineHeight=550

#穿过直线的车的数量

Car_nums=0

#储存中心坐标的数组

cars=[]

#KNN算法去背景

removebg=cv2.createBackgroundSubtractorKNN()

def center(x,y,w,h):

x1=int(w/2)

y1=int(h/2)

cx=x+x1

cy=y+y1

return cx,cy

video=cv2.VideoCapture('D://video.mp4')

kernel=cv2.getStructuringElement(cv2.MORPH_RECT,(5,5))

while True:

ret,frame=video.read()

if(ret!=0):

#灰度

cv2.cvtColor(frame,cv2.COLOR_BGR2GRAY)

#高斯去噪

blur=cv2.GaussianBlur(frame,(5,5),5)

mask=removebg.apply(blur)

#腐蚀

erode=cv2.erode(mask,kernel,iterations=2)#iteration=n 迭代n次

#膨胀

dilate=cv2.dilate(erode,kernel,iterations=2)

#cv2.imshow("x",dilate)

dst=cv2.morphologyEx(dilate,cv2.MORPH_CLOSE,kernel)

#cv2.imshow("x1",dst)

#画出检测线

cv2.line(frame,(10,lineHeight),(1400,lineHeight),(255,0,0),2)

counts,h=cv2.findContours(dst,cv2.RETR_TREE,cv2.CHAIN_APPROX_SIMPLE)

#遍历所有轮廓

for(i,c) in enumerate(counts):

(x,y,w,h)=cv2.boundingRect(c)

if((w<=90) and (h<=90)):

continue

if(y<66):

continue

#将有效的车绘制出来

cv2.rectangle(frame,(x,y),(x+w,y+h),(0,0,255),2)

cpoint=center(x,y,w,h)

cars.append(cpoint)#将中心点储存到cars数组中

for (x,y) in cars:

if(y>lineHeight-7 and y<lineHeight+7):

Car_nums +=1

cars.remove((x,y))

print(Car_nums)

cv2.putText(frame,"Cars nums:"+str(Car_nums),(500,60),cv2.FONT_HERSHEY_DUPLEX,1,(255,0,0))

cv2.imshow("video",frame)

key=cv2.waitKey(1)

if(key==27):

break

video.release()

cv2.destroyAllWindows() 附上测试视频资料:

链接:https://pan.baidu.com/s/1u_hjCtL3FR6FzeEVQar7wg?pwd=2Y1p

提取码:2Y1p文章来源地址https://www.toymoban.com/news/detail-447792.html

较为形象的流程图:

到了这里,关于基于Opencv+python的车流量检测项目的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!