在多数针对GPT的应用中,很多都是希望通过GPT加载私有数据,为企业或个人做知识助理。对于海量的数据的处理方法应该是结合向量数据库和已有的文件数据库ES,Mongodb等。但是有一些已有的以文档形式记录的企业知识,怎么处理呢?下面我们看看,openai提供的一个把已有的pdf文档加载到GPT中的代码例子。

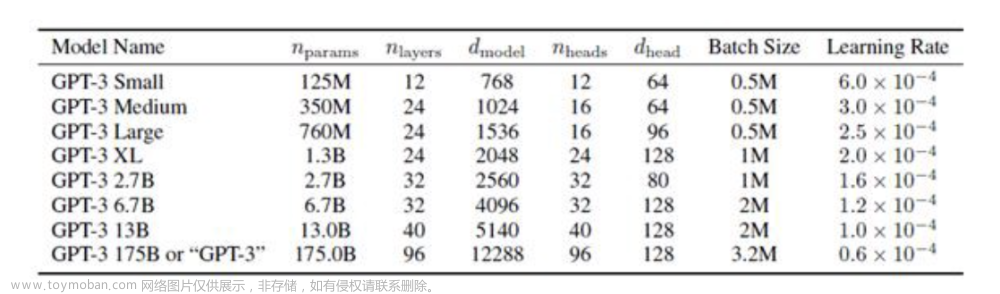

GPT-3可以帮助我们从过大而无法放入上下文窗口的文档中提取关键的数字、日期或其他重要内容。解决这个问题的一种方法是将文档分块并分别处理每个块,然后再将答案合并为一个列表。

在代码例子中中,将运行以下步骤:

- 加载一个长PDF并提取出文本

- 创建一个用于提取关键信息的提示

- 将我们的文档分块并处理每个块以提取出任何答案

- 最后将它们合并

- 我们将这种简单的方法扩展到三个更难的问题上

方法 文章来源:https://www.toymoban.com/news/detail-453883.html

- 设置:拿取一个PDF,一个关于动力单元的一级方程式财务规章文档,并从中提取文本进行实体提取。我们将使用这个来尝试提取埋藏在内容中的答案。

- 简单的实体提取:通过以下步骤从文档的一部分中提取关键信息:

- 创建一个模板提示,包含我们的问题和它期望的格式的例子

- 创建一个函数,接受一段文本作为输入,与提示结合并获得一个响应

- 运行一个脚本来分块文本,提取答案并输出它们以便解析

- 复杂的实体提取:提出一些需要更严格的推理才能解决的更难的问题

例子代码是openai的cookbook的examples/Entity_extraction_for_long_documents.ipynb文章来源地址https://www.toymoban.com/news/detail-453883.html

到了这里,关于GPT学习笔记-文章的摘要的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!