要在两台主机之间使用分布式训练,您可以使用一些深度学习框架提供的工具和库来实现。

这里以TensorFlow为例,介绍一下如何在两台主机之间使用分布式训练。

首先,您需要安装TensorFlow和CUDA等相关软件,并确保两台主机都可以访问彼此。然后,您需要在代码中使用TensorFlow提供的分布式训练API来配置和启动分布式训练。具体来说,您需要完成以下步骤:

-

配置集群:在代码中指定每个工作器(worker)和参数服务器(parameter server)的IP地址和端口号,以及工作器和参数服务器的数量。

-

定义计算图:定义模型的计算图,并将其分配到工作器和参数服务器上。

-

配置会话:配置分布式会话,包括会话的类型、日志目录、保存和恢复等参数。

-

启动工作器和参数服务器:在代码中启动工作器和参数服务器。

-

运行会话:在代码中启动分布式会话,并开始训练模型。

下面是一个简单的TensorFlow分布式训练代码示例,其中假设有两台主机,它们的IP地址分别为192.168.0.1和192.168.0.2:

import tensorflow as tf

# 配置集群

cluster = tf.train.ClusterSpec({

"worker": ["192.168.0.1:2222", "192.168.0.2:2222"],

"ps": ["192.168.0.1:2223"]

})

# 定义计算图

with tf.device("/job:worker/task:0"):

x = tf.placeholder(tf.float32, [None, 784])

W = tf.Variable(tf.zeros([784, 10]))

b = tf.Variable(tf.zeros([10]))

y = tf.nn.softmax(tf.matmul(x, W) + b)

with tf.device("/job:ps/task:0"):

loss = tf.reduce_mean(-tf.reduce_sum(y_ * tf.log(y), reduction_indices=[1]))

with tf.device("/job:worker/task:0"):

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(loss)

# 配置会话

config = tf.ConfigProto(log_device_placement=True)

config.gpu_options.allow_growth =True

# 启动工作器和参数服务器

server = tf.train.Server(cluster, job_name="worker", task_index=0, config=config)

worker_sess = tf.Session(target=server.target)

# 运行会话

with worker_sess as sess:

tf.global_variables_initializer().run()

for i in range(1000):

batch_xs, batch_ys = mnist.train.next_batch(100)

sess.run(train_step, feed_dict={x: batch_xs, y_: batch_ys})在这个代码示例中,我们首先配置了一个由两个工作器和一个参数服务器组成的集群。然后,我们定义了一个简单的神经网络模型,并将其分配到工作器和参数服务器上。接下来,我们配置了一个TensorFlow会话,并启动了工作器和参数服务器。最后,我们运行了会话,并利用MNIST数据集进行训练。

需要注意的是,这只是一个简单的代码示例,实际上在进行分布式训练时,还需要考虑很多因素,例如数据的分发、模型的同步、梯度的累积等。因此,在实际的分布式训练中,您需要更深入地了解分布式训练的原理和实现细节,以及相应框架提供的API和工具,才能正确地配置和启动分布式训练任务。此外,分布式训练通常需要使用高速网络和多个GPU,以充分发挥分布式训练的性能优势。在实际应用中,您也需要根据自己的需求和资源情况,选择合适的分布式训练策略和配置方式。

PyTorch支持多种分布式训练策略和工具,可以在多台主机之间进行分布式训练。PyTorch的分布式训练通常使用torch.distributed模块提供的API来实现,该模块提供了一些常用的分布式训练工具和函数,例如torch.distributed.init_process_group()、torch.nn.parallel.DistributedDataParallel()等。

要使用PyTorch进行分布式训练,您需要完成以下步骤:

-

配置集群:在代码中指定每个工作器(worker)和参数服务器(parameter server)的IP地址和端口号,以及工作器和参数服务器的数量。

-

创建模型:创建模型,并将其分配到工作器和参数服务器上。

-

配置优化器:配置优化器,并将其分配到工作器和参数服务器上。

-

将数据分发到各个工作器:使用PyTorch提供的分布式数据加载器将训练数据分发到各个工作器上。

-

在工作器之间同步参数:使用PyTorch提供的分布式同步函数

torch.distributed.all_reduce()或torch.distributed.broadcast()等,在工作器之间同步模型参数。 -

训练模型:在代码中启动训练循环,并在每个工作器上进行部分训练,并定期同步模型参数。

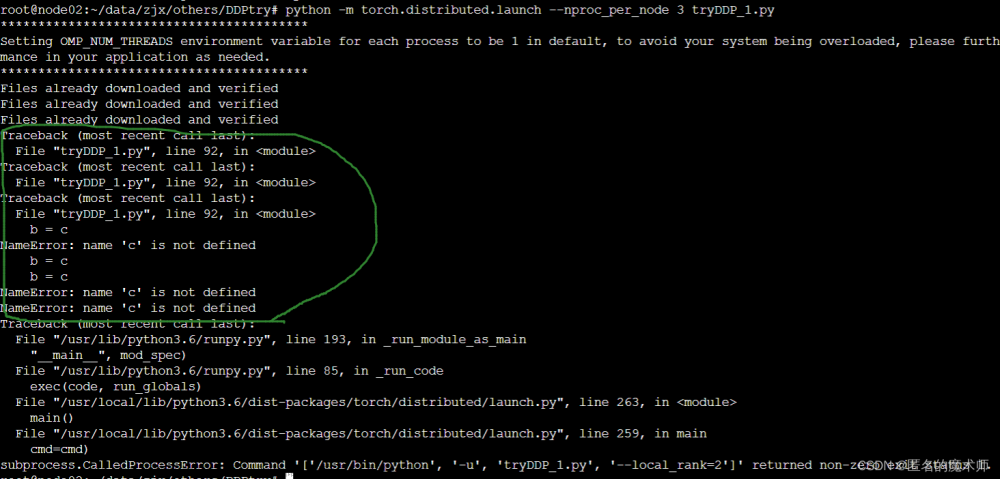

下面是一个简单的PyTorch分布式训练代码示例,其中假设有两台主机,它们的IP地址分别为192.168.0.1和192.168.0.2:

import torch

import torch.nn as nn

import torch.optim as optim

import torch.distributed as dist

import torchvision.datasets as datasets

import torchvision.transforms as transforms

# 配置集群

dist.init_process_group(backend="nccl", init_method="tcp://192.168.0.1:23456", rank=0, world_size=2)

# 创建模型

model = nn.Sequential(

nn.Conv2d(3, 32, 3, 1),

nn.ReLU(),

nn.MaxPool2d(2),

nn.Conv2d(32, 64, 3, 1),

nn.ReLU(),

nn.MaxPool2d(2),

nn.Flatten(),

nn.Linear(1600, 10))

# 将模型分配到工作器和参数服务器上

model = nn.parallel.DistributedDataParallel(model)

# 配置优化器

optimizer = optim.SGD(model.parameters(), lr=0.001)

# 将数据分发到各个工作器

train_dataset = datasets.CIFAR10(root="./data", train=True, download=True, transform=transforms.ToTensor())

train_sampler = torch.utils.data.distributed.DistributedSampler(train_dataset)

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=128, sampler=train_sampler)

# 训练模型

for epoch in range(10):

train_sampler.set_epoch(epoch)

for i, (inputs, labels) in enumerate(train_loader):

inputs, labels = inputs.to(torch.device("cuda")), labels.to(torch.device("cuda"))

optimizer.zero_grad()

outputs = model(inputs)

loss = nn.CrossEntropyLoss()(outputs, labels)

loss.backward()

optimizer.step()

# 在工作器之间同步参数

dist.all_reduce(loss, op=dist.ReduceOp.SUM)

if dist.get_rank() == 0:

print("Epoch {}, Batch {}, Loss: {}".format(epoch, i, loss.item()))在这个代码示例中,我们首先使用torch.distributed.init_process_group()函数配置了一个由两个工作器组成的集群,然后创建了一个简单的神经网络模型,并将其分配到工作器和参数服务器上。接着,我们配置了一个SGD优化器,并将其分配到工作器和参数服务器上。然后,我们使用PyTorch提供的分布式数据加载器将CIFAR-10数据集分发到各个工作器上。最后,我们在训练循环中,在每个工作器上进行部分训练,并使用dist.all_reduce()函数同步模型参数。文章来源:https://www.toymoban.com/news/detail-466219.html

需要注意的是,这只是一个简单的代码示例,实际上在进行分布式训练时,还需要考虑很多因素,例如数据的分发、模型的同步、梯度的累积等。因此,在实际的分布式训练中,您需要更深入地了解分布式训练的原理和实现细节,以及相应框架提供的API和工具,才能正确地配置和启动分布式训练任务。此外,分布式训练通常需要使用高速网络和多个GPU,以充分发挥分布式训练的性能优势。在实际应用中,您也需要根据自己的需求和资源情况,选择合适的分布式训练策略和配置方式。文章来源地址https://www.toymoban.com/news/detail-466219.html

到了这里,关于TensorFlow、PyTorch分布式训练的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!