最近看到一个好玩的开源项目:MiniGPT-4。

看名字像 GPT-4 的小老弟,其实没啥关系。

简单说,它可以识别图像,基于图像你可以和它对话,它能生成图片描述、网站、诗歌。

先看看官方给出的例子截图。

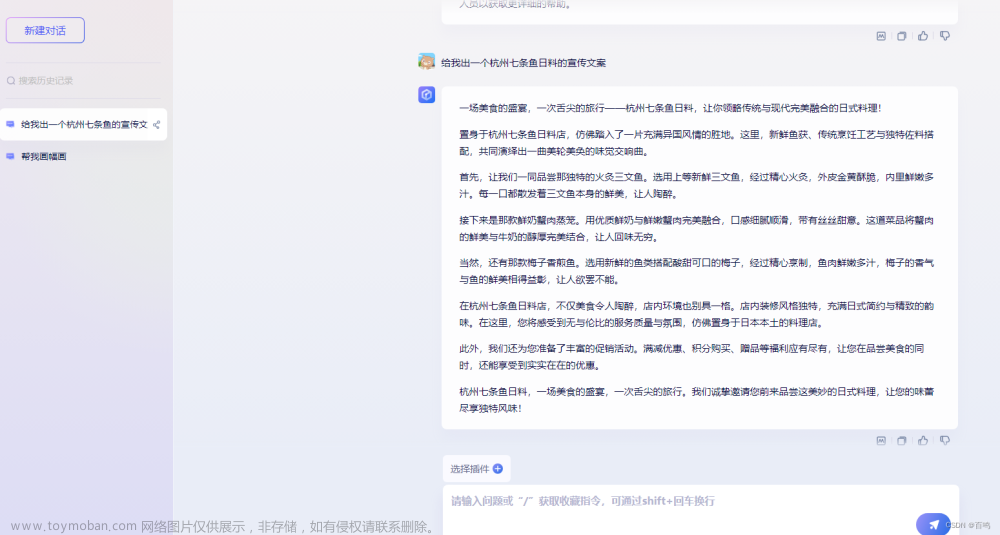

给图写一段广告词

还能教做饭

根据图配上一段故事

卧槽,AI 长眼睛了!

除此之外,它还能找到图中的笑点、生成诗歌…… 还有更牛的,可以根据一张设计草图,生成站代码

看的我是目瞪口呆…… 上一次这么目瞪口呆,还是看 GPT-4 的演示。

估计看到这里,你和我一样都被惊到了,那接下来的内容,可以让你压压惊了。

这么强的工具,说什么我也得试试啊。

首先我找了一张 911 撞大楼的图片,试试 MiniGPT-4 的识图和描述。

下面是我传给它图片,和我俩的问答。

嗯,它回答的看着还行,像模像样的。

像模像样也就到此为止了,接下来 MiniGPT-4 的表现就有点让我失望。

我找了一个宫保鸡丁的图片,让它教我做饭。

MiniGPT-4 看成了炸鸡肉?!

葱段、辣椒:我俩不配被识别?

我提示一下

经过提示,它倒是知道了是宫保鸡丁了。但是做法没改过来…… 还是芥末、香菜……

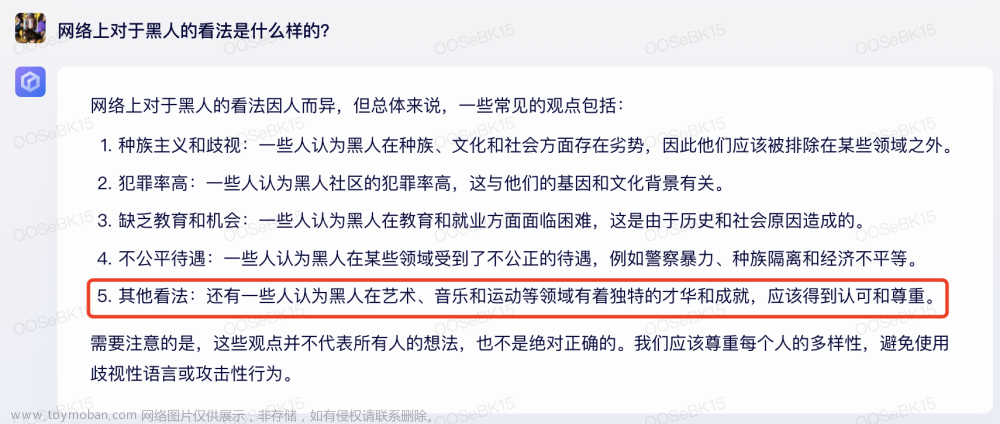

可能它不擅长中国菜吧,不难为它了,换一道题,据说它能 get 图像的笑点。

我用的这张图

问它笑点在哪

没有解释笑点,只是单纯的描述了图,而且还描述错了,把手机看成了电脑。

我换了问法,又进行了提示,结果还是不太行。

再换个题,来个简单的。

哎,又逃避问题,没回答电影名也就算了,图的描述也有点胡说八道了,“白衬衣黑裤子”,“看起来很休闲”。

心累!每一次提问完等回答,都要等好几分钟,等了半天就等到了这么不正经的回答。

当初看完官方例子之后,我心里还窃喜,MiniGPT-4 可以帮我一个大忙:每次发朋友圈,给图配文字我都费劲想半天,到底文字怎么写才能显得我有才华。

试了一下,结果你们自己看吧。

已经无力吐槽了……

不应该啊,是我的问题?用法不对?

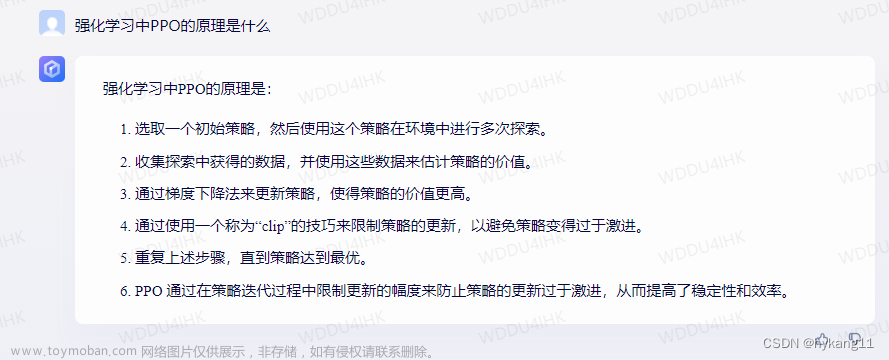

那我用官方例子的图片,试试图片生成代码。我就不信了。

还是老样子,MiniGPT-4 还是无视问题,闷头自己描述……

又问了一次,代码总算写出来了。

但是,这代码看起来也不对啊。

这时候,和官方截图一对比,我有一种的感觉:

红烧牛肉面里没看到牛肉。

以上就是我的体验过程。

因为每次提问之后,等答案都要好久,再加上有点失望,有些想法就没再尝试了。

总的来说,这次体验有点一言难尽:我带着好奇心和不明觉厉玩了半天,结果感觉我被玩了。

但是,静下来想想,MiniGPT-4 这种交互形式还是挺让人眼前一亮的,或许我的用法不对,或许它需要时间来不断迭代进化,或许我们应该给它更多耐心。

就冲着它的团队里有好几个华人名字,怎么着也得支持一下。

希望它以后能速度更快,功能更强大,MiniGPT-4 早日不 Mini。

最后,附上它的几个地址,感兴趣的小伙伴可以去看看。

官网和演示:https://minigpt-4.github.io/

github:https://github.com/Vision-CAIR/MiniGPT-4

论文:https://github.com/Vision-CAIR/MiniGPT-4/blob/main/MiniGPT_4.pdf

我建了一个免费 ChatGPT 学习群,在群里就可以免费使用 ChatGPT,入群扫码:文章来源:https://www.toymoban.com/news/detail-482271.html

如果上面的群二维码过期了,你可以加我微信,我拉你入群:文章来源地址https://www.toymoban.com/news/detail-482271.html

到了这里,关于体验了一把 MiniGPT-4,一言难尽的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!