目录

前言

一、LoRA是什么?

二、使用方法

1.存放LORA模型

2.使用LORA模型

3.查看结果

总结

前言

(1)Sampler——采样方式,在Stable Diffusion WebUI中的Sampling method中进行选择

(2)Model——作者使用的大模型,在Stable Diffusion WebUI中的Stable Diffusion checkpoint中进行选择

(3)CFG scale——提示词相关性,在Stable Diffusion WebUI中的CFG scale进行调整

(4)Steps——采样迭代步数,在Stable Diffusion WebUI中的Sampling steps中进行调整

(5)Seed——随机种子,在Stable Diffusion WebUI中的Seed中进行调整

一、LoRA是什么?

LoRA模型全称是:Low-Rank Adaptation of Large Language Models,可以理解为Stable-Diffusion中的一个插件,仅需要少量的数据就可以进行训练的一种模型。在生成图片时,LoRA模型会与大模型结合使用,从而实现对输出图片结果的调整。

二、使用方法

1.存放LORA模型

路径:

\\sd-webui-aki-v4\extensions\sd-webui-additional-networks\models\lora文件夹下

2.使用LORA模型

在prompt区域输入trigger word触发词,放在最前面。(选择需要的加入到Prompt中,才能将相应的元素触发出来)

注意:一定要使用触发词,在LoRa下载界面中,右侧有个Trigger Words就是触发词,你需要选用一个,写入你的正向提示词中。

- 选择LORA模型

- 输出正向提示词和反向提示词,以及设置必要的参数

- 点击生成

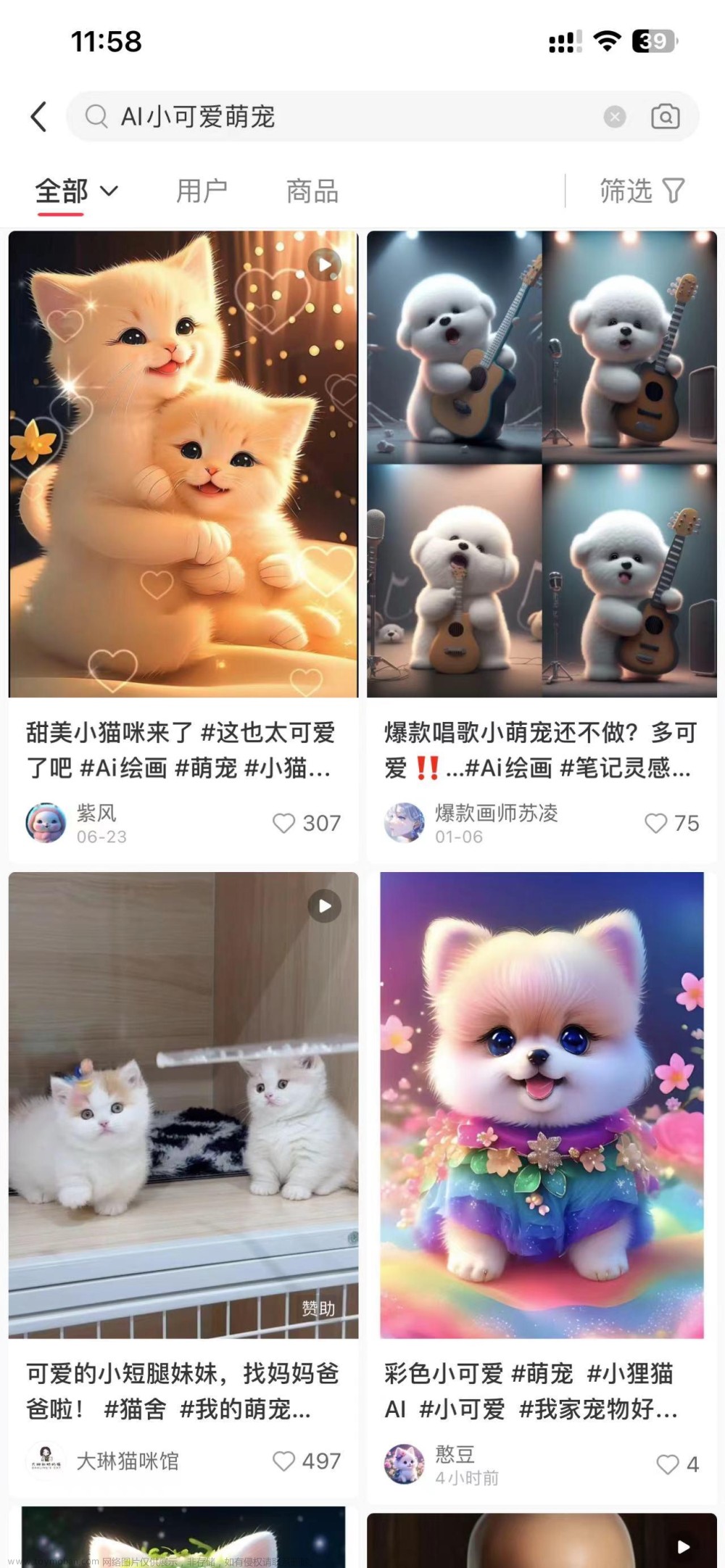

3.查看结果

文章来源:https://www.toymoban.com/news/detail-483839.html

文章来源:https://www.toymoban.com/news/detail-483839.html

总结

以上就是使用stable diffusion绘图的过程及结果内容。文章来源地址https://www.toymoban.com/news/detail-483839.html

到了这里,关于StableDiffusion中LORA模型的使用的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!