对于文本生成模型

假设输入是唯一性的,输出是概率top——k的

只是输入某段文本完全无法续写一个有目标的结果

故而输入要具有指导性和整体性

将上面的观点写成一篇学术论文

题目:对于文本生成模型的指导性和整体性研究

摘要:在自然语言处理领域,文本生成模型在近年来得到广泛的应用。文本生成模型的输入和输出都是文本形式,输出是概率top-k的,简单易懂、且有着很高的效率。在本论文中,我们探讨了文本生成模型的指导性和整体性。它们是提高模型效率和精准性的重要因素,是影响模型构建的关键要素。

我们首先提出了输入要具有指导性和整体性的观点。唯一性的文本输入是基础,但如果是一个无目标的文本输入,由于输出是概率top-k的,可能会导致最终结果存在不确定性。而如果文本输入具有指导性和整体性,能帮助模型更准确地预测结果,从而提高模型的效率和精度。

其次,我们提出了两种方法来增强文本生成模型的指导性和整体性。一种方法是语言模型微调,即改进原有的文本生成模型,使其更具有指导性和整体性。另一种方法是使用面向目标的训练数据,以提高模型的整体性。

最后,我们提出了两个案例研究,以说明如何利用指导性和整体性来改进模型。第一个案例是关于文本填空的生成。我们发现,在传统的生成模型中,很难解决填空问题,因为缺失部分无法向模型提供足够有效的信息。而在将输入具体化、增加指导性的情况下,模型可以更准确地进行预测。第二个案例是关于生成书籍摘要的生成模型。我们发现,在预测书籍摘要时,使用面向目标的训练数据可以提高模型的整体性,以输出精致的结果。

总之,本文提出了文本生成模型的指导性和整体性的概念,以及如何增强模型效率和精度的方法。我们的研究结果表明,文本生成模型的整体性和指导性是影响模型性能的重要因素,它们可以用于改进模型在各种任务上的性能。

给上面的论文扩充实际例子

需要为"关于生成书籍摘要的生成模型"给出实际的例子,为论文内容提供更具体的支持。

这里提供一个实例:

案例:

假设您正在开发一个应用程序,它将根据书籍的文本生成摘要。您的目标是使摘要尽可能保留原始语言的主要信息,同时限制其长度。您希望您的模型生成的摘要更加准确和具有可读性。

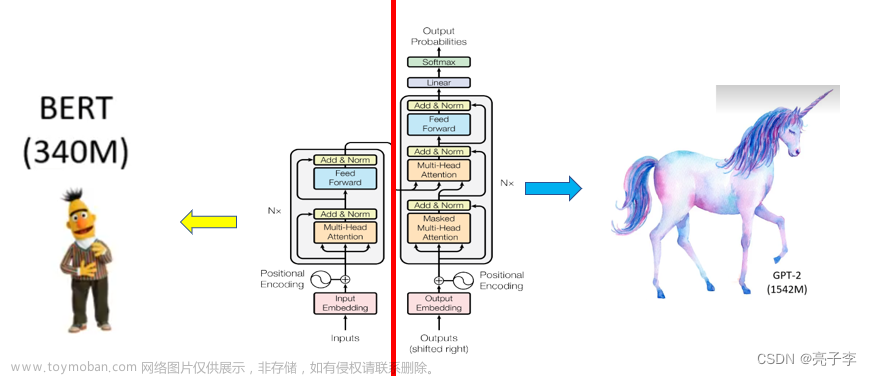

为此,您可以使用生成模型,例如LSTM网络或GPT(Generative Pre-trained Transformer)。但是,由于这些模型仅基于输入文本生成输出,缺少具体的目标和指导性,因此模型可能会在摘要中忽略重要的信息或包含无关紧要的细节。因此,为模型引入具体的指导性和整体性是必要的。

您可以使用相应的训练数据集对模型进行训练,并将其嵌入到模型中。例如,为了限制摘要的长度,您可以使用句子长度等训练数据来训练模型。另外,您可以将其他先验知识或特征,例如术语表、人物名单、主旨词等,也作为输入嵌入到模型中,使其具有更为明确的指导性。文章来源:https://www.toymoban.com/news/detail-487299.html

通过这些方法,您的模型可以生成更加准确和可读的摘要,让读者更容易了解书籍的主题和主要内容。文章来源地址https://www.toymoban.com/news/detail-487299.html

到了这里,关于对于文本生成模型的指导性和整体性研究(chatgpt生成)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!