Dissecting Deep Metric Learning Losses for Image-Text Retrieval

剖析图像文本检索中的深度度量学习损失

2022.10

视觉语义嵌入(VSE)是图像-文本检索中的一种流行的应用方法,它通过学习图像和语言模式之间的联合嵌入空间来保留语义的相似性。三元组损失与硬负值的挖掘已经成为大多数VSE方法的事实目标。

图像领域深度度量学习(DML)产生了新的损失函数,超越了三元损失。 尽管在设计基于梯度运动的损失方面做了一些尝试,但大多数DML损失是在嵌入空间中根据经验定义的。

本文提出了一个新的基于梯度的目标分析框架,即GOAL,以系统地分析现有DML函数中梯度的组合和重新加权,而不是直接应用这些损失函数,这可能导致模型参数的次优梯度更新。在这个分析框架的帮助下,我们进一步提出了梯度空间中新的目标系列,探索不同的梯度组合。在梯度不能与有效的损失函数积分的情况下,我们实现了我们提出的目标,使它们在梯度空间而不是在嵌入空间的损失上直接运作。 综合实验表明,我们的新目标在不同的视觉/文本特征和模型框架中都比基线有持续的性能提高。 我们还展示了GOAL框架的通用性,将其扩展到其他使用三元损失的模型,包括具有严重跨模式交互的视觉-语言模型,并在COCO和Flick30K的图像-文本检索任务中取得了最先进的结果。

简介

视觉语义嵌入(VSE)是在图像和自然语言之间建立联系的主要课题之一。它旨在将图像和它们的描述性文本信息映射到一个联合空间中,这样,一对相关的图像和文本应该被映射到彼此附近,而一对不相关的图像和文本应该被映射到彼此远处。本文专注于图像-文本匹配和检索任务的视觉-语义嵌入,但我们的方法可以推广到其他使用三重损失系列的图像-文本检索模型(如X-VLM)。

一个VSE模型通常由图像和文本的特征提取器、特征聚合器和训练期间的目标函数组成。尽管VSE在特征提取器和特征聚合器方面取得了重大进展,但人们对训练模型的损失函数关注较少。

基于铰链的三联体排名损失与硬负抽样已经成为许多VSE方法的事实训练目标。许多损失函数被提出来以提高图像嵌入任务的训练性能,显示出三重损失对于一般的度量学习来说不是最佳的。早期的损失,如triplet loss和contrastive loss的定义是,在嵌入空间中,正对应该接近,而负对应该分开。然而,这种定义的损失函数可能不会导致理想的特征,这可能会明确地影响模型参数的更新。

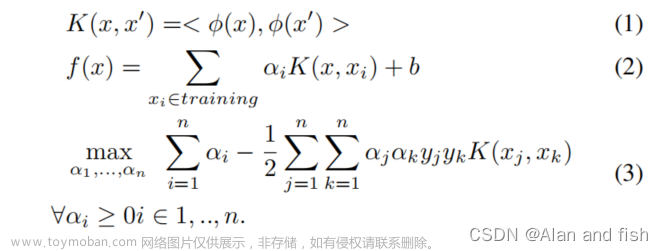

Triplet loss是一种常用的深度度量学习损失函数,用于学习样本间的距离度量,其基本思想是使得同类样本之间的距离尽可能小,异类样本之间的距离尽可能大。

具体来说,在训练过程中,Triplet loss需要输入一个样本三元组(anchor,positive,negative),其中anchor表示锚样本,positive表示与anchor同类的样本,negative表示与anchor不同类的样本。Triplet loss的目标就是最小化锚样本和同类样本之间的距离,同时最大化锚样本和不同类样本之间的距离。

本文提出了基于梯度的目标分析框架,即GOAL,一个新的基于梯度的VSE问题分析框架。我们首先提出了一个新的梯度框架,以剖析梯度层面的损失,并提取其关键梯度元素。然后,我们探索了一种新的训练思路,即在每个训练步骤中直接定义梯度来更新模型,而不是定义损失函数,如图1所示。这个新的框架允许我们简单地将DML损失中的关键梯度元素结合起来,形成一个新的梯度家族,避免了将梯度整合到损失函数中的问题。最后,新的梯度继续改善了现有的VSE在图像文本检索任务上的表现。

图1。为了实现所需的视觉语义嵌入空间,一种常见的方法是设计一个损失函数,该函数可以在PyTorch或TensorFlow等深度学习平台上计算。这些平台上的自动梯度机制自动计算梯度以更新模型参数,形成所需的嵌入空间。在实践中,视觉语义嵌入的目标是优化从图像和文本中提取的特征点的聚类或分离,而损失函数在某种程度上是实现该目标的间接方法,而梯度更直接地影响嵌入空间的更新。我们提出了一种直接设计梯度来训练模型的方法。

本文贡献

- 提出了一个通用框架GOAL来全面分析现有深度度量学习损失函数的梯度更新,并应用这个框架来帮助寻找VSE问题的更好目标。

- 提出了一种新的方法,通过用梯度目标家族来优化模型,而不是使用损失函数,直接处理图像-文本检索任务。

- 展示了对现有方法的持续改进,在COCO数据集的图像-文本检索任务中取得了最先进的结果。

相关工作

用于图像-文本匹配的视觉语义嵌入:

VSE++是一种基本的VSE模式,其中视觉和文本嵌入是单独训练的,然后在投射到一个共享空间后用AvgPool进行聚合,之后通过硬负挖掘的三倍损失来联合优化。 与使用特征图的局部网格作为视觉特征的主流相比,自下而上的注意力被引入到学习图像-文本匹配的视觉语义内联,这通常是通过堆叠预先训练好的物体检测器的区域表征来实现的。通用集合运算符(GPO)来学习最佳集合策略,它优于具有复杂图像聚合器的方法。受语言模型大规模预训练的成功启发,最近出现了一种趋势,即在大规模图像-文本对上进行任务无关的视觉-语言预训练(VLP),以获得通用的表达,然后在特定任务的数据和损失上进行微调,以在下游任务(包括图像-文本检索)中获得最先进的结果。然而,与我们提出的方法相比,流行的方法选择优化三联体损失作为图像-文本匹配任务的事实目标。 在本文中,我们将努力重新审视为视觉语义嵌入寻找更好的训练目标的问题。

深度度量学习在极端的分类环境中很有用,比如细粒度识别。其目的是训练网络将语义相关的图像映射到附近的位置,将不相关的图像映射到嵌入空间中的远处位置。有许多损失函数被提出来解决深度度量学习问题。三元损失函数及其变体,如圆圈损失,形成一个包含锚、正和负实例的三元组,其中锚和正实例共享相同的标签,而锚和负实例共享不同的标签。成对的损失函数,如对比性损失、二项式偏差损失、解除结构损失和多重相似性损失,当一对具有相同标签的实例之间的距离很大时,以及一对具有不同标签的实例之间的距离很小时,就会受到惩罚。所有这些损失函数都鼓励正面图像对的距离要小于负面图像对的距离。由于DML的训练目标与VSE问题相似,本文借用DML的这些损失设计思想来改进VSE问题。

梯度修改:

最近在DML方面的工作,如Multi-Similarity Loss和Circle Loss,从标准的三元损失公式开始,调整损失函数的梯度,通过非常简单的代码修改就可以得到明显的改进。这些工作都找到了明确的损失函数,其梯度是理想的。 其他的策略是从一个理想的梯度加权函数开始,然后整合理想的梯度,得出一个带有适当属性的梯度的损失函数。这通常仅限于简单的加权策略,如简单线性形式和当三联体包含硬负数时对正数的简单梯度去除,因为它可能难以找到梯度与复杂加权策略一致的损失函数。 最相关的工作是P2Sgrad,它分析了基于边际的softmax损失家族中的梯度,并直接用余弦相似度修改梯度以达到更好的优化效果。与P2Sgrad相比,我们的工作侧重于三联体损失及其变体损失函数。

本文的框架直接探索了所需梯度更新的空间。通过不局限于用适当的梯度去除损失函数,我们可以更明确地在实验中剖析梯度的不同部分的影响。此外,我们还可以将实验中最有用的梯度项重新组合成一种梯度条件,稍微改变现有的算法以提高性能。

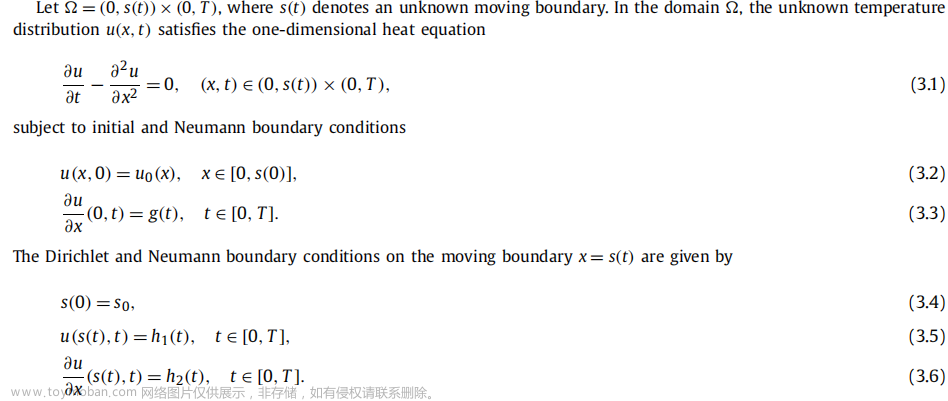

基于梯度的目标设计框架工作

我们为一批图像和文本如何影响网络定义了一系列的术语。 设X是一批输入图像,Y是一批输入文本,x是用图像提取器提取的图像的L2标准化特征向量,y是用文本提取器提取的文本的L2标准化特征向量,l是这批图像的损失值、 θ是图像提取器的参数,φ是文本提取器的参数,η是学习率,fθ(·)是图像提取器的映射函数,gφ(·)是文本提取器的映射函数,L(·)是损失函数。在前向训练步骤中,表达式为:

这两个方程强调,提取器参数的更新与两组导数项相结合。第一组导数项∂l/∂x和∂l/∂y代表了图像和文本嵌入特征的变化对损失的影响,这也是本工作中最详细探讨的术语。第二组导数项∂x/∂θ和∂y/∂φ表示模型的参数变化如何影响嵌入特征。由于导数链规则的存在,在具有多层的现代深度网络中,这个项总是可以用每层的多个项的乘法来扩展,这在工作中没有讨论。

第一组导数项总是受到损失函数的分析形式的制约。例如,由于提升结构损失和二项式偏差损失的指数形式,它们的导数也包含一个指数项。这样的项可能会导致梯度不稳定,这也是损失函数的设计最多只能隐含地控制提取器的学习行为的一个例子。

通过最新的深度学习平台,如Pytorch,它支持前向模块的定制梯度反向计算,而不是依赖于损失的导数,我们可以明确地定义基于所提出的GOAL框架的梯度更新,以直接影响提取器的学习行为。 在下面的讨论中,我们重点讨论了DML文献中许多三重损失函数中第一组术语的特殊形式,然后提出直接定义模型训练的第一组术语。

Gradient Components

给定一对图像和文本特征x和y,当图像特征x被当作锚点时,我们表示其在文本批次Y中挖掘的文本硬负面特征y′;当文本特征y被当作锚点时,我们表示其在图像批次X中挖掘的图像硬负面特征x′。然后,我们可以得到两个三联体(x, y, y′)和(y, x, x′)。在第一个三联体中,Sx,y = xTy和Sx,y′ = xTy′是作为归一化图像特征和归一化文本特征的正负对的点积计算的余弦相似度。类似的余弦相似度是为第二个三联体计算的,Sy,x = yTx和Sy,x′ = yTx′。最后,这些余弦相似度被输入一个对称的三联体损失函数l = L(Sx,y, Sx,y′) + L(Sy,x, Sy,x′)。

与图像和文本特征有关的梯度是:

三联体损失及其变体的区别主要来自标量。在DML文献中,主要有两组标量形式:与三联体的正负对相似性都有关的标量,我们表示为(Triplet Weight T ),与三联体的正或负对相似性有关的标量,我们表示为(Pair Weight P )。

Triplet Weights

对于标准的三联体损失函数与硬性负向开采,梯度可推导为:

Pair Weight

除了三联体权重,许多 DML 工作也提出了损失函数中的配对权重。为了详细讨论对权重P,我们表示正数对的权重为P+,负数对的权重为P-。让一个恒定的缩放参数作为公平比较的基线。在这种情况下,两对权重都设置为常数1。

最近的工作认为,当负数对彼此接近时,负数对的权重应该很大。否则,正如[36]中提到的,对DML的优化任务会很快收敛到一个糟糕的局部最小值。Circle loss中的解决方案是应用线性配对权重Plin:对于负的配对,如果相似度大,权重就大,如果相似度小,权重就小;对于正的配对,如果相似度小,权重就大,如果相似度大就小:

Combinations of Gradient Components

在这一节中,我们从DML的三元权重和配对权重方面剖析了许多以前的损失函数。表1显示了如何将Gradient Components的不同组合映射到现有的损失函数中。除了这些组合之外,其余标注为 "新 "的组合都是未曾探索过的。如果训练需要损失函数,这些gradient component组合就很难被探索,如果它们不是可整合的,就几乎不可能的。然而,在我们的GOAL框架下,我们能够用这些梯度训练一个模型。

表1. 将三联体权重和成对权重的不同梯度组合映射到现有的DML损失函数中。在我们的GOAL框架下,标记为 "新 "的组合是可以被探索的

实验

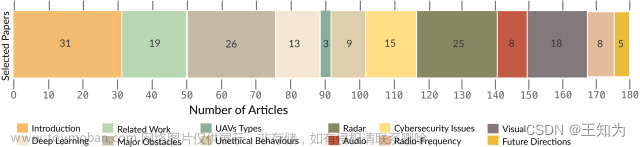

我们直接用梯度目标取代三个开源作品中的损失模块: VSE++、VSE∞和X-VLM,并保持所有其他训练设置与他们的原始工作相同。我们在前面测试了这三个作品中由三联体权重和成对权重组合形成的所有可能梯度目标。每个目标运行3次,以消除来自批次随机抽样和联合空间映射层随机初始化的随机性造成的影响。我们报告了两种常见的检索结果,即图像到文本检索和文本到图像检索,用Recall@1的平均值和标准偏差作为两个数据集的衡量标准。

我们在最新的最先进的方法X-VLM[40]中应用了相同的梯度目标,在下游微调中替换了其对比性损失项。这个结果被称为 “X-VLM ours”。我们继续在MSCOCO 5K测试和Flickr 1K测试中推动最先进的结果的边界。

表6. 我们在MS-COCO 5K和Flickr 1K测试中使用所提出的GOAL框架设计的新型损失函数进行的最先进的图像-文本检索结果文章来源:https://www.toymoban.com/news/detail-487573.html

结论

我们提供了一个新的框架GOAL,用从深度度量学习损失函数中剖析出来的梯度成分组合来训练图像-文本匹配任务。在实践中,所提出的梯度目标可以很容易地应用于替代损失函数的训练。对三重权重和一对权重的详尽组合进行的实验表明,三重权重和一对权重对检索性能都有各自的影响,一般来说,Tcir和Psig-ms的组合在图像-文本检索中取得了最佳性能。这个框架有助于找到更好的梯度目标,这些梯度目标在这一领域从未被探索过,并在多种既定方法上提供了一致的检索改进,包括取得新的最先进的结果。文章来源地址https://www.toymoban.com/news/detail-487573.html

到了这里,关于跨模态检索论文阅读:Dissecting Deep Metric Learning Losses for Image-Text Retrieval(GOAL)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!