导语

图1. ChatGPT生成的关于智能写作的介绍

智能写作指使用自然语言处理技术来自动生成文本内容。这种技术通过分析给定语料库,学习文本的结构和语法,然后利用这些信息来生成新的文本。智能写作可以用来快速生成高质量的文本内容,并且可以用来完成诸如文章写作、报告生成和摘要提取等任务。

图1为我们介绍了智能写作的基本概念,而令人意想不到的是,这一段介绍的作者竟是AI本身!这一段AI自动生成的“自我介绍”既富有逻辑条理,又阐述了正确的知识,这便是当下最火热的AIGC技术的威力!

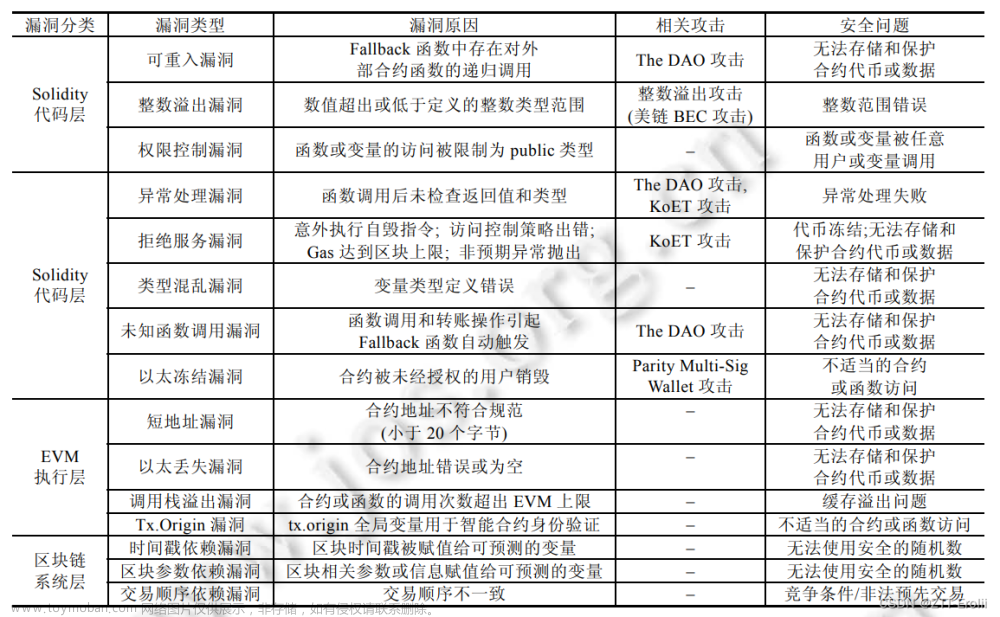

什么是AIGC?AIGC,即AI-generated Content,基于AI的内容生产,它是利用人工智能进行内容创作的方式,它被认为是继PGC(Professionally-generated Content)、UGC(User-generated Content)之后的新型内容创作方式。AIGC在文本、图像和音视频等多领域都正在高速发展,近年来诞生了许多主打AIGC的创作体验平台,用户可以输入一句话让AI合成一张与描述关联的图片,或者更为常见的是输入一句文章的描述,或仅仅是一句故事的开头,让AI替你完成文章的续写。智能写作在我们的日常办公中具有相当好的落地前景,例如新闻写作、诗歌春联、故事写作、广告文案、金融报告、行政文书等办公场景,这些场景都有相关智能写作产品得到应用,可以看到智能写作技术能够为包括资讯、金融、广告、政法等各行各业的从业者提供便捷且高质量的文本写作服务,帮助人们更快地理解和分析复杂的信息,从而帮助人们更好地做出决策,产生重要的价值。这一切生产力提高的愿景正在逐步成为现实,背后原因是技术的发展和提升,下图为笔者整理的AIGC用于智能写作的相关技术发展脉络。

图2. 文本写作的相关重要技术

文本写作技术在很长一段时间里以RNN Seq2Seq为主,发展迟缓,而当Transformer模型结构问世后,这一领域的技术发展迅速爆发,围绕着Transformer的文本写作技术喷涌而出,包括微软亚洲研究院、谷歌AI、Facebook AI、OpenAI等诸多国际知名研究机构都纷纷投入,先后诞生了UniLM(2019)、MASS(2019)、T5(2020)、BART(2020)、GPT系列(2018-2022)等多个影响力显著的研究成果。本文将沿着这条技术发展脉络,从传统的智能写作到如今的前沿研究为读者做详细的阐述,并为大家介绍达观数据的智能写作产品实践。

智能写作相关技术背景

01任务定义

在深入了解相关技术之前,我们先对文本写作任务进行一个数学上的形式化定义。文本写作任务的核心是生成一个字符串组成的序列Y = (y1,...,yi,...,yn ),其中yi∈ν,ν是一个给定的词汇表。在大多数情况下,文本写作需要以输入作为条件进行生成,输入的数据可能是文章主题,或者是文章的开头句等等,我们用X表示输入。基于以上定义,文本写作任务建模可以表示为P(Y|X) = P(y1,...,yi,...,yn |X),其中P表示概率分布函数。

02数据集

写作任务公开的评测数据集,在英文上有CommenGen、ROCStories、WritingPrompts等若干数据集,而在中文上有Couplets、AdvertiseGen等若干数据集,数据集的概述见表1。

表1. 文本写作任务相关评测数据集

03评测指标

文本写作任务需要量身定制的指标能够对技术的优劣进行评测,通常写作的好坏会从四个角度进行度量:

-

流畅度(fluency):生成文本的流畅程度;

-

真实性(factuality):生成文本在多大程度上反映了语境;

-

语法(grammar):生成文本的语法正确性;

-

多样性(diversity):生成的文本是否具有不同的类型或样式。

通常此类任务的评测最好的方式当属人工,然而人工评测的成本巨大,为此,业界设计了以下几种自动评测的量化指标,这些指标通常是量化生成文本和参考文本之间的相似度。比较常用的有基于词汇和基于语义的相似度度量。

3.1 基于词汇

基于词汇的度量是衡量单词或短语单元的重合度,然后聚合到整体句子级相似度,包括:

-

BLEU-n,计算生成文本和参考文本的n-gram单元的重合度,最为广泛使用的是BLEU和BLEU-2;

-

Self-BLEU,用来衡量生成文本的多样性,即在多条不同的生成文本之间计算BLEU值,Self-BLEU越小则多样性越强;

-

ROUGE-n,同样是计算生成文本和参考文本的ngram单元的重合度,不同点在于BLEU是重合n-gram数/生成文本n-gram数,而ROUGE是重合n-gram数/参考文本n-gram数,因此可以看做召回版本的BLEU;

-

Perplexity(PPL)和Reverse PPL,PPL是在参考文本上训练语言概率模型,然后用它计算生成文本的概率,概率越高则表示生成文本越流畅;而Reverse PPL则是在生成文本上训练语言概率模型,然后反过来计算参考文本的概率,概率越高则表示生成文本越多样。

3.2 基于语义

相比基于词汇的方式,基于语义可以把字面不相似而语义相似的情况也纳入考量,是一种更贴近人工评测的方式,这其中包括:

-

dssm,利用深层语义相似模型分别将生成文本和参考文本映射到一个低维语义表示空间,并计算生成文本向量和参考文本向量的距离;

-

BERTscores、BERTr、YiSi等,近年来涌现的基于预训练模型的评测方法,利用BERT的embedding表示代替n-gram,计算生成文本和参考文本的相似性。

04重要技术脉络文章来源:https://www.toymoban.com/news/detail-488248.html

文章来源地址https://www.toymoban.com/news/detail-488248.html

文章来源地址https://www.toymoban.com/news/detail-488248.html

到了这里,关于AIGC用于智能写作的技术综述-达观数据的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!