下面所有博客是个人对EEG脑电的探索,项目代码是早期版本不完整,需要完整项目代码和资料请私聊。

数据集

1、脑电项目探索和实现(EEG) (上):研究数据集选取和介绍SEED

相关论文阅读分析:

1、EEG-SEED数据集作者的—基线论文阅读和分析

2、图神经网络EEG论文阅读和分析:《EEG-Based Emotion Recognition Using Regularized Graph Neural Networks》

3、EEG-GNN论文阅读和分析:《EEG Emotion Recognition Using Dynamical Graph Convolutional Neural Networks》

4、论文阅读和分析:Masked Label Prediction: Unified Message Passing Model for Semi-Supervised Classification

5、论文阅读和分析:《DeepGCNs: Can GCNs Go as Deep as CNNs?》

6、论文阅读和分析: “How Attentive are Graph Attention Networks?”

7、论文阅读和分析:Simplifying Graph Convolutional Networks8、论文阅读和分析:LightGCN: Simplifying and Powering Graph Convolution Network for Recommendation

9、图神经网络汇总和总结

相关实验和代码实现:

1、用于图神经网络的脑电数据处理实现_图神经网络 脑电

2、使用GCN训练和测试EEG的公开SEED数据集

3、使用GAT训练和测试EEG公开的SEED数据集

4、使用SGC训练和测试SEED数据集

5、使用Transformer训练和测试EEG的公开SEED数据集_eeg transformer

6、使用RGNN训练和测试EEG公开的SEED数据集

辅助学习资料:

1、官网三个简单Graph示例说明三种层次的应用_graph 简单示例

2、PPI数据集示例项目学习图神经网络

3、geometric库的数据处理详解

4、NetworkX的dicts of dicts以及解决Seven Bridges of Königsberg问题

5、geometric源码阅读和分析:MessagePassin类详解和使用

6、cora数据集示例项目学习图神经网络

7、Graph 聚合

8、QM9数据集示例项目学习图神经网络

9、处理图的开源库

摘要:

脑电图(EEG)通过电极测量大脑不同区域的神经元活动。现有的许多基于EEG的情绪识别研究并没有充分利用EEG通道的拓扑结构。在本文中,提出了一种正则化图神经网络(RGNN)用于基于脑电图的情绪识别。RGNN考虑了不同脑区域之间的生物拓扑结构,以捕捉不同脑电信号通道之间的局部和全局关系。具体来说,通过图神经网络中的邻接矩阵来建模脑电图信号的通道间关系,其中邻接矩阵的连接和稀疏性受到人类大脑组织的神经科学理论的启发。此外,提出了两个正则子,即节点域对抗训练(NodeDAT)和情绪感知分布学习(EmotionDL),分别更好地处理跨受试者EEG变化和噪声标签。在两个公共数据集(SEED和SEED- iv)上进行的大量实验表明,在大多数实验环境中,的模型比最先进的模型具有更好的性能。此外,消融实验表明,所提出的邻接矩阵和两个正则子对的RGNN模型的性能贡献了一致和显著的增益。最后,对神经元活动的研究揭示了基于EEG的情绪识别的重要脑区和通道间关系。

当前EEG存在的问题:

现有的大多数基于EEG的情绪识别方法都没有解决以下三个问题:

1)无法有效利用EEG通道的拓扑结构来学习更具鉴别性的EEG表征;

2)脑电信号在不同受试者之间存在显著差异,这阻碍了训练后的分类器在与受试者无关的分类环境下的泛化;

3)参与者在观看引发情绪的刺激时,可能并不总是产生预期的情绪。因此,采集到的EEG数据中的情绪标签可能存在噪声,与实际诱发的情绪不一致。

主要贡献:

1)提出了一种基于EEG信号的正则化图神经网络(RGNN)模型捕捉了局部和全局的通道间关系来识别情绪。

2)提出了两个正则器:节点域对抗训练(NodeDAT)和情绪感知分布学习(EmotionDL),分别提高了的模型对跨受试者变化和噪声标签的鲁棒性。

3)在两个公共脑电图数据集,即SEED[7]和SEED- iv[24]上,在受试者依赖和受试者独立分类设置下进行了广泛的实验。实验结果证明了该模型和正则子的有效性。此外,的RGNN模型在大多数实验环境中比最先进的模型获得了优越的性能。

4)研究了情绪神经元的活动,结果表明,前额叶、顶叶和枕叶区域可能是情绪识别的信息最丰富的区域。此外,左右脑之间的整体通道间关系也很重要,(FP1, AF3), (F6, F8)和(FP2, AF4)之间的局部通道间关系也可能提供有用的信息。

EEG数据构建图模型的方法:

在本节中,介绍了的正则化图神经网络(RGNN),特别是生物学启发的邻接矩阵,RGNN的动态,以及两个正则化子,即节点域对抗训练(NodeDAT)和情绪感知分布学习(EmotionDL)。

RGNN中的邻接矩阵 A ∈ R n × n A∈R^{n×n} A∈Rn×n表示脑电通道的拓扑结构,是图表示学习的必要条件,其中n表示脑电信号中的通道数。每个值 A i j A_{ij} Aij都是可学习的,表示通道i和j之间的连接权值。注意A包含自循环。为了减少过拟合,将A建模为一个对称矩阵,只使用 n ( n + 1 ) / 2 n(n+1)/2 n(n+1)/2个参数而不是 n 2 n^2 n2个。Salvador et al.[55]观察到,大脑区域之间的连接强度衰减为物理距离的平方反比函数。因此,在邻接矩阵中初始化局部通道间关系,如下所示:

其中 d i j , i , j = 1 , 2 , … , n d_{ij}, i, j = 1,2,…, n dij,i,j=1,2,…,n为通道i和通道j之间的物理距离,由记录设备数据表中获得的通道i和通道j的三维坐标计算得出,δ > 0为校准常数。Achard和Bullmore[56]观察到,稀疏的fMRI网络占所有可能连接的20%左右,通常能最大限度地提高网络拓扑的效率。因此,选择δ = 5,使得A中大约20%的值是不可忽略的。根据经验,将值大于0.1的值视为不可忽略的连接。

Bullmore和Sporns[19]认为,大脑组织是由最小化神经路径成本和网络运行成本之间的经济权衡所形成的。局部通道间连接有利于最小化神经路径成本,如(9)所示。然而,某些全局通道间连接有利于最小化网络运行成本,以实现整个网络的高效信息传输。为此,在邻接矩阵中增加了几个全局连接来提高网络效率。全局连接取决于实验中所采用的特定电极位置。图2描述了SEED[7]和SEED- iv[24]的全局连接。全局通道的选择得到了先前研究的支持,这些研究表明,左右半球之间神经元活动的不对称性在价态和唤醒预测方面提供了信息。为了利用差分不对称信息,将A中的全局通道间关系初始化为[−1,0],如下所示:

式中(i, j)表示全局通道对的通道对:(FP1, FP2), (AF3, AF4), (F5, F6), (FC5, FC6), (C5, C6), (CP5, CP6), (P5, P6), (PO5, PO6)和(O1, O2)。请注意,选择这些通道对是因为1)它们与邻近的大量节点相连,这最大限度地提高了EEG不对称的影响;2)它们的经验表现略好于其他通道对(见章节7.1)。在(9)和(10)中得到的邻接矩阵A旨在表示既结合了局部结构连通性又结合了与情绪相关的全局功能连通性的大脑网络。

实验和结论:

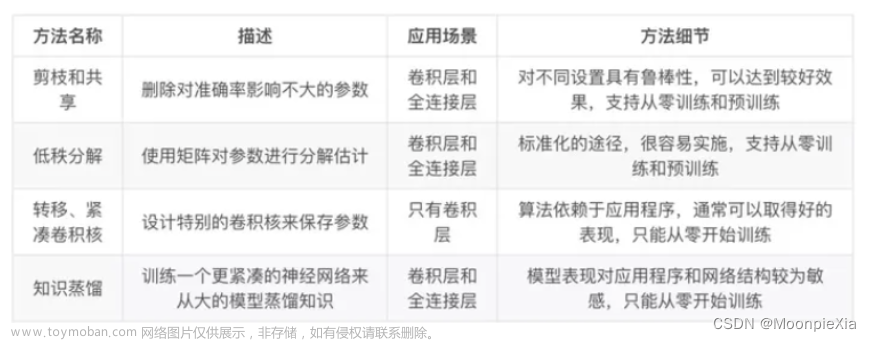

1、RGNN算法和其他算法

2、不同的图初始化方式、对称邻接矩阵、全局连接方式

correlation-based 和coherence-based 由SEED数据集计算得到,不同通道的相关性邻接矩阵和一致性邻接矩阵;

算法流程

算法流程如图所示,算法中设计的公式如下:

计算对角度矩阵:

式(3)中,D为A的对角度矩阵,即 D i i = ∑ j A i j D_{ii}=\sum_j A_{ij} Dii=∑jAij。归一化邻接矩阵 D − 1 2 A D − 1 2 D^{-\frac{1}{2}} AD^{-\frac{1}{2}} D−21AD−21可以防止H变得过大。

计算归一化邻接矩阵S:

式(5)中, S = D − 1 2 a n d W = W 0 W 1 . . . W L − 1 S = D^{-\frac{1}{2}} and W = W^0W^1 ...W^{L−1} S=D−21andW=W0W1...WL−1 .

计算KL loss:

式(17) p ( Y ∣ X i , θ ) p(Y|X_i,θ) p(Y∣Xi,θ)denotes the output probability distribution computed via (12).

计算概率分布:

式(12)中 S ∈ R n × n , W ∈ R d × d 1 S∈R^{n×n}, W∈R^{d×d^1} S∈Rn×n,W∈Rd×d1和L遵循(5)中的定义, σ ( x ) = m a x ( 0 , x ) σ(x) = max(0, x) σ(x)=max(0,x)表示非线性变换, W O ∈ R d 1 × C W^O∈R^{d^1×C} WO∈Rd1×C表示输出权重矩阵,pool(·)表示图上所有节点的和的池化(sum pooling)。

计算域损失:

式(13)其中

θ

D

θ_D

θD表示域分类器的参数,0和1分别表示源域和目标域。

域分类器学会将源数据分类为0,将目标数据分类为1。第i个样本第j个节点的域概率pj(·)计算为

式(14) Z i j { S , T } Z^{\{S,T\}}_{ij} Zij{S,T}denotes the jth node representation in Z i { S , T } Z^{\{S,T\}}_{i} Zi{S,T}, and W D ∈ R d 1 × 2 W^D ∈ R^{d^1 ×2} WD∈Rd1×2 denotes the matrix parameter in the domain classifier, i.e., θ D θ_D θD.

参考文献:文章来源:https://www.toymoban.com/news/detail-488741.html

[1]EEG-Based Emotion Recognition Using Regularized Graph Neural Networks | IEEE Journals & Magazine | IEEE Xplore

[2]GitHub - zhongpeixiang/RGNN: The model for the paper “EEG-Based Emotion Recognition Using Regularized Graph Neural Networks”

[3]图神经网络之神器——PyTorch Geometric 上手 & 实战 - 知乎 (zhihu.com)文章来源地址https://www.toymoban.com/news/detail-488741.html

到了这里,关于图神经网络EEG论文阅读和分析:《EEG-Based Emotion Recognition Using Regularized Graph Neural Networks》的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[自注意力神经网络]Segment Anything(SAM)论文阅读](https://imgs.yssmx.com/Uploads/2024/02/423006-1.png)

![[论文阅读] (27) AAAI20 Order Matters: 基于图神经网络的二进制代码相似性检测(腾讯科恩实验室)](https://imgs.yssmx.com/Uploads/2024/02/620112-1.png)