内容来源:机器之心,百度文心一格总架构师肖欣延博士,《跨模态内容生成与技术与应用》的演讲。

内容生成概览

1. 图像生成

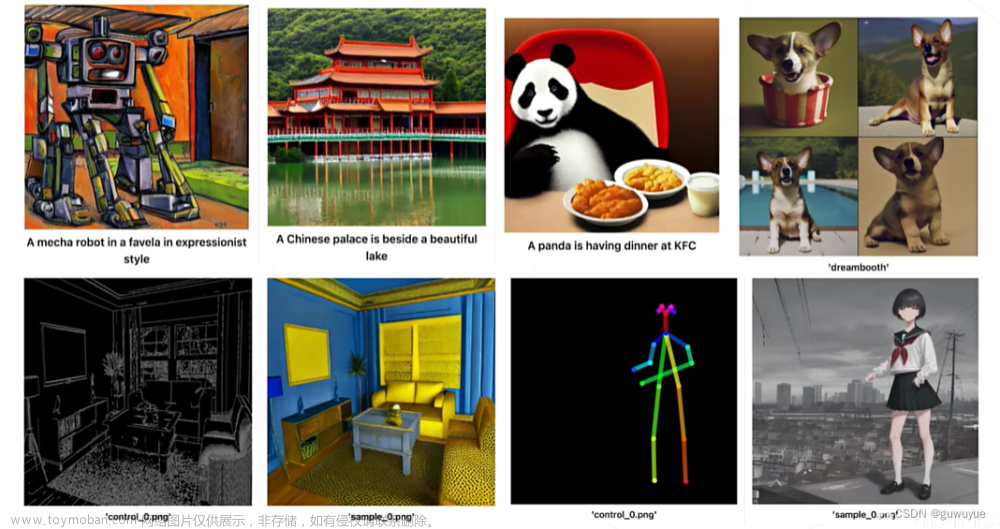

从图像生成角度来看,下图左边是 2020 年图像生的水平,是很有代表性的一个拍卖画作。到了 2022 年,技术已经相比之前强了很多。我们任意说一句话就能生成一张非常精致的图,不管是非常复杂的山水图,还是很精致很细腻的人物画像,都能做得很好了。我们可以感受到整个内容生成方向的进展是非常迅速的。

2. 语言生成

除了图像生成,语言生成的进展也很快。直观来讲,以前更多的是在比较短的文本上生成得比较好。但到了今年,长文本的内容,比如故事生成、长文案生成,还有多轮聊天,文本生成都能做得很好。它能兼顾到前后的连贯性,甚至有时能保证逻辑上的一致性。

3. 视频创作

更综合的就是视频创作。视频创作是让机器能够自动创作出一个完整的视频。视频会涉及到文案、画面和歌曲等很多元素。这是百度最近在万象大会上发布的,由 AI 度晓晓作词作曲演唱的 MV《启航星》,里面所有的画面都是用百度的文心一格画出来的。能够看到 AI 能根据歌词的变化,每个变化切换一个场景。

2. AIGC介绍

整体上,前面讲到的这些都是智能内容生产,也就是今年大家常说的 AIGC。所谓 AIGC 就是用人工智能来进行内容生产,它的特点是有非常强大的内容生产力,大幅提升内容生产的质量和效率,将来也会极大地丰富大家的数字生活。

这里给了一个简单的对比图,整个内容生产从专业的 PGC 到用户生产的 UGC,现在已经进入了 AIGC 的时代。相信 在 AIGC 的时代,整个内容生产的方式,还有内容消费的模式都会有极大的改变。

3. 跨模态内容生成

核心来讲,我们希望用文本的描述来生成视觉的内容。比如说一句话能生成一个图像,或者我们写一篇文章,能把文章自动转成视频。

3.1 文本生图像(文生图)

整体来讲,文生图在 2018 年或更早就有很多研究,我们能看到从 2020 年之后该方向进展很多。从应用角度来讲,很大的一个变化还是在 2022 年扩散模型的图像生成出现,使得整个跨模态生成有了一种跨越式的发展。

可以看到,2022 年的图像生成质量相比之前有非常大幅的提升,不管是从构图,还是细节刻画上。这种扩展生成模型如图所示,其实是依照原有图像,逐步增加高斯噪声,将图像转化为高斯分布。这样的处理序列是一张清晰的图片,逐渐变成噪声的过程,这是一个前向过程。而模型要学习的是把噪声去除掉,逐渐的恢复出原始照片。

一旦我们的模型有这样能力,也就是从噪声里面去逐步地去噪,生成更好的图片,它其实上就具备了这种生成图像的能力了。

这是一个简单的描述,扩展生成从应用的角度来讲有这样几个优势:首先,模型的记忆能力是非常强的。我们可以通过提高数据的规模持续地优化。在 2020 年到 2021 年的时候,像 DALL-E 这些模型的数据量的训练规模大概在千万到亿级别这样的量级。到了今年,像 Stable Diffusion 这样的模型的训练规模已经达到了 10 亿的量级。

这么大的数据之下,它对原来图片的记忆能力也挺好的,不会说因为有很多图片,有些东西就没记住。因为记忆能力很强,它的模仿能力就有一定的保证。另外现在它的建模是像素粒度的建模,所以更适合视觉的建模。它能够生成大像素的图片,甚至有一些技术能够无限地扩大整个图片的像素,这样就能够生成一些实用的高清图片。

从技术上来看,Stable Diffusion 确实打开了一个天花板,把效果的上限提升了很多。但在实际的应用当中,并不是直接使用这样一个模型,就能满足应用要求的。好的模型不是简单就等于好的体验。在实际应用当中,从创作过程来讲有三个步骤是需要去解决的。

- 第一个是创作的需求理解。在

跨模态生成里面,我们都是需要输入语言去跟模型交互的,用户到底怎样简单地输入就能拿到一个他希望的图,这就需要一定的需求理解。 - 第二个是图像的生成,也是跨模态生成的核心的部分,在这一部分里用户的需求也很多,有艺术的、写实的,创作的模型该如何去满足。

- 最后是创作需求的满足。很多时候生成一张结果,可能只是部分满意,怎样进行一定的调整满足用户的需求,也是需要通过模型优化去解决的。

面对这些问题,百度研发了一套基于知识与大模型的文生图系统。整体来看,当输入文字描述之后,会先通过知识图谱做需求的理解,进行一定的文本联想扩展。生成文本之后再真正进行跨模态生成,这里面我们有很多跨模态生成模型上面的创新优化。生成完图之后,又会有基于图到图的扩散生成,来支持用户做图像的编辑。最后,因为系统应用到产品上生成图像结果后,用户会有一些反馈,我们也要利用用户的反馈去指导整个学习的模型优化过程,形成一个根据用户需求去进行反馈的闭环。

首先要做文本理解,也就是我们常说的 Prompt 学习,这里面其实主要是要做一些理解,并根据知识进行扩充。

比如用户可能想画一个大楼,一开始可能没有想得很明白需要什么,会输入一个很简单的「大楼」单词。而真正的生成画作,可能有很多方面要去考虑。这个时候,模型就会进行一定的文本理解。根据分析理解的结果,算法主动地帮输入加上一些风格,比如到底是写实风格还是艺术风格,它的色调是怎么样的。当然理解跟扩充从算法上也可以做端到端的生成。不管是哪种方式生成了扩展之后, 所有构建出来的 Prompt 都会进行排序,最后分别生成图片供用户去选择。

Prompt 学习是非常重要的,这里给一些例子,我们能看到加不加这些 Prompt 的扩展,效果影响还很大的。比如在文心一格上面输入「微笑女孩」,可能生成的是左边这张图,但是模型会帮他加很多扩展。比如会把这种数字绘画、逆光、电影照明,包括超精细这样一些修饰词都加入进来。

加入之后,我们能看到图片生成会更加有艺术感,质量也会更高。类似的,像天空,大海等景色的图片,都可以通过一些 Prompt 扩展能够使效果有显著的提升。

当然,最核心的部分还是文生图。文本已经确定下来了,输入到系统里面,效果一定要足够的好。为此,百度提出了 ERNIE-ViLG 2. 0,这是一个知识增强的混合降噪专家模型。

从图文相关性上面来看,在跨模态生成里面,语言跟视觉之间的对应关系要做得很好,才能保证用户说什么就生成什么。技术上主要通过对语言、视觉还有跨模态做一些知识增强,更好的实现跨模态知识之间的映射,从而实现图文相关性的提升。

另外我们也提出了一个混合专家扩散模型,扩散模型就像前面说的,是有从有噪声的图像逐步生成一个清晰的画面。这个过程在不同的阶段,对扩散生成的要求是不一样的,所以我们设计了混合专家模型,自动地根据不同阶段选择合适的网络,生成最优的结果。这样整体上模型的建模能力也会更强,生成图片会更加的细腻,构图也更加的清晰。

从实验上也能很直观地看到效果的提升。我们在 MS-COCO 数据集上面做了自动评估,可以看到 ERNIE-ViLG 2.0 在 FID 自动评估上面是当前业界最好的效果。从人工的评估的角度,不管从图像的质量还是图文的对齐,ERNIE 的效果都会更好。

这边给了几个例子,能看到 ERNIE 能生成很精细的图,同时也会生成一些很有创意的图,比如孙悟空穿西装、熊猫在撸串。

可以看到,现在 AI 的创意能力是很强的,至少它能从过去的数据当中学习到组合关系。并且从我们的观感上会认为它有一定的创造力,虽然它还是在模仿,但会感觉它的组合能力很强,会展现一定的创造能力。

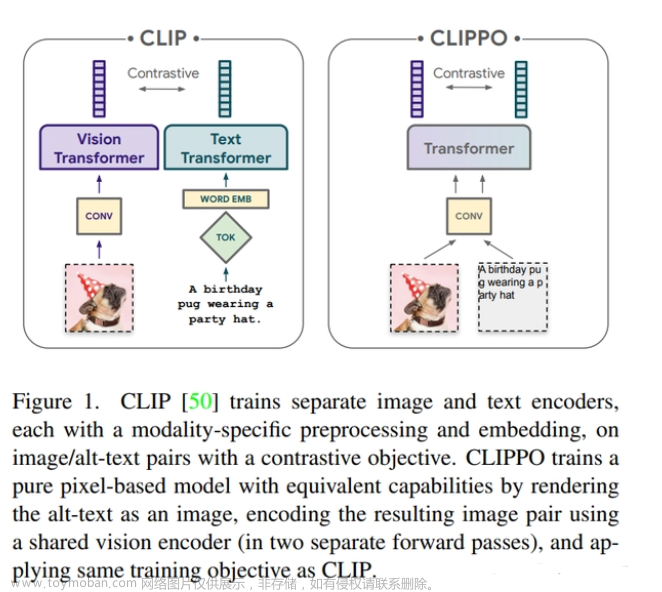

在模型上我们还有更进一步的创新。像前面介绍的模型,它其实本质上需要一个文本的输入作为条件去进行扩散生成。这种模式其实就是咱们常见 Stable Diffusion 模型。它通常能生成的图就是比较具象的图,比如画人物,画一些具体的物体,它能画得很好。其实还有另外一类叫做 Disco Diffusion 的模型,它是通过跨模态来引导的,通常能生成意向的图,它比较重视整体的构图,整个构图会比较复杂。

我们的想法也比较直观:能不能把两种引导都融合在一起去支持扩散生成?让扩散生成既依赖于条件的输入,也依赖于整个跨模态匹配的在线的指导,这样就能同时做好两种场景,不管是画人物,还是做很复杂的构图生成。为此,我们提出了文本与跨模态联合引导的统一图像生成 UPainting。对 UPainting 这样的模型,能看到它在图像的各方面能力上都做得更好。

最后一块是图像编辑。画了一个图之后,有时可能不是自己最满意的,希望再进行一次修改。所以百度研发了基于文本驱动的图到图的生成。简单来讲,扩散生成除了依赖于编辑文本的描述,也会依赖于图片的输入。并且我们有个注意力机制来保证扩散过程当中能够更关注用户输入的编辑指令。

具体来讲,图像编辑主要有以下几种功能。首先是元素修改,比如我们已经画了一只猫,但突然想给猫再加一点装饰,给它戴上个眼镜,戴上金链子,就可以通过这样的功能去生成。另外也可以做风格转换,比如像前面输入大楼,已经生成一个真实景观的风格了,但是我们希望把它改成一种比较科幻的,也可以做修改。最后是基于模型已经生成的一张图做二次生成,让模型重新生成一下,它会生成一个比较相近的同款图。这些都是图像编辑。

以上的第一个部分都是文生图,主要是基于语言来进行 AI 绘画。

3.2 文章转视频

第二块是关于视频创作的,能够根据一篇文章来生成一个视频。这个功能非常简单,如图所示,用户输入图文信息,可能是一篇文章,一个搜索 query,甚至可能是一个 PPT,系统就能生成一个视频。

视频的生产其实是比较复杂的,它需要生成其中的文本、视觉,还有语音,有些时候还需要把数字人做出来。还会有视频脚本,规定了整个场景怎么划分,转场建议等。这里面要涉及到模型计算特别多。为了解决这样的问题,并不能用一个简单的模块完成,而是需要一个系统。

整体来讲,我们研发的 TTV 系统逻辑上是模仿人的创作过程的。首先要做文案的理解和组织。还要有一个素材库,这个素材库里有些是从网上获取的真实素材,也有可能是通过 AI 生成的素材。素材都有了之后,再去做所谓的编排,把素材跟文案做对齐,保证最后生成出来的字幕音频和展示的视觉画面是对齐的。

这里面的思路有几种。①一种是全部使用生成的素材,也就是原生生成,②一种是在已经给定素材之后,进行所谓的素材采编。接下来我就先说一下采编方面的技术。介绍完之后,再说一下纯原生的技术。

- 视频采编

首先在视频采编中,给定一篇文章,类似于文生图里面要做 Prompt 构造一样,我们要主动地去构造一个 query,它能够帮助我们去检索相关的素材。整体上简化可以用标签的技术去做,但是更理想的是通过结构化的分析,生成组合的有完整语义的 query 来保证效果。

构建完 Query 后,我们要做素材的扩充,主要是通过匹配的模型,用一个多域多属性的统一匹配,确保有一个非常好的效果。

当素材已经都选回来之后,要把它们放到合适的字幕位置上面。这里主要通过一些语义相关性的计算,计算字幕和素材的语义相关性,计算完之后,素材被放在合适的位置,保证了整个视频的流畅度。

2. 视频原生生成

我们也做了一些原生的视频生成。最早一开始展示的《启航星》的视频,是通过文生图的技术来做的。给到一篇文章之后,我们通过文生图的技术生成一些关键帧,再把这关键帧结合起来,生成一个视频。

更进一步,还可以做端到端的文生视频,不止真人图像,还可以把动态效果都做出来。这里是百度自研的 VideoDream 模型。整体上来讲,它跟文生图是比较像的,但相比之下它除了生成一张图像,还会生成多帧,形成动态的效果。这里是一些展示的效果。

文生图、文章转视频都是基于语言来生成视觉内容的技术。

3.3 讨论和展望

从应用的角度来看,AIGC 当下正在发生,它已经在大幅地提升内容创作的质量和效率。我们至少从文生图上观察到它提升了几个量级的效率。以前专业的画师,在一些复杂的画作上,可能需要积累好几年才能构建的素材,现在通过 AI 作画能短时间大量生成。

对于普通用户来讲,它也会成为普惠的人类助手,让每个人将来都可以拥有很强的创作力。

最后是跨模态生成的一些现存的问题。首先是易用性问题。在应用中,用户需要输入文本描述。但事实上,输入文本描述是很复杂的。比如左侧的例子,需要这里密密麻麻的文字才能生成一个图片。再比如右边文心一格的例子上,通用需要这么一大串文字,不管是主体、内容、风格各方面都需要描述才能生成足够好。所以易用性是要进一步提升的。

另一个是可控性。现在模型虽然能生成很精致的图片,但是对于用户指定的数量、位置关系等,并不一定能准确生成。同时有些时候用户输入风格描述之后,因为风格模型会过度拟合到特定场景上面,导致图像结果不符合预期。

4. 总结

AIGC 时代已经到来了,百度研发了文生图的技术,发布了 AI 作画的创意产品文心一格。在文章转视频上,目前已经综合各种 AI 能力实现工业化的、可落地的文章自动转视频能力。文章来源:https://www.toymoban.com/news/detail-492181.html

展望未来, AIGC 的技术会不断地提升,打造出更强大的用户体验,它的应用场景也会越来越拓宽。最终 AIGC 会无处不在。相信这个过程里面也会产生一些新的职业,如 AI 绘画师、 AI 自媒体,带来更多的就业机会,对社会产生正面的影响。文章来源地址https://www.toymoban.com/news/detail-492181.html

到了这里,关于【AIGC】百度:跨模态内容生成技术与应用的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!