模型

不需输入输出为随机过程,求最优权向量使得输出估计结果的样本均方误差最小

b

^

⃗

H

=

w

⃗

H

A

H

{

b

^

H

=

[

d

^

(

M

)

d

^

(

M

+

1

)

⋯

d

^

(

N

)

]

A

H

=

[

u

(

M

)

u

(

M

+

1

)

⋯

u

(

N

)

]

=

[

u

(

M

)

u

(

M

+

1

)

⋯

u

(

N

)

u

(

M

−

1

)

u

(

M

)

⋯

u

(

N

−

1

)

⋮

⋮

⋱

⋮

u

(

1

)

u

(

2

)

⋯

u

(

N

−

M

+

1

)

]

w

=

[

w

0

w

1

⋯

w

M

−

1

]

H

m

i

n

{

J

}

{

e

=

b

−

b

^

J

=

e

H

e

\begin {align} &\vec{\hat{b}}^H=\vec{w}^HA^H \\ &\left\{\begin{aligned} \hat{b}^H&=\begin{bmatrix} \hat{d}(M)&\hat{d}(M+1)&\cdots&\hat{d}(N) \end{bmatrix} \\ A^H&=\begin{bmatrix} u(M)&u(M+1)&\cdots&u(N)\end{bmatrix}\\ &=\begin{bmatrix} u(M)&u(M+1)&\cdots&u(N)\\ u(M-1)&u(M)&\cdots&u(N-1)\\ \vdots&\vdots&\ddots&\vdots\\ u(1)&u(2)&\cdots&u(N-M+1)\\ \end{bmatrix}\\ w&=\begin{bmatrix} w_0 & w_1 &\cdots &w_{M-1} \end{bmatrix} ^H\\ \end{aligned} \right.\\ &min\{J\}\\ &\left\{\begin{aligned} &e=b-\hat{b} \\ &J=e^He \end{aligned} \right. \end {align}

b^H=wHAH⎩

⎨

⎧b^HAHw=[d^(M)d^(M+1)⋯d^(N)]=[u(M)u(M+1)⋯u(N)]=

u(M)u(M−1)⋮u(1)u(M+1)u(M)⋮u(2)⋯⋯⋱⋯u(N)u(N−1)⋮u(N−M+1)

=[w0w1⋯wM−1]Hmin{J}{e=b−b^J=eHe

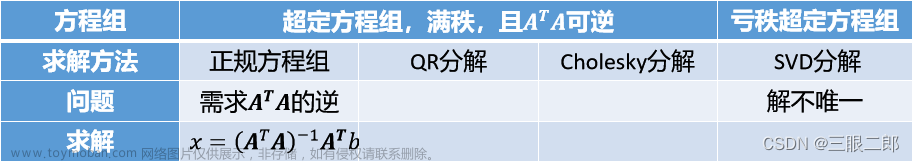

方法

最优权向量满足确定性正则方程:

A

H

A

w

^

=

A

H

b

A^HA\hat{w}=A^Hb

AHAw^=AHb文章来源:https://www.toymoban.com/news/detail-492451.html

算法

基于SVD的LS算法

LS最优权重仅与数据矩阵

A

A

A的奇异值和特征向量有关,故求得数据矩阵的奇异值和特征向量即可求得最有权重。

{

w

^

=

∑

i

=

1

K

(

x

i

⃗

H

θ

⃗

σ

i

2

)

x

i

⃗

θ

⃗

=

A

H

b

\begin{align} \left\{ \begin{aligned} &\hat{w}=\sum\limits_{i=1}^{K}(\frac{\vec{x_i}^H\vec{\theta}}{\sigma_i^2})\vec{x_i}\\ &\vec{\theta} = A^Hb \end{aligned} \right. \end{align}

⎩

⎨

⎧w^=i=1∑K(σi2xiHθ)xiθ=AHb

关于

A

H

A

A^HA

AHA是否奇异分类讨论:

{

非奇异

K

=

M

:

w

^

=

∑

i

=

1

M

(

x

i

⃗

H

θ

⃗

σ

i

2

)

x

i

⃗

奇异

K

<

M

:

w

^

=

∑

i

=

1

K

(

x

i

⃗

H

θ

⃗

σ

i

2

)

x

i

⃗

(

加入最小范数条件使得有唯一解

)

\begin{align} \left\{ \begin{aligned} 非奇异K=M:&\hat{w}=\sum\limits_{i=1}^{M}(\frac{\vec{x_i}^H\vec{\theta}}{\sigma_i^2})\vec{x_i}\\ 奇异K<M:&\hat{w}=\sum\limits_{i=1}^{K}(\frac{\vec{x_i}^H\vec{\theta}}{\sigma_i^2})\vec{x_i}(加入最小范数条件使得有唯一解)\\ \end{aligned} \right. \end{align}

⎩

⎨

⎧非奇异K=M:奇异K<M:w^=i=1∑M(σi2xiHθ)xiw^=i=1∑K(σi2xiHθ)xi(加入最小范数条件使得有唯一解)文章来源地址https://www.toymoban.com/news/detail-492451.html

到了这里,关于最小二乘估计理论的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!