requests是Python中的一种HTTP客户端库,用于发送HTTP请求并获取服务器响应。使用requests库可以轻松地进行常见的HTTP操作,如GET、POST、PUT、DELETE等,支持HTTPS和HTTP连接以及摘要验证、基本认证等身份验证方式。

因此,Python的requests库是一个很棒的选择,如果您需要编写一个简单又强大的网络爬虫或者是其他需要进行HTTP请求的程序。

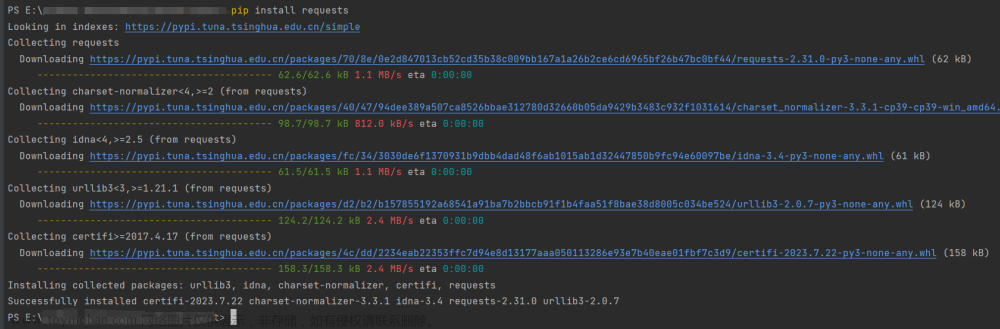

要安装Python的requests库,可以按照以下步骤进行操作:

1、打开命令行或终端窗口。

2、运行pip install requests 命令如果您的系统中有多个版本的Python,则需要使用相应版本的pip工具,如pip3 install requests。

如果一切顺利,安装过程应该会自动下载和安装requests库,并将其添加到Python环境中。安装完成后,您可以在Python中引入requests包,以便在编写HTTP客户端程序时使用它。

为了确保安装成功,您可以运行以下代码检查:

import requests

response = requests.get('https://www.baidu.com')

print(response.status_code)

以上代码发送一个GET请求至百度首页,并打印响应状态码。如果输出结果是200,则表明requests库已经成功安装,并且您可以使用这个强大的库来实现更复杂的HTTP客户端程序了。

requests库包含在Python标准库之外,因此需要通过pip安装。安装后,使用简单而直观的API即可完成HTTP请求/响应的处理。

以下是一个简单的Python requests库示例:文章来源:https://www.toymoban.com/news/detail-493774.html

import requests

# 设置请求头信息

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'

}

# 发送GET请求

response = requests.get('http://www.google.com', headers=headers)

# 输出响应状态码

print(response.status_code)

# 输出响应体中前100个字符

print(response.text[:100])

该示例首先构造了一个请求头信息,然后使用requests库的get()方法发送GET请求,并将响应结果保存在变量response中。最后,使用response.status_code属性获取响应状态码,使用response.text属性获取响应体中的HTML代码,并输出到控制台。文章来源地址https://www.toymoban.com/news/detail-493774.html

到了这里,关于Python(request)爬虫有多强大?的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!