由于CSDN上传md文件总是会使图片失效

完整的实验文档地址如下:

https://download.csdn.net/download/qq_36428822/85814518

实验环境

实验环境:本机:Windows 10 专业版 Intel® Core™ i7-4790 CPU @ 3.60GHz 8.00 GB RAM 64 位操作系统, 基于 x64 的处理器 Oracle VM VirtualBox

虚拟机:Linux Ubuntu 64-bit RAM 2048MB 处理器数量 4 显存大小 64MB

实验内容与完成情况:

- 使用IntelliJ IDEA工具开发WordCount程序

在Linux操作系统中安装IntelliJ IDEA,然后使用IntelliJ IDEA工具开发WordCount程序,并打包成JAR包,提交到Flink中运行。

安装Flink并启动:

安装maven:

使用IntelliJ IDEA写java:

使用maven打包JAR包

运行JAR包结果:

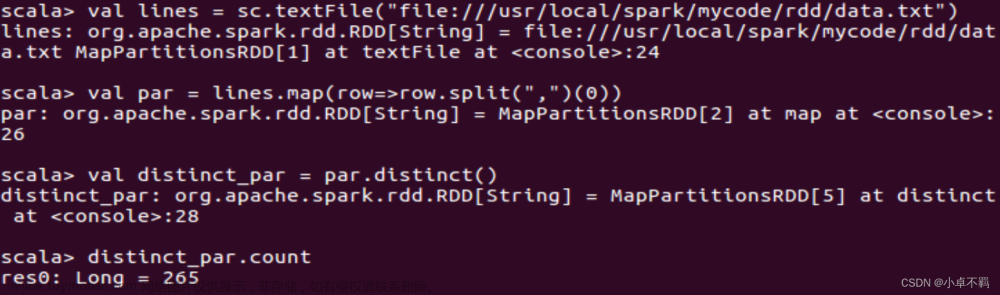

- 数据流词频统计

使用Linux操作系统自带的NC程序模拟生成数据流,不断产生单词并发送出去。编写Fink程序对NC程序发来的单词进行实时处理,计算词频,并输出词频统计结果。要求首先在IntelliJ IDEA中开发和调试程序,然后打包成JAR包部署到Flink中运行。

使用IntelliJ IDEA写java:

运行NC并输入数据:

运行JAR包:文章来源:https://www.toymoban.com/news/detail-494225.html

在flink控制台查看输出情况:文章来源地址https://www.toymoban.com/news/detail-494225.html

出现的问题:

- Idea里面引用flink报错

- Maven打包太慢

- Nc程序运行后程序没有输出

解决方案:

- 可以使用idea写代码,然后用maven打包

- 可以在maven的config里面部署阿里云的镜像,下载速度很快,和sbt相同

- Nc程序需要手动输入一些数据,然后在flink控制台查看输出,地址为:http://自己的ip地址:8081

到了这里,关于实验8 Flink初级编程实践的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!