Stable Diffusion and ControlNet Explained

如果你使用 Stable Diffusion 一段时间后,您可能已经注意到图像的输出结果具有无穷无尽的可能性。需要大量的试验才能生成高质量的图像,感觉就是在赌这一下能不能拍出好图。然而,即使输入复杂和详尽的提示,你也会觉得很难控制生成的图片的方向。对于这种情况,Stable Diffusion 为我们配备了名为 ControlNet 的扩展。

除了基本参数外,Stable Diffusion 还有很多扩展。每个扩展都具有重要作用,具体取决于你对最终结果的目标。本文将帮助介绍生成一张精确图片所需的其他控件,并了解每个控件如何帮助提升图片以符合你的喜好。

ControlNet 是 Stable Diffusion 的扩展,Stable Diffusion 是斯坦福大学研究人员开发的一种新型神经网络架构,旨在让创作者轻松控制 AI 图像和视频中的对象。它将通过根据边缘检测、深度分析、草图处理或人体姿势等各种条件操纵图像生成来进行控制。ControlNet 可以概括为一种在 Stable Diffusion 中微调的简单方法。

这将允许在使用文本到图像和图像到图像功能创建图像时实现更高的精度和更好的控制。ControlNet 的流行是由于其使用简单。可以从来自互联网的任何照片生成既定的姿势或形状。我们将讨论 ControlNet 的每个部分,以了解每个配置如何影响输出。

一、安装

在我们深入了解 ControlNet 的设置之前,以防您的 Stable Diffusion 中没有任何 ControlNet 设置。我们将帮助指导您如何激活 ControlNet 扩展并在需要时下载一些选项。

- 转到 Available 选项卡;

- 单击 Load From 按钮,不要更改框内的URL;

- 在搜索栏中输入 controlnet,你将看到 sd-webui-controlnet 扩展名。单击安装按钮并等待它成功加载;

- 激活已安装的 ControlNet 扩展,需要先重启 UI,立即生效;

- 在 text2image 和 image2image 选项卡中找到 ControlNet 下拉选项卡。

二、基本功能

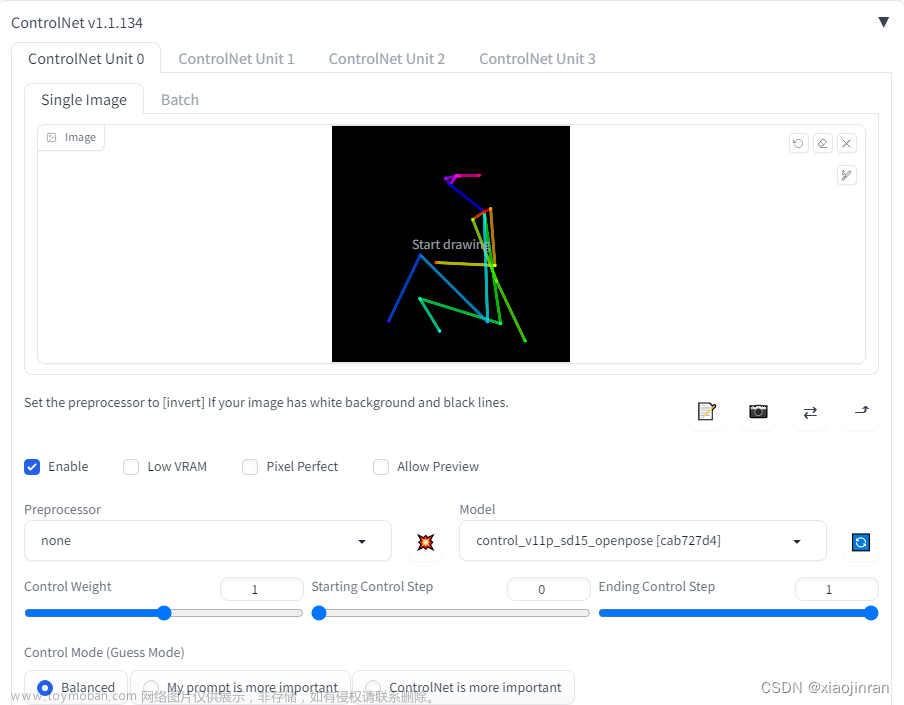

在 ControlNet 图像复选框内,有几个选项:文章来源:https://www.toymoban.com/news/detail-498422.html

- Enable:选中此框以在图像生成过程中启用 ControlNet。

- Low VRAM:这会减慢 ETA 过程,但有助于使用更少的计算空间(小于 6 GB VRAM)。

- Pixel Perfect:通过启用该按钮,不必手动配置 Preprocessor 的分辨率。ControlNet 将为你计算最佳注释器分辨率,确保每个像素都与稳定扩散准确对齐。

- Allow Preview:这允许你在单击以生成实际图像之前预览 ControlNet 的 Preprocessor,它可以节省很多时间。

v1.1.220已删除:

Invert Input Color:此工具用于检测用户上传的图像。预处理器和模型通常需要黑色图像上的白线来检测图案。但是如果你在白色图像上有一条黑色线条,你可以使用这个工具来切换颜色。

RGB to BGR:此工具用于检测用户导入图像中的颜色信息。有时,图像中的颜色信息可能与扩展程序预期的不同。文章来源地址https://www.toymoban.com/news/detail-498422.html

到了这里,关于Stable Diffusion web UI之ControlNet使用的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!