前言

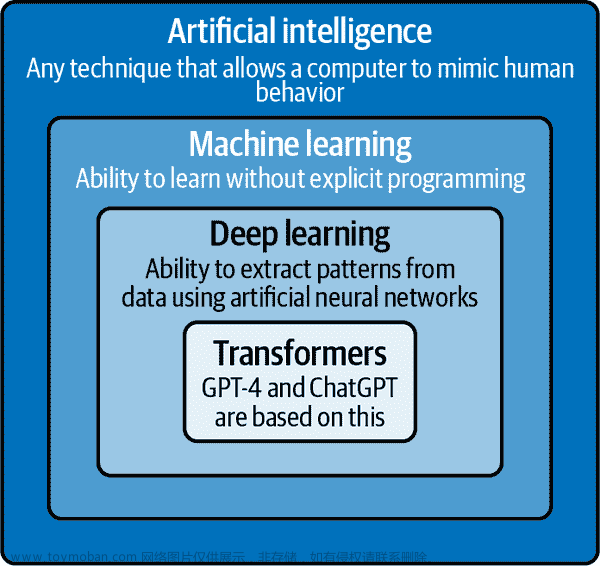

接着上一小节,我们对Huggingface开源代码库中的Bert模型进行了深入学习,这一节我们对如何应用BERT进行详细的讲解。

涉及到的jupyter可以在代码库:篇章3-编写一个Transformer模型:BERT,下载

本文基于 Transformers 版本 4.4.2(2021 年 3 月 19 日发布)项目中,pytorch 版的 BERT 相关代码,从代码结构、具体实现与原理,以及使用的角度进行分析,包含以下内容:文章来源:https://www.toymoban.com/news/detail-508715.html

- BERT-based Models应用模型

- BERT训练和优化

- Bert解决NLP任务

- BertForSequenceClassification

- BertForMultiChoice

- BertForTokenClassification

- BertForQuestionAnswering

- BERT训练与优化

- Pre-Training

- Fine-Tuning

- AdamW

- Warmup

3-BERT-based Models

基于 BERT 的模型都写在/models/bert/modeling_be文章来源地址https://www.toymoban.com/news/detail-508715.html

到了这里,关于[算法前沿]--027-如何应用一个BERT?的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![【深度学习应用】基于Bert模型的中文语义相似度匹配算法[离线模式]](https://imgs.yssmx.com/Uploads/2024/02/794034-1.png)

![【 [mmdetection] 如何在训练中断后,接着上次训练?】](https://imgs.yssmx.com/Uploads/2024/02/484966-1.png)