逆映射与向量空间

一、逆映射

矩阵的本质是映射。对于一个 m × n m × n m×n的矩阵,乘法 y = A x y = Ax y=Ax的作用就是将向量从 n n n维原空间中的 x x x坐标位置,映射到 m m m维目标空间的 y y y坐标位置,这是正向映射的过程。那么,如果已知结果向量的坐标 y y y去反推原向量的坐标 x x x,这个过程就称之为逆映射,因为逆映射也是一种映射过程,因此表征逆映射的矩阵,我们称之为: A − 1 A^{-1} A−1。

从上面的表述可以清楚的看到,原矩阵与逆矩阵的关系是双射。这也是存在逆的充要条件

1. 矮胖矩阵映射不可逆

映射压缩了原来的向量空间,使得其不满足单射的条件:原空间对目标空间存在多对一的情况

2. 高瘦矩阵映射不可逆

目标向量空间无法被原空间向量完全覆盖,不满足满射条件:目标空间对原空间存在多对一的情况

3. 方阵逆映射的存在条件

当方阵中列向量线性相关时,结合了矮胖和高瘦矩阵的所有条件,一定不存在逆映射

当方阵中列向量线性相关时,存在逆映射,为什么呢?后面会有解释。

二、向量空间及其子空间

1. 向量空间

1) 最常见的向量空间: R n R^n Rn

R n R^n Rn空间由所有含有 n n n个成分的列向量构成。

2) 向量空间的一般性定义

向量空间不仅仅局限于 R n R^n Rn,当然我们这里只讨论狭义上的向量空间(不讨论广义的例如矩阵、函数空间等或者扩展到复数域上),那么针对一个向量集合 V V V,如果任取V中的两个向量 u u u和 v v v,只要满足 u + v u+v u+v仍然存在于 V V V中,同时任取标量 c c c,只要满足 c u cu cu仍然在 V V V中,那么这个集合 V V V就构成一个向量空间.

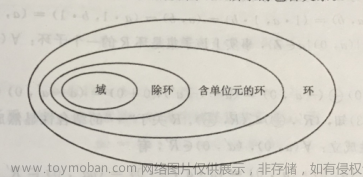

2. 子空间

用子集与集合的关系来类比子空间和向量空间的关系。如果一个向量空间 U U U,他的子集 V V V也是一个向量空间(满足向量加法和标量乘法的性质要求),那么 V V V是 U U U的子空间。

m × n m \times n m×n的矩阵 A A A,矩阵中所蕴含的四个非常重要的子空间:列空间、零空间、行空间和左零空间。

1) 列空间

对于矩阵 A A A而言,它包含了 n n n个 m m m维的列向量,那么 A A A的列空间就包含所有这 n n n个 m m m维列向量的线性组合。由于各列都在 R m R^m Rm空间中,并且列空间中任意两个向量的和以及任意向量与任意标量的数量积依然都可以表示为列向量的线性组合的形式,意味着矩阵A的列空间 C ( A ) C(A) C(A)是一个向量空间,并且是 R m R^m Rm空间的子空间。

2) 零空间

对于一个

m

×

n

m × n

m×n的矩阵

A

A

A而言,所有满足

A

x

=

0

Ax=0

Ax=0的向量

x

x

x的集合就称之为矩阵

A

A

A的零空间,记作

N

(

A

)

N(A)

N(A),如果矩阵

A

A

A的各列线性无关,则

x

x

x就只有零向量这个唯一解,如果

A

A

A的各列线性相关,那么

x

x

x就有非零解。

零空间也是一个向量空间,对于一个

m

×

n

m \times n

m×n的矩阵而言,他的零空间里的向量是

n

n

n维的,因此零空间是

R

n

R^n

Rn的子空间。

3) 行空间

对于 m × n m × n m×n的矩阵 A A A,他的行空间就是由矩阵各行的向量所张成的空间,那么我们换个角度来看 A A A的行向量就是转置后 A n A^n An的列向量。因此我们不难发现,矩阵 A A A的行空间就是转置后 A T A^T AT的列空间,记作: C ( A T ) C(A^T) C(AT), A A A的行向量有 n n n个成分,因此行空间是 R n R^n Rn的子空间,至于说向量空间成立的证明就不再叙说了。

4) 左零空间

仍旧从转置矩阵的角度切入去理解,就会比较容易。对于

m

×

n

m × n

m×n的矩阵

A

A

A,他的左零空间就是转置矩阵

A

T

A^T

AT的零空间,即满足:

A

T

x

=

0

A^Tx =0

ATx=0的所有向量的集合,我们将其记作

N

(

A

T

)

N(A^T)

N(AT)。

左零空间的相关性质也不难得到,他是

R

m

R^m

Rm空间的子空间。

现在可以解答上面为何只有方阵中列向量线性相关时,存在逆映射了。

如果一个矩阵 A A A存在着逆映射,则意味着其映射后的点是要能被唯一还原的,因此显然零空间 N ( A ) N(A) N(A)对应的不能是一维直线、二维平面,而只能是一个点,也就是原始空间中的 0 0 0向量,即如果一个矩阵可逆,他的 N ( A ) N(A) N(A)必须是 0 0 0维的。

如果 A A A的零空间不是零维,则在列空间存在不止一组线性组合得零向量,也就是在原空间中存在不止一个向量被映射成零向量,不符合一对一的关系。

3. 秩

矩阵列向量或行向量的张成空间维数,矩阵线性无关的列的个数。

1) 列空间与零空间的关联

矩阵

A

A

A的列空间

C

(

A

)

C(A)

C(A)的维度就是矩阵

A

A

A的秩

r

r

r。

零空间,从几何意义上讲,零空间就是原空间中通过矩阵

A

A

A映射到目标空间原点的向量空间,这个原点依据定义也必须在列空间中。在这个

m

×

n

m × n

m×n的矩阵映射作用下,整个零空间的维度

x

x

x被压缩成了

0

0

0(即一个点的维度),那么我们可以引申出,原空间中的

x

x

x维区域变成了列空间中的一个

0

0

0维点,因此经过矩阵的线性映射,前后的空间维数之差也为

x

x

x,因为由

A

A

A进行变换的原空间是

n

n

n维的,而映射后的列空间是

r

r

r维的,两个空间的维数之差

n

−

r

n -r

n−r就是空间压缩的维数,依据我们所讲,

n

−

r

n - r

n−r也就是零空间

N

(

A

)

N(A)

N(A)的维数。

2) 列空间与行空间的关联

在一个矩阵中,我不难发现,线性无关的行向量的个数其实是和线性无关的列向量的个数是相等的。

因此,我们可以得出结论: 行空间 C ( A T ) C(A^T) C(AT)的维数也是矩阵的 r r r。文章来源:https://www.toymoban.com/news/detail-509012.html

3) 行空间和左零空间

由上面两个关联的陈述,可知, C ( A T C(A^T C(AT)的维度是 r r r,而矩阵 A T A^T AT对应的映射前的原空间是 m m m,那么左零空间 N ( A T ) N(A^T) N(AT)的维度就是 m − r m - r m−r。文章来源地址https://www.toymoban.com/news/detail-509012.html

到了这里,关于机器学习-线性代数-2-逆映射与向量空间的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!