引用自GPT

逻辑回归(Logistic Regression)和 softmax 回归(Softmax Regression)是两种用于分类问题的常见机器学习算法,它们在某些方面有所不同。

1.目标函数形式:

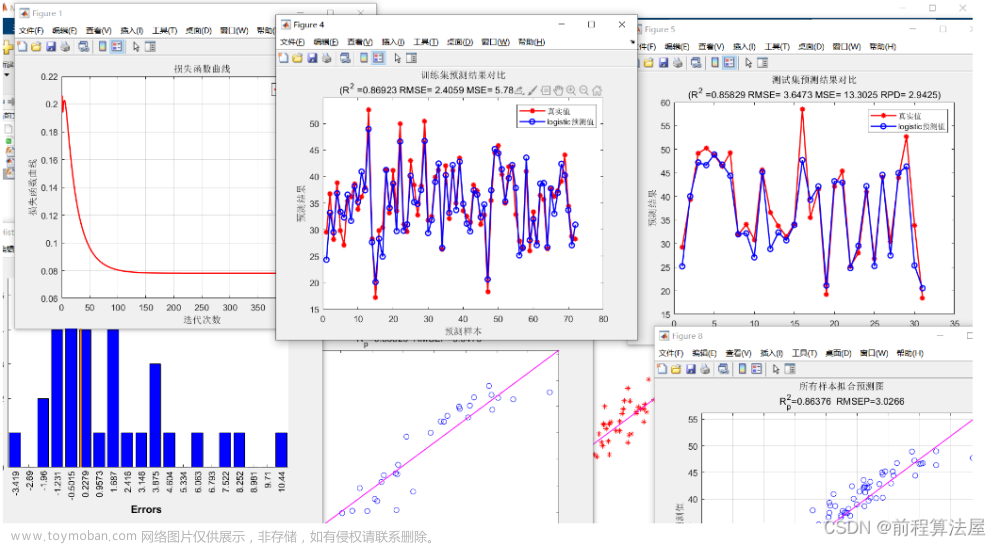

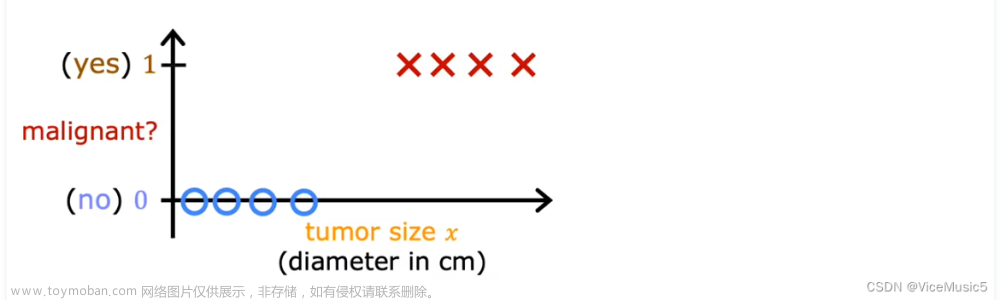

逻辑回归:逻辑回归用于二分类问题,其目标是学习一个逻辑回归函数,该函数通过将输入映射到一个概率值(0到1之间)来预测样本属于某个类别的概率。

Softmax 回归:Softmax 回归用于多类别分类问题,其目标是学习一个 Softmax 函数,该函数将输入映射到每个类别的概率分布,用于预测样本属于多个类别中的哪一个。

2.输出形式:

逻辑回归:逻辑回归的输出是一个概率值,通常用于二分类问题,可以将输出阈值设置为0.5,将大于阈值的样本归为正类,小于阈值的样本归为负类。

Softmax 回归:Softmax 回归的输出是每个类别的概率分布,用于多类别分类问题。输出中的每个类别的概率值都在0到1之间,并且所有类别的概率之和为1。

3.模型参数:

逻辑回归:逻辑回归模型通常使用逻辑函数(如 Sigmoid 函数)来建模,参数是每个特征的权重。

Softmax 回归:Softmax 回归模型使用 Softmax 函数来建模,参数是每个类别的权重向量。

1.损失函数:

逻辑回归:逻辑回归使用对数损失函数(或称为二元交叉熵损失函数)来最小化预测值和真实标签之间的差异。

Softmax 回归:Softmax 回归使用交叉熵损失函数来最小化预测概率分布与真实标签之间的差异。

总的来说,逻辑回归和 softmax 回归是两种常见的分类算法,逻辑回归用于二分类问题,而 softmax 回归用于多类别分类问题。它们的目标函数、输出形式、模型参数和损失函数都有所不同,适用于不同的分类任务。

引用自chatglm

Logistic regression 和 Softmax regression 都是用于分类问题的回归模型,但它们之间有一些区别。文章来源:https://www.toymoban.com/news/detail-513831.html

输出变量类型不同:Logistic regression 输出的是概率值,即某个样本属于某个类别的概率;而 Softmax regression 输出的是样本属于各个类别的概率分布。

应用场景不同:Logistic regression 通常用于二分类问题,即只有两个类别;而 Softmax regression 通常用于多分类问题,即有多个类别。

模型形式不同:Logistic regression 的模型形式是线性的,即自变量与因变量之间的关系是线性的;而 Softmax regression 的模型形式是非线性的,即自变量与因变量之间的关系是非线性的。

参数估计方法不同:Logistic regression 通常使用最大似然估计方法来估计模型参数;而 Softmax regression 通常使用梯度下降法来估计模型参数。文章来源地址https://www.toymoban.com/news/detail-513831.html

到了这里,关于logistic and softmax regression的区别的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!