智能时代:向量和模型构成一切(Vector and models rule it all) ——朱嘉明

从老式电视机上的雪花引出diffusion

Diffusion模型尝试使用一种更加简单的方法生成图像。大家是否记得老式电视机信号不好时屏幕上闪烁的雪花?

这些雪花是随机、无序、混乱的,因而被称为噪声。当电视机信号不好的时候,屏幕上就会出现这些噪声点,信号越差就会出现越多的噪声点,直到最后屏幕完全被随机的噪声覆盖,那么换一个角度去思考,既然任何一张图像都可以在不断添加噪声后,变成一张完全随机的噪声图像,那我们能不能将这个过程翻转,让神经网络学习这个噪声扩散的过程之后逆向扩散,把随机生成的噪声图像,逐渐转化为清晰的生成图像,diffusion模型就是基于这个思想实现的。

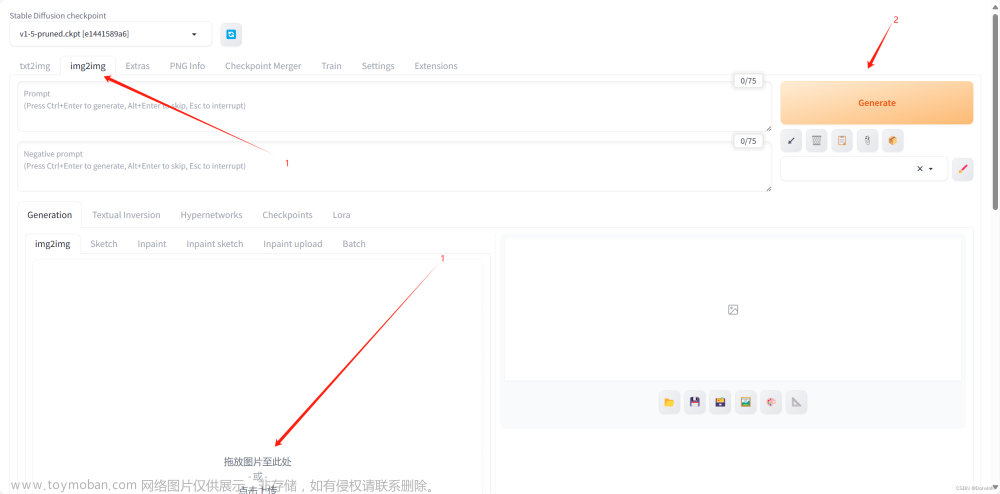

Stable Diffusion 的组成

Stable Diffusion 并不是一个单一模型,而是由多个部分和模型一起构成的系统。

首先将文本输入到编码器中得到特征列表,之后将文本特征作为图像生成器的输入,图像生成器又分为图像信息创建和图像解码

图像信息创建器由 UNet 神经网络和调度算法组成,Stable Diffusion 接口(interfaces)和库(libraries)的 step 参数一般默认为 50 或 100。

图像解码器是Autoencoder Decoder,主要根据图像信息创建器的信息绘制图像,它只用在过程结束时运行一次,以生成最终的像素图像。

为什么从文本到图像的思路这么好用?

对于人类来说,在婴儿时期学习图片并不是具体地学习一个个像素,而是父母指着图片告诉孩子:“这是一只在吃猫粮的黑色小猫”,或者“这是一辆在马路上飞驰的红色汽车”。于是,研究者开始思考,AI的学习过程是否也能采用这种类似的方式?这本质上是一个文本和图像匹配的问题,为此,OpenAI在互联网上收集到了4亿对质量过关的图像文本对,分别将文本和图像进行编码,让clip模型学会计算文本和图像的关联程度,在此基础上,结合diffusion模型对图像的生成能力,就可以打造一款AI绘画应用了。

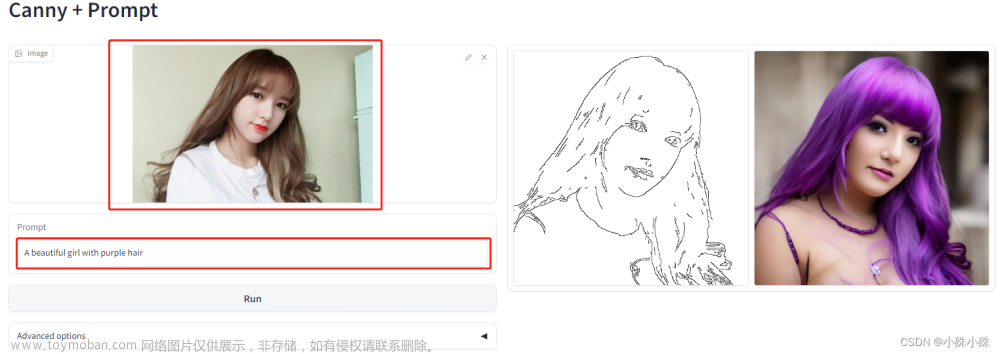

知名AI绘画工具

许多公司在CLIP模型和Diffusion模型的基础上开发了模型变体的相关应用工具,其中,stable diffusion是最知名的工具之一,stable diffusion对于生成当代艺术图像具有较强的理解力,善于刻画图像的细节,但为了还原这些细节,它在图像描述上需要进行非常复杂细致的说明,比较适合生成涉及较多创意细节的复杂图像,在创作普通图像时可能会略显乏力。文章来源:https://www.toymoban.com/news/detail-514577.html

文本编码器的重要基建:Transformer语言模型

Transformer 语言模型作为语言理解组件,能够接受文本提示词,生成 token embeddings。 文章来源地址https://www.toymoban.com/news/detail-514577.html

文章来源地址https://www.toymoban.com/news/detail-514577.html

Stable Diffusion资源列表

- Hugging Face

Hugging Face是一个专注于构建、训练和部署先进开源机器学习模型的网站。

HuggingFace是Stable Diffusion模型创作的首选平台,目前平台上有270多个与Stable Diffusion相关的模型,用"Stable Diffusion"作为关键字就能搜到。 - Civitai

Civitai是一个专为Stable Diffusion AI艺术模型设计的网站。该平台目前有来自250+创作者上传的1700个模型。这是迄今为止我所知的最大的AI模型库。你可以在上面分享自己的模型或生成作品。 - Discord

在Stable Diffusion的Discord页面中有一个名为“Models-Embeddings”的专属频道,里面提供了很多可以免费下载的各种模型。 - Rentry for SD

Rentry网站上有一个保存Stable Diffusion模型的页面sdmodels,上面由70多个模型可以免费下载。

到了这里,关于超有趣的stable diffusion干货解读的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!