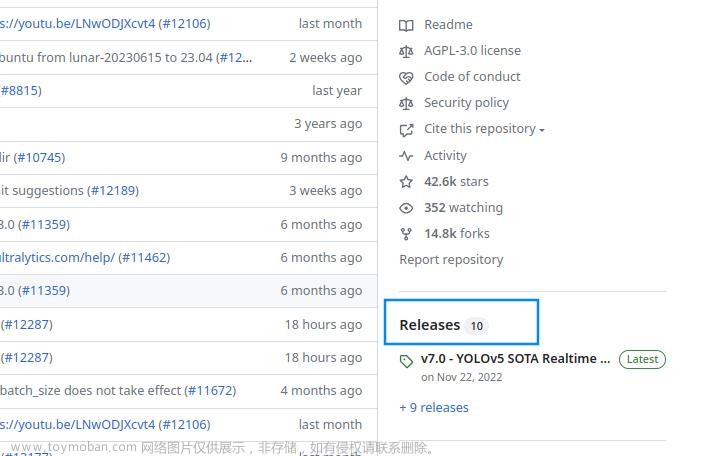

在训练好的yolov5 pt 模型 可以 通过 export.py 进行导出 onnx

导出流程

在 export.py 设置模型和数据源的yaml

在官方的文档中 说明了可以导出的具体的类型。

在 --include 添加导出的类型, 不同的 类型的 环境要求不一样,建议虚拟环境,比如onnx 和 openvino 的numpy 版本要求不一只,一个要求高配,一个要求低配

python export.py --include torchscript onnx

如何测试和验证推理

python detect.py --weights yolov5s.onnx --dnn # detect

python val.py --weights yolov5s.onnx --dnn # validate

在模型导出的中文章来源:https://www.toymoban.com/news/detail-515448.html

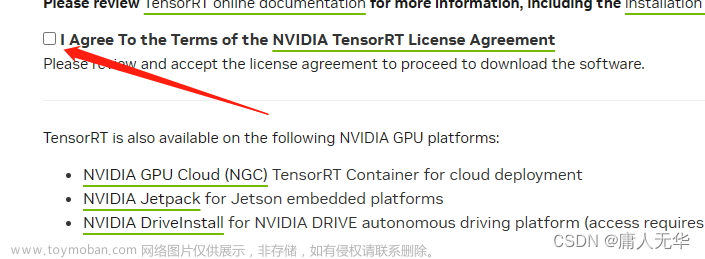

onnx 和 openvino 不需要GPU进行推理,但是tensorRT 需要 GPU 进行推理文章来源地址https://www.toymoban.com/news/detail-515448.html

到了这里,关于yolov5 pt 模型 导出 onnx的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!