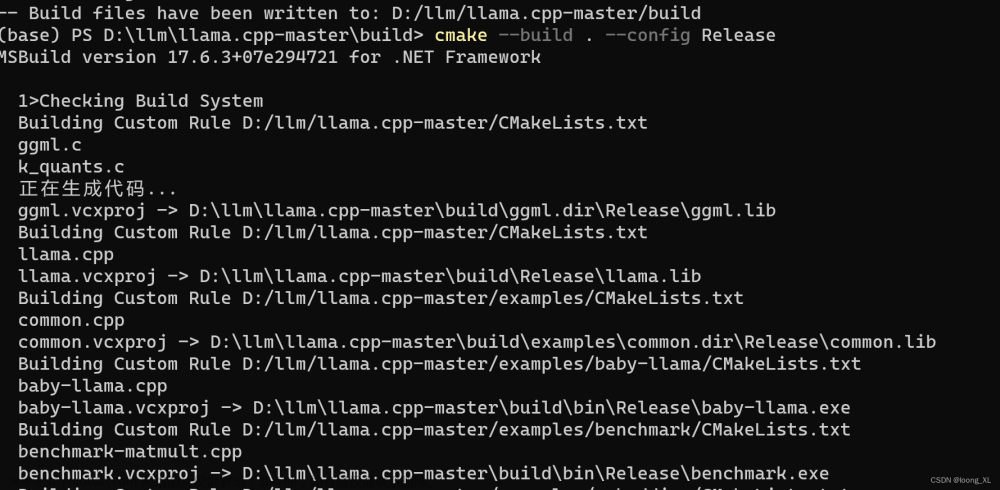

下图展示了我们的训练的整个流程和数据集构造。整个训练过程分为两个阶段:

(1)全量预训练阶段。该阶段的目的是增强模型的中文能力和知识储备。

(2)使用LoRA的指令微调阶段。该阶段让模型能够理解人类的指令并输出合适的内容。

3.1 预训练数据集构建

为了在保留原来的代码能力和英语能力的前提下,来提升模型对于中文的理解能力,我们并没有对词表进行扩增,而是搜集了中文语料、英文语料和代码语料。其中中文语料来自于百度百科、悟道和中文维基百科;英文数据集是从LLaMA原始的英文语料中进行采样,不同的是维基数据,原始论文中的英文维基数据的最新时间点是2022年8月,我们额外爬取了2022年9月到2023年2月,总共六个月的数据;而代码数据集,由于Pile数据集中的代码质量不高,我们去爬取了Github、Leetcode的代码数据,一部分用于预训练,另外一部分用于指令微调。

对上面爬取到的数据集,我们使用了启发式的方法,剔除了数据集中有害的内容,此外,我们还剔除了重复的数据。文章来源:https://www.toymoban.com/news/detail-525424.html

3.2 预训练训练过程

详细的数据处理代码和训练代码、完整的训练脚本、详细的训练情况可以在文章来源地址https://www.toymoban.com/news/detail-525424.html

到了这里,关于LLM-LLaMA中文衍生模型:LLaMA-ZhiXi【没有对词表进行扩增、全参数预训练、部分参数预训练、指令微调】的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[NLP]LLM---FineTune自己的Llama2模型](https://imgs.yssmx.com/Uploads/2024/02/708124-1.png)