(零)前言

本篇主要从复刻一幅作品(无论是网上或者自己已生产的图)出发,再讲讲模型和参数。我不明白的是AI可以画浩瀚宇宙、星辰大海,山川异域,城市建筑,各种艺术风格,可以说包罗万象……但实际互联网上只能看到各种小姐姐-_-

更多不断丰富的内容参考:🔗《继续Stable-Diffusion WEBUI方方面面研究(内容索引)》

(一)复刻优秀的作品

AI绘图的随机性很高,经常我们需要不停的调整关键词和参数。然后每次都让显卡辛勤工作很久,出一堆图,才能从中找到自己满意的那一张(这时候相关参数会记录到图片文件中)。

同理,在网上看到别人优秀的作品,有时也想自己画张一样的或类似的。

比如这些网站:

- 启动器推荐的 🔗AIGodLike社区。

- 小日子过得不错的另类🔗🇯🇵寻找图像提示🔞NSFW。

- 人人都可以是艺术家的🔗艺术广场。

这些网站放出的AI生成内容,都带有很详细的生成条件。

如果你发现只有图片本身,需要看看参数等生成条件是不是在图片信息里面。

下面这副是AIGodLike社区评价很高的作品(小日子那个不便展示),页面上就有生成条件:

因为我们需要关于这张图片如下的生成条件,才能复刻它:

- 模型(基础 + 如果有LoRA)

- 提示词(正面+反向)

- 参数(包括随机种子)

(1.1)模型

首先要找到生成这张图的基础模型(Stable-Diffusion模型)。

如果这张图使用了LoRA模型,我们也要找到对应的LoRA模型。

如果有多个版本,最好是找同一个版本。

模型怎么找?

因为国内访问不了https://civitai.com所以目前常规方法只能在🔗抱脸上搜索。

这个网站上有些用户,喜欢收集一大堆模型。

比如这两位:🔗jomcs(jo),🔗2ch(dvach),收集的模型真的太多太多了。

我们也可以通过国内网站,比如🔗https://openai.wiki/painting/sd,

各位Bilibili博主的分享等等来找模型。

(1.1.1)Model Hash

特别需要注意的是,模型可能会被改名,即使同名都不见得真的是同一个模型。

所以要保证是 同一个模型 只能是模型的哈希值相同。(WEBUI中会显示Hash值)

类似下图,同名的模型但Hash不同,只能算不同的(类似的)模型。

造成这个问题可能这两个同名模型是不同的人训练的(不同的训练步骤,等等)。

因为模型都是用户的,没有所谓官方的。

(1.2)提示词

提示词比较简单,就是一堆英文词句。有正向和反向,分别拷贝下来就可以了。

但也需要注意两点,首先是提示词中是否包含LoRA模型(尖括号),类似<lora:xxxxxx_v10:0.8>。

如果有那么就必须找到xxxxxx_v10这个LoRA模型才能复刻。

第二点就是反向提示词里面,有没有反推提示词(这玩意儿不是个单词而是个模型啊啊啊)……

(1.2.1)反推提示词

举个例子,EasyNegative,它出现在反向提示词当中,但它其实是个嵌入式模型。

这种用法主要是为了简化反向提示词,不用写一大堆文字了。

还有更多的反推提示词,最好把常见的反推提示词的模型都下载下来(在这里有一些)。

缺少反推提示词对应的模型,会造成实际反向提示词和原画不一致(虽然文字内容是一致的)。

(1.3)参数

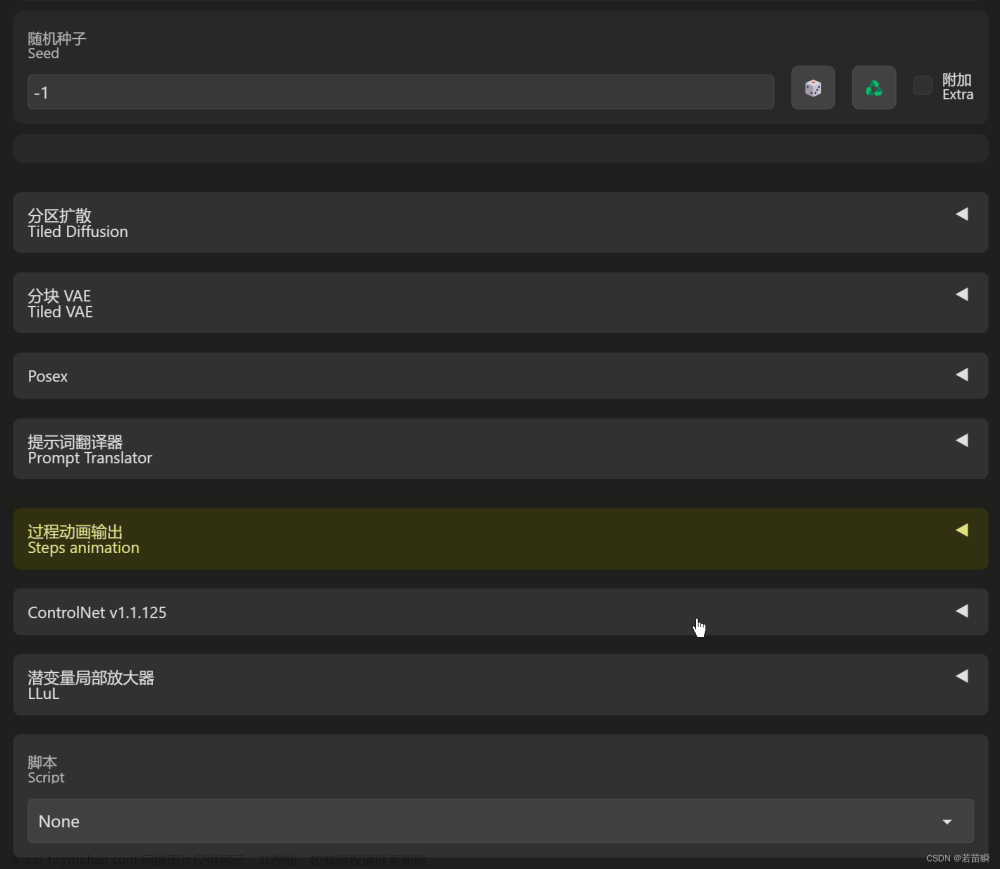

参数包括的内容很多,采样方法,迭代步数,长宽尺寸……

是否面部修复,高清修复,提示词相关性,以及想要几乎一模一样就必须有的随机种子。

还包括附加的一些插件,比如ControlNet的各种设置。

也就是说,所有的参数值,勾选,插件等等都要。

(二)无法真正复刻

所以没有或缺少生成条件的作品是无法复刻的。

就算所有的模型,提示词,参数都完全一致。

最后生成的图片也只能和原图几乎一模一样,没有办法真的完全复刻。

经过2次处理(比如重绘手部)的作品也几乎无法保存它的参数(除非人工保存)。

加上有时候我们都会会弄丢参数……

所以佛系点比较好,何必复刻,再画几百次,也许有更加满意的呢? 😄文章来源:https://www.toymoban.com/news/detail-532187.html

这部分……大家都是知道的吧。

🤪 to be continued…文章来源地址https://www.toymoban.com/news/detail-532187.html

到了这里,关于通过【Stable-Diffusion WEBUI】复刻属于你的女神:再谈模型与参数的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!