引言

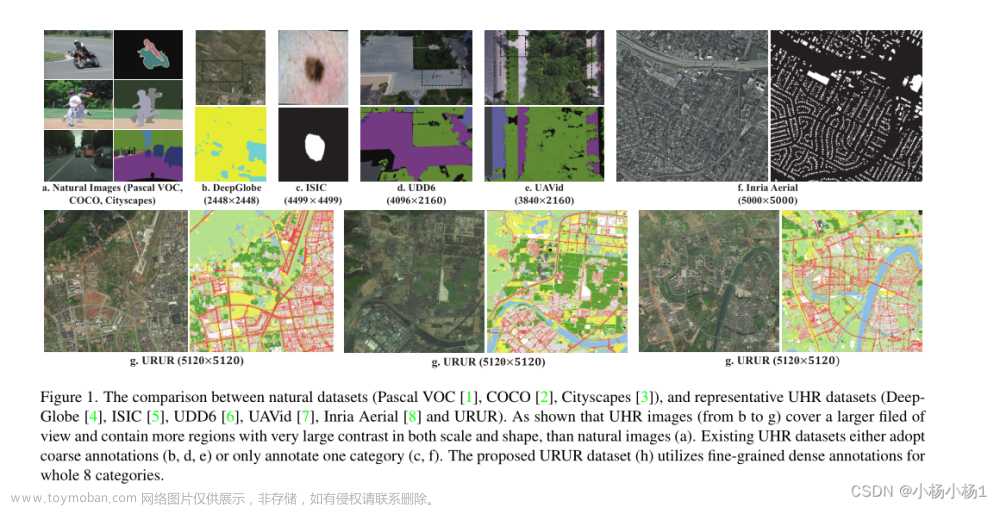

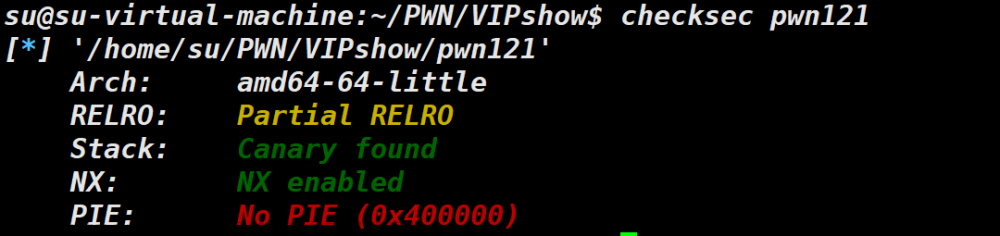

如图1所示,视觉模式在自然场景中以多尺度出现。首先,对象可以在单个图像中以不同的尺寸出现,例如,沙发和杯子具有不同的尺寸。其次,对象的基本上下文信息可能比对象本身占据更大的区域。例如,我们需要依靠大桌子作为上下文,以更好地判断放置在桌子上的黑色小球是杯子还是笔筒。第三,感知来自不同尺度的信息对于理解诸如细粒度分类和语义分割之类的任务的部分和对象至关重要。因此,为视觉认知任务设计多尺度的良好特征至关重要,包括图像分类 [444] 、物体检测 [53] 、注意力预测 [55] 、目标跟踪 [76] 、动作识别 [56] 、语义分割 [6] 、显著物体检测 [2],[29],物体提议 [12],[53],骨架提取 [80],立体匹配 [52] 和边缘检测 [45],[69]。

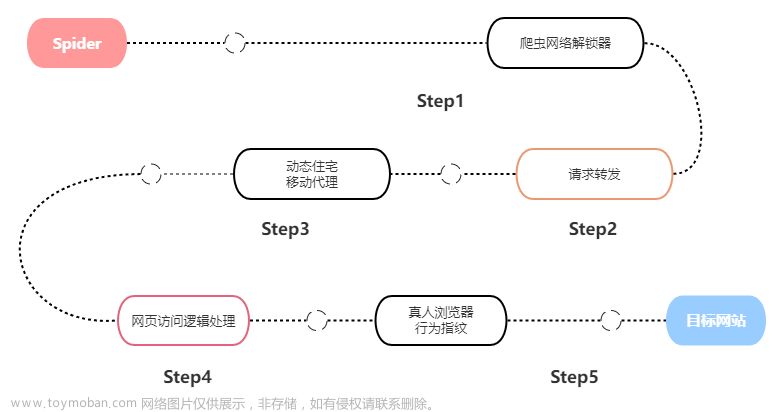

多尺度特征已广泛用于常规特征设计 [1],[48] 和深度学习 [10],[61]。在视觉任务中获得多尺度表示需要特征提取器使用大范围的感受域来描述不同尺度的对象/部分/上下文。卷积神经网络 (CNNs) 通过一堆卷积算子自然地学习从粗到细的多尺度特征。CNNs固有的多尺度特征提取能力导致解决众多视觉任务的有效表示。如何设计更高效的网络架构是进一步提高CNNs性能的关键。文章来源:https://www.toymoban.com/news/detail-536696.html

在过去的几年中,几个骨干网,例如,[10],[15],[27],[30],[31]&#x文章来源地址https://www.toymoban.com/news/detail-536696.html

到了这里,关于Res2Net: 一种新的多尺度主干体系结构(Res2Net: A New Multi-scale Backbone Architecture )的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!