Python爬虫——Urllib

- 爬虫小白

- 爬虫语法

- 爬虫技术

Urllib

1、什么是互联网爬虫

- 通过一个程序,根据url进行爬取网页,获取游泳信息

- 通过程序模拟浏览器,去向服务器发起请求,获取响应信息

2、爬虫核心

- 爬取网页:爬取整个网页,包含了网页中所有内容

- 解析数据:将网页中得到的数据进行解析

- 难点:爬虫和反爬虫之间的博弈

3、爬虫用途

- 数据分析/人工数据集

- 社交软件冷启动

- 舆情监控

- 竞争对手监控

4、爬虫分类

4.1 通用爬虫

- 实例

- 百度、360、google、sougo等搜索引擎

- 功能

- 访问网页->抓取数据

**注意:**通用爬虫不是我们关注的重点。

4.2 聚焦爬虫

- 功能

- 根据需求,实现爬虫程序,抓取需要的数据

- 设计思路

- 确定要爬取的url

- 如何获取url

- 模拟浏览器通过http协议访问url,获取服务器返回的html代码

- 如何访问

- 解析html字符串(根据一定规则提取需要的数据)

- 如何解析

- 确定要爬取的url

5、反爬手段

5.1 User-Agent

User-Agent中文名为用户代理,简称UA,它是一个特殊字符串头,使得服务器能够识别客户使用的操作系统及版本、CPU类型、浏览器及版本、浏览器渲染引擎、浏览器语言、浏览器插件等。

5.2 代理IP

- 什么是高匿名、匿名和透明代理?

- 使用透明代理:对方服务器可以知道你使用了代理,并且也知道你的真实IP

- 使用匿名代理:对方服务器可以知道你使用了代理,但不知道你的真实IP

- 使用高匿名代理:对方服务器不知道你使用了代理,更不知道你的真实IP

5.3 验证码访问

- 打码平台

- 云打码平台

5.4 动态加载网页,网站返回的是js数据,并不是网页的真实数据

- selenium驱动真实的浏览器发送请求

5.4 数据加密

- 分析js代码

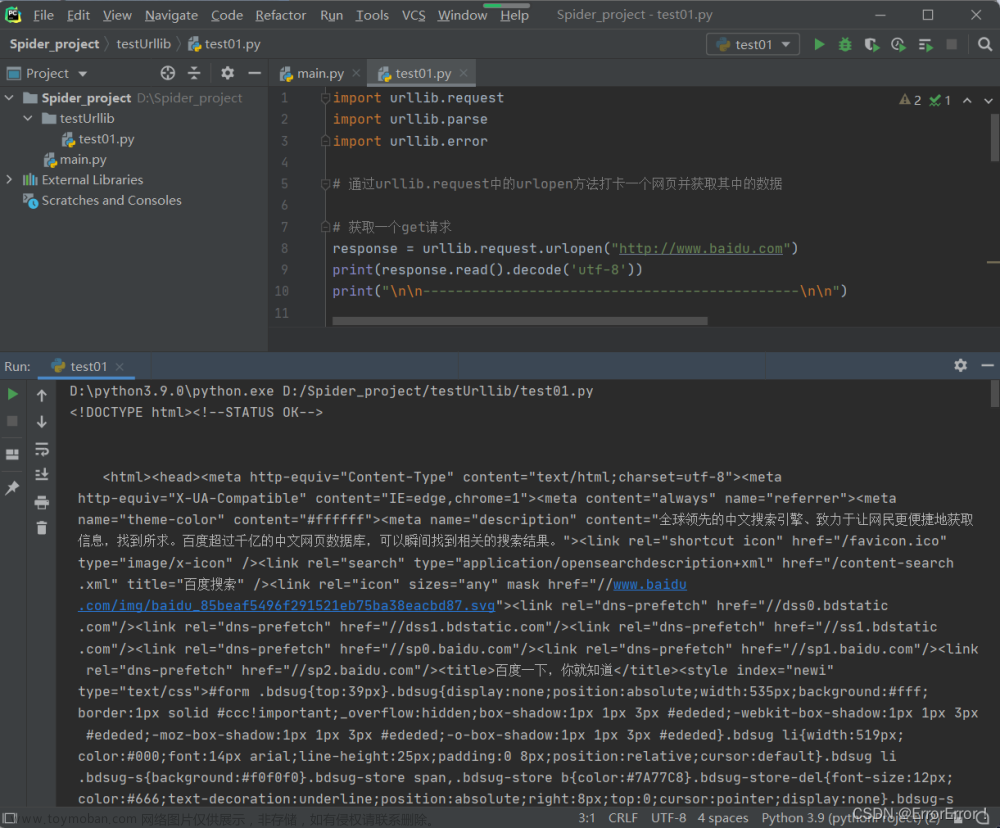

6、urllib库使用

6.1 urllib基本使用

# -*- coding: utf-8 -*-

# @Time: 2022/9/24 0024 9:47

# @Author: Wang

# @File: 01_urllib_基本使用.py

# 使用urllib来获取百度首页的源码

import urllib.request

# (1)定义一个url,就是你要访问的地址

url = 'http://www.baidu.com'

# (2)模拟浏览器向服务器发送请求

response = urllib.request.urlopen(url=url)

# (3)获取响应的页面源码

# read方法:返回的是字节形式的二进制数据

# 我们要将二进制的数据转换为字符串

# 二进制->字符串的动作:解码 decode('编码的格式‘)

content = response.read().decode('utf-8')

# (4)打印数据

print(content)

6.2 urllib的1个类型6个方法

# -*- coding: utf-8 -*-

# @Time: 2022/9/24 0024 10:02

# @Author: Wang

# @File: 02_urllib_1个类型和6个方法.py

import urllib.request

url = 'http://www.baidu.com'

# 模拟浏览器向服务器发送请求

response = urllib.request.urlopen(url)

# 1个类型和6个方法

# response是HTTPResponse的类型

# print(type(response))

# 按照一个字节一个字节的去读

# content = response.read()

# print(content)

# 返回多少个字节

# content = response.read(5)

# print(content)

# 读取一行

# content = response.readline()

# print(content)

# 读取所有行

# content = response.readlines()

# print(content)

# 状态码

print(response.getcode()) # 200

# 请求url

print(response.geturl()) # http://www.baidu.com

# 状态信息

print(response.getheaders())

# 1个类型是HTTPResponse

# 6个方法 read readline readlines getcode geturl getheaders

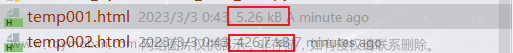

6.3 urllib下载

下载网页

import urllib.request

# 下载网页

url_page = 'http://www.baidu.com'

# url代表的是下载的路径 filename文件名

# 在python中,可以写变量的名字,也可以直接写值

urllib.request.urlretrieve(url_page, 'baidu.html')

下载图片

# 下载图片

url_img = 'https://img2.baidu.com/it/u=1390544076,2637920000&fm=253&fmt=auto&app=138&f=JPEG?w=500&h=625'

urllib.request.urlretrieve(url_img, 'lisa.jpg')

下载视频

# 下载视频

url_vidio = 'https://vd2.bdstatic.com/mda-jmki3yf92d7w4ft9/v1-cae/sc/mda-jmki3yf92d7w4ft9.mp4?v_from_s=hkapp-haokan-hbf&auth_key=1664077962-0-0-93246b00edbdd7bda4482e4bbd5bc4d1&bcevod_channel=searchbox_feed&pd=1&cd=0&pt=3&logid=1362660174&vid=5104542693201134340&abtest=&klogid=1362660174'

urllib.request.urlretrieve(url_vidio, 'lisa.mp4')

7、请求对象的定制

UA反爬

# -*- coding: utf-8 -*-

# @Time: 2022/9/25 0025 11:32

# @Author: Wang

# @File: 04_urllib_请求对象的控制.py

import urllib.request

url = 'https://www.baidu.com'

headers = {

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/105.0.0.0 Safari/537.36'

}

# 因为urlopen方法中不能存储字典 所以headers不能传递出去

# url的组成

# http/https www.baidu.com 80/443 s wd=周杰伦

# 协议 主机 端口号 路径 参数

# http 80

# https 443

# mysql 3306

# 因为参数顺序的问题 不能直接写url 和 headers

request = urllib.request.Request(url=url, headers=headers)

response = urllib.request.urlopen(request)

content = response.read().decode('utf-8')

print(content)

8、编解码

urllib.parse.quote(‘杜兰特’)

直接访问https://www.baidu.com/s?wd=杜兰特会报错,无法识别汉字,所以需要通过quote把汉字转换为能识别的编码

# -*- coding: utf-8 -*-

# @Time: 2022/9/25 0025 11:50

# @Author: Wang

# @File: 05_urllib_get请求的quote方法.py

import urllib.request

import urllib.parse

# url = 'https://www.baidu.com/s?wd=%E6%9D%9C%E5%85%B0%E7%89%B9'

# 获取https://www.baidu.com/s?wd=杜兰特的网页源码

url = 'https://www.baidu.com/s?wd='

# 请求对象的定制 是为了解决反爬的第一种手段

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/105.0.0.0 Safari/537.36'

}

# 将杜兰特三个字变成unicode编码的格式

# 我们需要依赖于urllib.parse

name = urllib.parse.quote('杜兰特')

print(name) # %E6%9D%9C%E5%85%B0%E7%89%B9

# 请求对象的定制

request = urllib.request.Request(url=url+name, headers=headers)

# 模拟浏览器向服务器发送请求

response = urllib.request.urlopen(request)

# 获取响应的内容

content = response.read().decode('utf-8')

print(content)

9、urlencode

# -*- coding: utf-8 -*-

# @Time: 2022/9/27 0027 10:48

# @Author: Wang

# @File: 06_urllib_get请求的urlencode.py

# https://www.baidu.com/s?wd=周杰伦&sex=男

import urllib.request

import urllib.parse

data = {

'wd': '周杰伦',

'sex': '男'

}

a = urllib.parse.urlencode(data)

print(a) # wd=%E5%91%A8%E6%9D%B0%E4%BC%A6&sex=%E7%94%B7

base_url = 'https://www.baidu.com/s?'

data = {

'wd': '周杰伦',

'sex': '男',

'location': '中国台湾省'

}

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/105.0.0.0 Safari/537.36'

}

new_data = urllib.parse.urlencode(data)

url = base_url + new_data

print(url) # https://www.baidu.com/s?wd=%E5%91%A8%E6%9D%B0%E4%BC%A6&sex=%E7%94%B7&location=%E4%B8%AD%E5%9B%BD%E5%8F%B0%E6%B9%BE%E7%9C%81

request = urllib.request.Request(url=url, headers=headers)

response = urllib.request.urlopen(request)

content = response.read().decode('utf-8')

print(content)

10、post请求百度翻译

-

注意:

-

post请求的参数,不会拼接在url的后面的,而是需要放在请求对象定制的参数中

-

post请求的参数 必须要进行编码

-

编码之后,必须调用encode()方法文章来源:https://www.toymoban.com/news/detail-546662.html

-

import urllib.request

import urllib.parse

url = 'https://fanyi.baidu.com/sug'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/105.0.0.0 Safari/537.36'

}

data = {

'kw': 'spider'

}

# post请求的参数 必须要进行编码

data = urllib.parse.urlencode(data).encode('utf-8')

print(data) # b'kw=spider'

# post请求的参数,不会拼接在url的后面的,而是需要放在请求对象定制的参数中

# post请求的参数 必须要进行编码

request = urllib.request.Request(url=url, data=data, headers=headers)

response = urllib.request.urlopen(request)

content = response.read().decode('utf-8')

print(content)

obj = json.loads(content)

print(obj)

打印结果:文章来源地址https://www.toymoban.com/news/detail-546662.html

{"errno":0,"data":[{"k":"spider","v":"n. \u8718\u86db; \u661f\u5f62\u8f6e\uff0c\u5341\u5b57\u53c9; \u5e26\u67c4\u4e09\u811a\u5e73\u5e95\u9505; \u4e09\u811a\u67b6"},{"k":"Spider","v":"[\u7535\u5f71]\u8718\u86db"},{"k":"SPIDER","v":"abbr. SEMATECH process induced damage effect revea"},{"k":"spiders","v":"n. \u8718\u86db( spider\u7684\u540d\u8bcd\u590d\u6570 )"},{"k":"spidery","v":"adj. \u50cf\u8718\u86db\u817f\u4e00\u822c\u7ec6\u957f\u7684; \u8c61\u8718\u86db\u7f51\u7684\uff0c\u5341\u5206\u7cbe\u81f4\u7684"}]}

{'errno': 0, 'data': [{'k': 'spider', 'v': 'n. 蜘蛛; 星形轮,十字叉; 带柄三脚平底锅; 三脚架'}, {'k': 'Spider', 'v': '[电影]蜘蛛'}, {'k': 'SPIDER', 'v': 'abbr. SEMATECH process induced damage effect revea'}, {'k': 'spiders', 'v': 'n. 蜘蛛( spider的名词复数 )'}, {'k': 'spidery', 'v': 'adj. 像蜘蛛腿一般细长的; 象蜘蛛网的,十分精致的'}]}

到了这里,关于Python爬虫——Urllib的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!