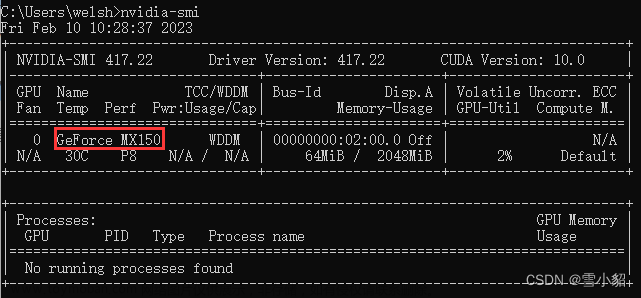

报错:找不到设备

输入

lspci|grep -i vga

发现显卡其实还在

用NVIDIA-Linux-x86_64-xxx.xxx.run重装了一下显卡驱动,发现还是不行

最后用了另一种安装方式

ubuntu-drivers devices

选择一个

比如选择了525,那就是

sudo apt-get install nvidia-driver-525

安装完了其实还是找不到设备,所以需要重启

然后就好了 文章来源:https://www.toymoban.com/news/detail-551568.html

文章来源:https://www.toymoban.com/news/detail-551568.html

参考

https://blog.csdn.net/dujianghai/article/details/125760522文章来源地址https://www.toymoban.com/news/detail-551568.html

到了这里,关于nvidia-smi no devices were found的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!