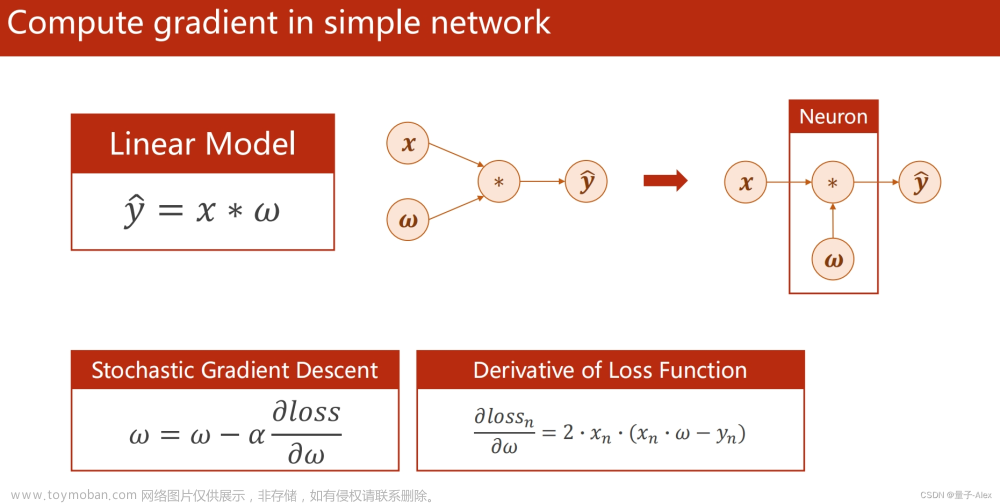

1. 导数

- 函数在某点的导数为该点处的斜率,用height / width表示,可以看作若当w增加ε,J(w,b)增加k倍的ε,则k为该点的导数

2. 反向传播

- tensorflow中的计算图,由有向边和节点组成。从左向右为正向传播,神经网络模型使用正向传播来输出结果

- 从右向左为反向传播,tensorflow使用反向传播来自动计算神经网络模型中的导数。

- 反向传播求导数的过程类似链式求导法则,从右往左一层一层的求导,再将导数相乘就是最终的结果。例如:先求当d增加ε时,J增加多少,再求当a增加ε时,J增加多少…,最后把J增加的倍数k乘起来,就是最终的结果

文章来源:https://www.toymoban.com/news/detail-563539.html

文章来源:https://www.toymoban.com/news/detail-563539.html

- 反向传播是计算导数的有效方法,若要计算J对w的导数,就要知道J对d,d对a,a对c,c对w的导数,这个顺序刚好是从右到左的顺序

- 反向传播求导数的步数大概是整个模型的节点数n与参数p之和。正向传播求导数的步数则是n与p之积

- 综上:计算图执行神经网络模型输出成本函数J和导数的步骤为:逐步计算,并把它们分解为计算图的不同节点,使用从左到右(正向传播)来计算成本函数J,通过从右到左(反向传播)来计算所有导数

3. 大型神经网络的计算图 文章来源地址https://www.toymoban.com/news/detail-563539.html

文章来源地址https://www.toymoban.com/news/detail-563539.html

- 计算图由有向边和节点组成,节点表示数学运算,有向边表示节点间的数据交互。

- 该神经网络模型求解成本函数的步骤可以用计算图表示

- 正向传播计算导数的效率很低,对于每一个参数都要执行一次从左往右的正向传播,来计算该参数是如何引起J的变化的。若计算图由n个节点和p个参数,那么正向传播一共需要大约n * p个步骤,效率很低。

- 反向传播计算导数的效率很高,只需要从右往左执行一次反向传播,再计算J对每一个参数的导数即可,那么反向传播只需要大约n + p个步骤,效率很高

到了这里,关于机器学习 day27(反向传播)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!