ajax: 就是一段js代码,通过这段代码,可以让页面发送异步的请求,或者向服务器发送一个东西,即和服务器进行交互

对于ajax:文章来源:https://www.toymoban.com/news/detail-566432.html

- 一定会有 url,请求方法(get, post),可能有数据

- 一般使用 json 格式

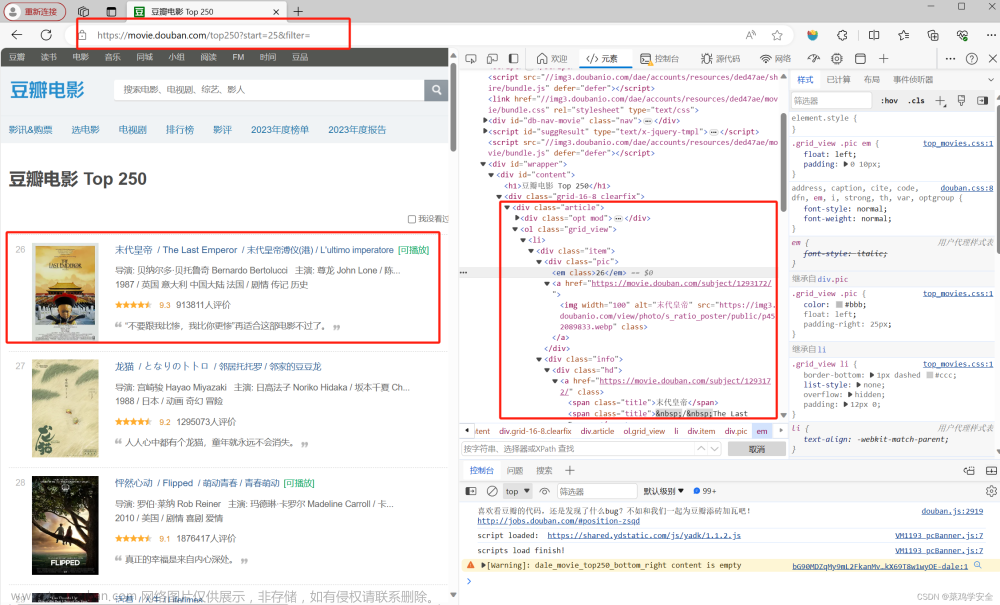

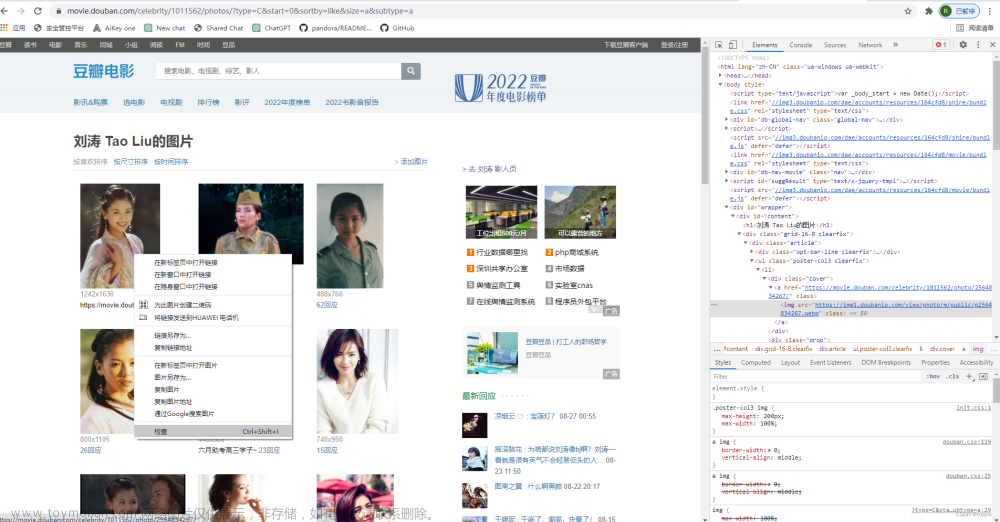

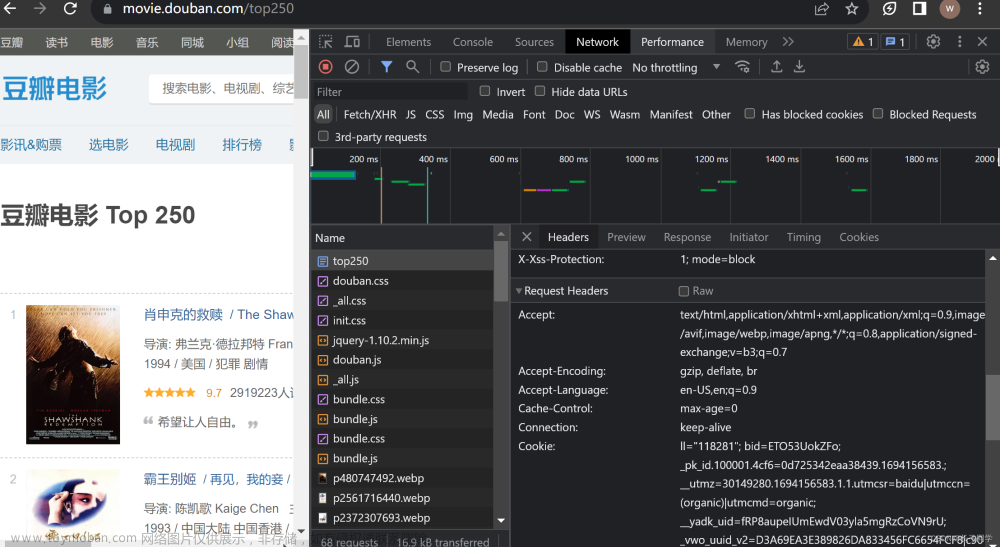

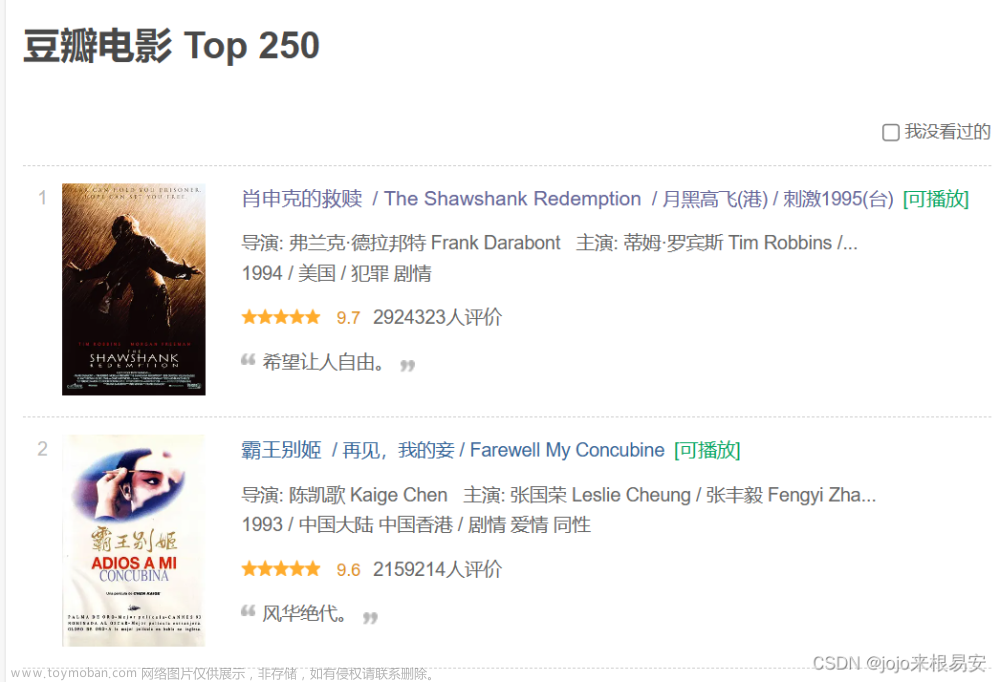

- 打开豆瓣电影,F12打开控制台(我这里是科幻类排行榜)

这是第一页

第二页

第三页就不放了

得到一个规律start =(page-1)*20文章来源地址https://www.toymoban.com/news/detail-566432.html

import urllib.request

import urllib.parse

# 用函数封装

# 下载豆瓣电影前10页的数据

def create_request(page):

base_url = 'https://movie.douban.com/j/chart/top_list?type=17&interval_id=100%3A90&action=&'

headers = {

'',

}

data = {

'start': (page - 1) * 20,

'limit': 20

}

data = urllib.parse.urlencode(data)

url = base_url + data

# 请求对象定制

request = urllib.request.Request(url, headers=headers)

return request

# 获取响应数据

def get_content(request):

response = urllib.request.urlopen(request)

content = response.read().decode('utf-8')

return content

# 下载数据

def down_load(page, content):

with open('douban' + str(page) + '.json', 'w', encoding='utf-8') as fp:

fp.write(content)

if __name__ == '__main__':

start_page = 1

end_page = 10

for page in range(start_page, end_page+1):

request = create_request(page)

content = get_content(request)

down_load(page, content)

到了这里,关于Python爬虫——urllib_ajax的get请求爬取豆瓣电影前十页的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[Python练习]使用Python爬虫爬取豆瓣top250的电影的页面源码](https://imgs.yssmx.com/Uploads/2024/02/797225-1.png)

![python爬取豆瓣电影排行前250获取电影名称和网络链接[静态网页]————爬虫实例(1)](https://imgs.yssmx.com/Uploads/2024/01/415693-1.png)