-创建 Ceph 块存储系统 RBD 接口-

1、创建一个名为 rbd-demo 的专门用于 RBD 的存储池

ceph osd pool create rbd-demo 64 64

2、将存储池转换为 RBD 模式

ceph osd pool application enable rbd-demo rbd

3、初始化存储池

rbd pool init -p rbd-demo # -p 等同于 --pool

4、创建镜像

rbd create -p rbd-demo --image rbd-demo1.img --size 10G

可简写为:

rbd create rbd-demo/rbd-demo2.img --size 10G

5、镜像管理

//查看存储池下存在哪些镜像

rbd ls -l -p rbd-demo

//查看镜像的详细信息

rbd info -p rbd-demo --image rbd-demo1.img

rbd image 'rbd-demo.img':

size 10 GiB in 2560 objects #镜像的大小与被分割成的条带数

order 22 (4 MiB objects) #条带的编号,有效范围是12到25,对应4K到32M,而22代表2的22次方,这样刚好是4M

snapshot_count: 0

id: 5fc98fe1f304 #镜像的ID标识

block_name_prefix: rbd_data.5fc98fe1f304 #名称前缀

format: 2 #使用的镜像格式,默认为2

features: layering, exclusive-lock, object-map, fast-diff, deep-flatten #当前镜像的功能特性

op_features: #可选的功能特性

flags:

//修改镜像大小

rbd resize -p rbd-demo --image rbd-demo1.img --size 20G

rbd info -p rbd-demo --image rbd-demo1.img

#使用 resize 调整镜像大小,一般建议只增不减,如果是减少的话需要加选项 --allow-shrink

rbd resize -p rbd-demo --image rbd-demo1.img --size 5G --allow-shrink

//删除镜像

#直接删除镜像

rbd rm -p rbd-demo --image rbd-demo2.img

或

rbd remove rbd-demo/rbd-demo2.img

#推荐使用 trash 命令,这个命令删除是将镜像移动至回收站,如果想找回还可以恢复

rbd trash move rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

rbd trash list -p rbd-demo

5fc98fe1f304 rbd-demo1.img

#还原镜像

rbd trash restore rbd-demo/5fc98fe1f304

rbd ls -l -p rbd-demo

6、Linux客户端使用

客户端使用 RBD 有两种方式:

●通过内核模块KRBD将镜像映射为系统本地块设备,通常设置文件一般为:/dev/rbd*

●另一种是通过librbd接口,通常KVM虚拟机使用这种接口。

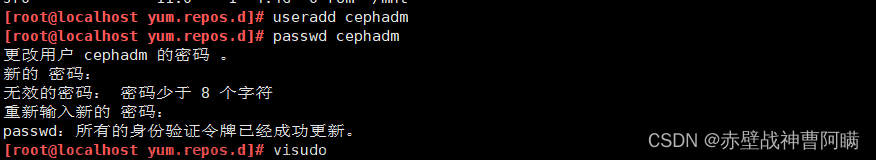

本例主要是使用Linux客户端挂载RBD镜像为本地磁盘使用。开始之前需要在所需要客户端节点上面安装ceph-common软件包,因为客户端需要调用rbd命令将RBD镜像映射到本地当作一块普通硬盘使用。并还需要把ceph.conf配置文件和授权keyring文件复制到对应的节点。

//在管理节点创建并授权一个用户可访问指定的 RBD 存储池

#示例,指定用户标识为client.osd-mount,对另对OSD有所有的权限,对Mon有只读的权限

ceph auth get-or-create client.osd-mount osd "allow * pool=rbd-demo" mon "allow r" > /etc/ceph/ceph.client.osd-mount.keyring

//修改RBD镜像特性,CentOS7默认情况下只支持layering和striping特性,需要将其它的特性关闭

rbd feature disable rbd-demo/rbd-demo1.img object-map,fast-diff,deep-flatten

//将用户的keyring文件和ceph.conf文件发送到客户端的/etc/ceph目录下

cd /etc/ceph

scp ceph.client.osd-mount.keyring ceph.conf root@client:/etc/ceph

//linux客户端操作

#安装 ceph-common 软件包

yum install -y ceph-common

#执行客户端映射

cd /etc/ceph

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

#查看映射

rbd showmapped

rbd device list

#断开映射

rbd unmap rbd-demo/rbd-demo1.img

#格式化并挂载

mkfs.xfs /dev/rbd0

mkdir -p /data/bb

mount /dev/rbd0 /data/bb

#在线扩容

在管理节点调整镜像的大小

rbd resize rbd-demo/rbd-demo1.img --size 30G

在客户端刷新设备文件

xfs_growfs /dev/rbd0 #刷新xfs文件系统容量

resize2fs /dev/rbd0 #刷新ext4类型文件系统容量

7、快照管理

对 rbd 镜像进行快照,可以保留镜像的状态历史,另外还可以利用快照的分层技术,通过将快照克隆为新的镜像使用。

//在客户端写入文件

echo 1111 > /data/bb/11.txt

echo 2222 > /data/bb/22.txt

echo 3333 > /data/bb/33.txt

//在管理节点对镜像创建快照

rbd snap create --pool rbd-demo --image rbd-demo1.img --snap demo1_snap1

可简写为:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap1

//列出指定镜像所有快照

rbd snap list rbd-demo/rbd-demo1.img

#用json格式输出:

rbd snap list rbd-demo/rbd-demo1.img --format json --pretty-format

//回滚镜像到指定

在回滚快照之前,需要将镜像取消镜像的映射,然后再回滚。

#在客户端

rm -rf /data/bb/*

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

#在管理节点操作,回滚

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1

#在客户端重新映射并挂载

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

mount /dev/rbd0 /data/bb

ls /data/bb #发现数据还原回来了

//限制镜像可创建快照数

rbd snap limit set <RDB存储池名>/<镜像名> --limit 3

#解除限制:

rbd snap limit clear <RDB存储池名>/<镜像名>

//删除快照

#删除指定快照:

rbd snap rm <RDB存储池名>/<镜像名>@<快照名>

#删除所有快照:

rbd snap purge <RDB存储池名>/<镜像名>

//快照分层

快照分层支持用快照的克隆生成新镜像,这种镜像与直接创建的镜像几乎完全一样,支持镜像的所有操作。唯一不同的是克隆镜像引用了一个只读的上游快照,而且此快照必须要设置保护模式。

#快照克隆

1)将上游快照设置为保护模式:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap666

rbd snap protect rbd-demo/rbd-demo1.img@demo1_snap666

2)克隆快照为新的镜像

rbd clone rbd-demo/rbd-demo1.img@demo1_snap666 --dest rbd-demo/rbd-demo666.img

rbd ls -p rbd-demo

3)命令查看克隆完成后快照的子镜像

rbd children rbd-demo/rbd-demo1.img@demo1_snap666

//快照展平

通常情况下通过快照克隆而得到的镜像会保留对父快照的引用,这时候不可以删除该父快照,否则会有影响。

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

#报错 snapshot 'demo1_snap666' is protected from removal.

如果要删除快照但想保留其子镜像,必须先展平其子镜像,展平的时间取决于镜像的大小

1) 展平子镜像

rbd flatten rbd-demo/rbd-demo666.img

2)取消快照保护

rbd snap unprotect rbd-demo/rbd-demo1.img@demo1_snap666

3)删除快照

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

rbd ls -l -p rbd-demo #在删除掉快照后,查看子镜像依然存在

8、镜像的导出导入

//导出镜像

rbd export rbd-demo/rbd-demo1.img /opt/rbd-demo1.img

//导入镜像

#卸载客户端挂载,并取消映射

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

#清除镜像下的所有快照,并删除镜像

rbd snap purge rbd-demo/rbd-demo1.img

rbd rm rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

#导入镜像

rbd import /opt/rbd-demo1.img rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

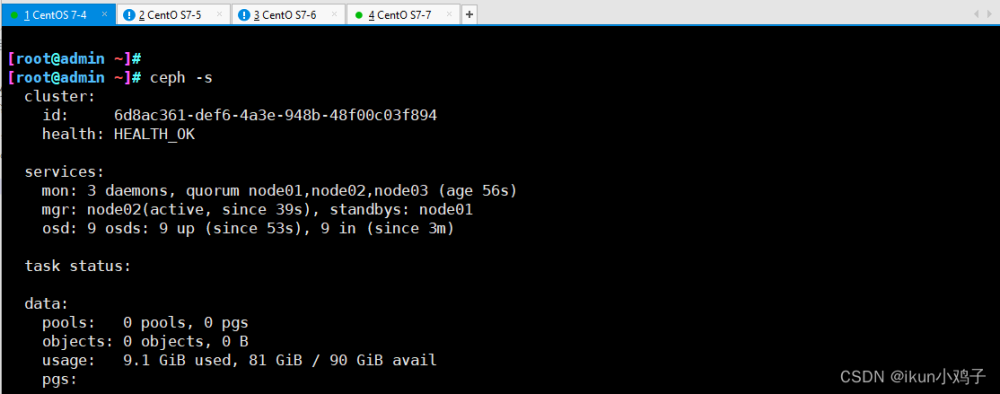

- OSD 故障模拟与恢复 -

1、模拟 OSD 故障

如果 ceph 集群有上千个 osd,每天坏 2~3 个太正常了,我们可以模拟 down 掉一个 osd

#如果 osd 守护进程正常运行,down 的 osd 会很快自恢复正常,所以需要先关闭守护进程

ssh root@node01 systemctl stop ceph-osd@0

#down 掉 osd

ceph osd down 0

ceph osd tree

2、将坏掉的 osd 踢出集群

//方法一:

#将 osd.0 移出集群,集群会开始自动同步数据

ceph osd out osd.0

#将 osd.0 移除 crushmap

ceph osd crush remove osd.0

#删除守护进程对应的账户信息

ceph auth rm osd.0

ceph auth list

#删掉 osd.0

ceph osd rm osd.0

ceph osd stat

ceph -s

//方法二:文章来源:https://www.toymoban.com/news/detail-578619.html

ceph osd out osd.0

#使用综合步骤,删除配置文件中针对坏掉的 osd 的配置

ceph osd purge osd.0 --yes-i-really-mean-it

3、把原来坏掉的 osd 修复后重新加入集群文章来源地址https://www.toymoban.com/news/detail-578619.html

#在 osd 节点创建 osd,无需指定名,会按序号自动生成

cd /etc/ceph

ceph osd create

#创建账户

ceph-authtool --create-keyring /etc/ceph/ceph.osd.0.keyring --gen-key -n osd.0 --cap mon 'allow profile osd' --cap mgr 'allow profile osd' --cap osd 'allow *'

#导入新的账户秘钥

ceph auth import -i /etc/ceph/ceph.osd.0.keyring

ceph auth list

#更新对应的 osd 文件夹中的密钥环文件

ceph auth get-or-create osd.0 -o /var/lib/ceph/osd/ceph-0/keyring

#加入 crushmap

ceph osd crush add osd.0 1.000 host=node01 #1.000 代表权重

#加入集群

ceph osd in osd.0

ceph osd tree

#重启 osd 守护进程

systemctl restart ceph-osd@0

ceph osd tree #稍等片刻后 osd 状态为 up

//如果重启失败

报错:

Job for ceph-osd@0.service failed because start of the service was attempted too often. See "systemctl status ceph-osd@0.service" and "journalctl -xe" for details.

To force a start use "systemctl reset-failed ceph-osd@0.service" followed by "systemctl start ceph-osd@0.service" again.

#运行

systemctl reset-failed ceph-osd@0.service && systemctl restart ceph-osd@0.service

到了这里,关于Ceph 块存储系统 RBD 接口的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!