前言

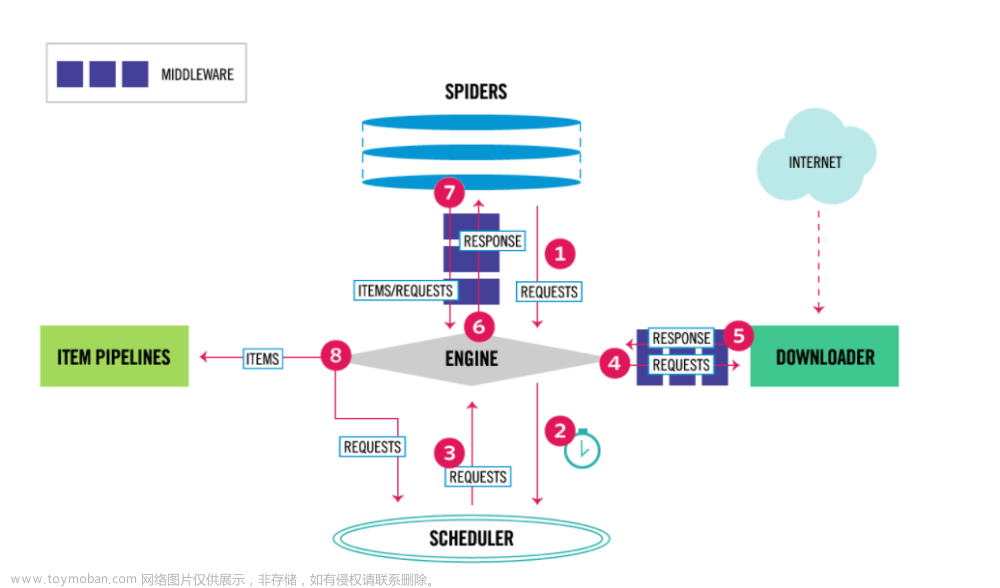

使用scrapy默认下载器---》类似于requests模块发送请求,不能执行js,有的页面拿回来数据不完整

想在scrapy中集成selenium,获取数据更完整,获取完后,自己组装成 Response对象,就会进爬虫解析,现在解析的是使用selenium拿回来的页面,数据更完整

使用

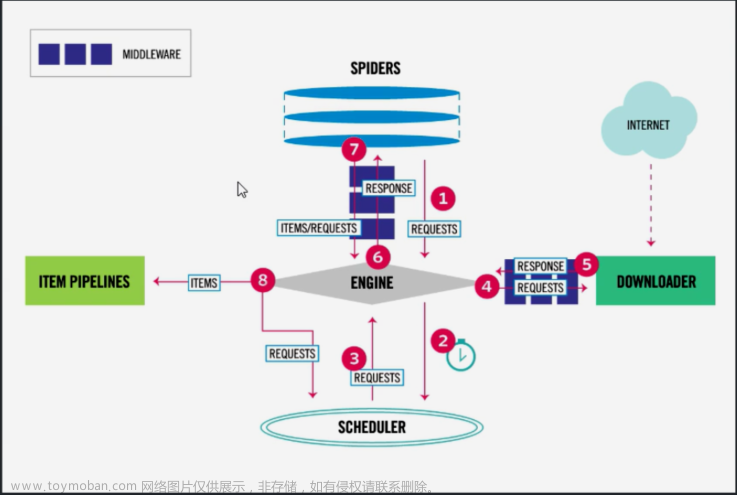

集成selenium 因为有的页面,是执行完js后才渲染完,必须使用selenium去爬取数据才完

保证整个爬虫中,只有一个浏览器

只要爬取 下一页这种地址,使用selenium,爬取详情,继续使用原来的

第一步:在爬虫类中写文章来源:https://www.toymoban.com/news/detail-581759.html

from selenium import webdriver

class CnblogsSpider(scrapy.Spider):

bro = webdriver.Chrome(executable_path='./chromedriver.exe')

bro.implicitly_wait(10)

def close(spider, reason):

spider.bro.close() #浏览器关掉第二步:在中间件中文章来源地址https://www.toymoban.com/news/detail-581759.html

def process_request(self, request, spider):

# 爬取下一页这种地址---》用selenium,但是文章详情,就用原来的

if 'sitehome/p' in request.url:

spider.bro.get(request.url)

from scrapy.http.response.html import HtmlResponse

response = HtmlResponse(url=request.url, body=bytes(spider.bro.page_source, encoding='utf-8'))

return response

else:

return None到了这里,关于scrapy集成selenium的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!