torch.cuda.amp.autocast() 是PyTorch中一种混合精度的技术,可在保持数值精度的情况下提高训练速度和减少显存占用。

混合精度是指将不同精度的数值计算混合使用来加速训练和减少显存占用。通常,深度学习中使用的精度为32位(单精度)浮点数,而使用16位(半精度)浮点数可以将内存使用减半,同时还可以加快计算速度。然而,16位浮点数的精度较低,可能导致数值下溢或溢出,从而影响训练结果。

torch.cuda.amp.autocast()能够自动将16位浮点数转换为32位浮点数进行数值计算,并在必要时将结果转换回16位浮点数。这种自动转换可以帮助避免数值下溢或溢出的问题,并在保持数值精度的同时提高计算速度和减少显存占用。

使用torch.cuda.amp.autocast()的过程如下:

- 将模型和数据移动到GPU上

- 使用torch.cuda.amp.autocast()上下文管理器包装模型的前向传递和损失计算

- 使用scaler(即torch.cuda.amp.GradScaler对象)将反向传播的梯度缩放回16位

- 执行梯度更新

总结:混合精度是一种将低精度计算与高精度计算混合使用的技术,可以在保持数值精度的情况下提高训练速度和减少显存占用。

# 混合精度训练,如果在CPU环境中不起任何作用

with amp.autocast(enabled=scaler is not None):

pred = model(imgs)

问:什么叫错 数值下溢 / 溢出

答:数值下溢和数值溢出是指在数值计算中,某个数值的绝对值太小或太大而无法被表示的情况。

数值下溢是指计算结果的绝对值小于机器能够表示的最小数,通常是由于计算结果太接近于零而导致的。在计算机中,数值通常以有限的二进制位表示,如果数值太小,那么在表示过程中会丢失精度,最终结果可能与真实结果相差很大,这种现象称为数值下溢。

数值溢出则是相反的情况,它是指计算结果的绝对值超过了机器能够表示的最大数,通常是由于计算结果太大而导致的。当计算机尝试用有限的二进制位表示超出其表示范围的数值时,会发生数值溢出,这会导致计算结果不准确或者无法表示。

在数值计算中,数值下溢和数值溢出都可能导致计算结果的不准确性,从而影响模型的训练效果。因此,处理这些数值问题是数值计算中的一个重要问题。常用的解决方法包括使用高精度算法、使用浮点数的科学计数法表示、使用数值截断等方法。

问:使用 torch.cuda.amp.autocast() 将数据 从32位(单精度) 转换为 16位(半精度),会导致精度丢失嘛?

答:使用 torch.cuda.amp.autocast() 将数据从32位(单精度)转换为16位(半精度)会导致精度损失。由于16位浮点数只能表示更少的有效位数,因此它们的精度不如32位浮点数。在混合精度训练中,为了平衡精度和性能,通常会将网络的前向传播和反向传播过程中的参数和梯度计算使用半精度浮点数来加速计算。这种方法可以在一定程度上降低计算精度要求,但会带来一定的精度损失。文章来源:https://www.toymoban.com/news/detail-587425.html

尽管存在精度损失,使用半精度浮点数的优点在于它们可以显著降低计算时间和显存消耗,从而使模型可以在更大的批量下进行训练,提高训练效率。此外,在实际应用中,对于某些任务,半精度精度的计算误差对于结果的影响可能不是很大,因此,半精度计算可以在保证结果准确性的前提下,大幅度提高模型的训练速度和效率。文章来源地址https://www.toymoban.com/news/detail-587425.html

到了这里,关于【混合精度训练】 torch.cuda.amp.autocast()的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

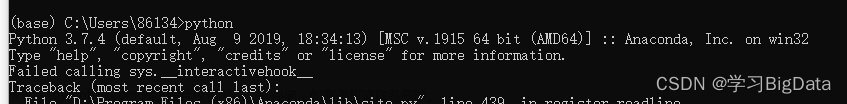

![[pytorch] torch.cuda.is_available() False 解决方法](https://imgs.yssmx.com/Uploads/2024/01/402023-1.png)