直接连接遇到的问题

直接运行下面的代码,会出现权限不够的问题

@Test

public void test1() throws Exception{

//指定NameNode地址

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://192.168.157.111:9000");

//创建一个HDFS的客户端 DistributedFileSystem

FileSystem client = FileSystem.get(conf);

//创建目录

client.mkdirs(new Path("/folder1"));

//关闭客户端

client.close();

}

错误:

org.apache.hadoop.security.AccessControlException: Permission denied: user=lenovo, access=WRITE, inode=“/folder1”:root:supergroup:drwxr-xr-x

下面使用四种方式来解决权限不够的问题。

设置执行的用户为root用户

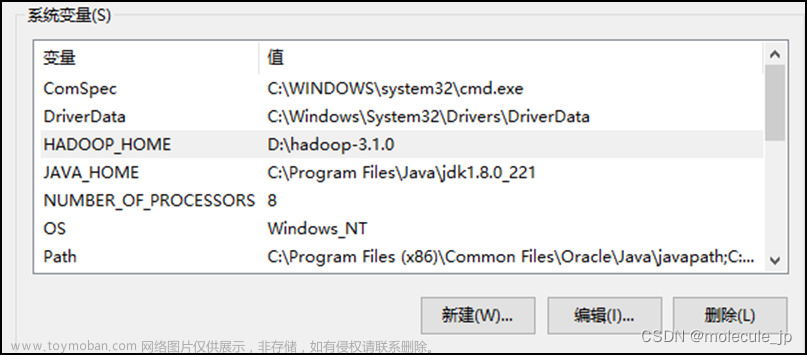

环境变量 :HADOOP_USER_NAME

@Test

public void test3() throws Exception{

System.setProperty("HADOOP_USER_NAME", "root");

//指定NameNode地址

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://192.168.157.111:9000");

//创建一个HDFS的客户端 DistributedFileSystem

FileSystem client = FileSystem.get(conf);

//创建目录

client.mkdirs(new Path("/folder1"));

//关闭客户端

client.close();

}

使用Java的-D参数来设置环境变量

@Test

public void test2() throws Exception{

//指定NameNode地址

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://192.168.157.111:9000");

//创建一个HDFS的客户端 DistributedFileSystem

FileSystem client = FileSystem.get(conf);

//创建目录

client.mkdirs(new Path("/folder1"));

//关闭客户端

client.close();

}

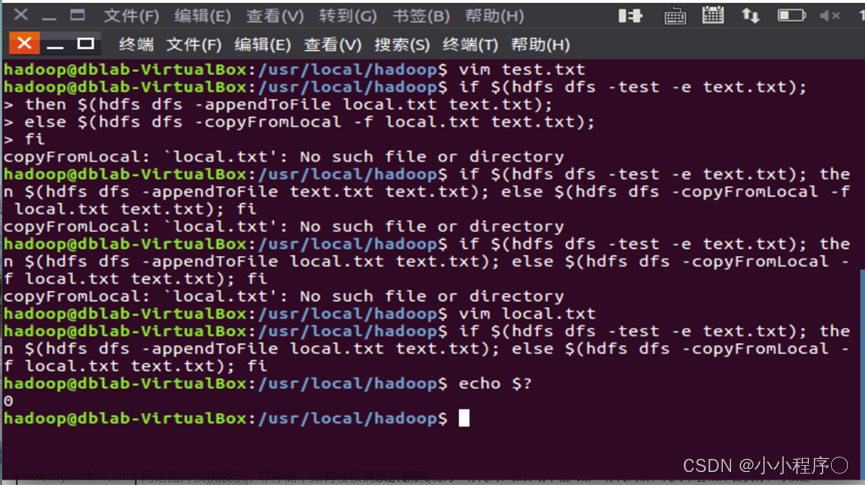

根据下面的步骤使用Java的-D参数

使用chmod的命令赋予权限

在linux上, 执行 hdfs dfs -chmod 777 /folder2

将读写执行的权限都给到/folder2

@Test

public void test4() throws Exception{

//指定NameNode地址

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://192.168.157.111:9000");

//创建一个HDFS的客户端 DistributedFileSystem

FileSystem client = FileSystem.get(conf);

//创建目录

client.mkdirs(new Path("/folder2/folder3"));

//关闭客户端

client.close();

}

修改参数配置

先停止HDFS

进入HADOOP_HOME/etc/hadoop路径,编辑hdfs-site.xml文件

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

文章来源:https://www.toymoban.com/news/detail-599582.html

文章来源:https://www.toymoban.com/news/detail-599582.html

保存后再启动HDFS,但注意在启动后,等待一段时间在去进行操作,因为HDFS启动的时候有一段时间是安全模式,所以在安全模式下是操作不了HDFS的。文章来源地址https://www.toymoban.com/news/detail-599582.html

到了这里,关于【hadoop】Java API连接(操作)HDFS的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!