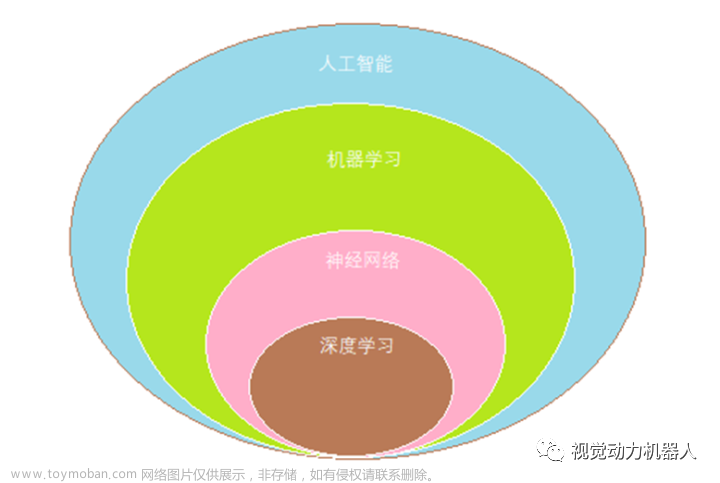

机器学习是人工智能的一个重要分支,根据学习任务的不同,可以将机器学习分为以下几类:

-

监督学习(Supervised Learning):

- 应用场景:监督学习适用于已标记数据集的任务,其中每个样本都有相应的标签或输出。常见的应用场景包括分类和回归问题。例如,垃圾邮件分类、图像识别、房价预测等。

-

无监督学习(Unsupervised Learning):

- 应用场景:无监督学习用于未标记数据集的任务,目标是从数据中发现模式、聚类和降维。应用场景包括聚类、异常检测、特征学习等。例如,用户分群、图像分割、数据降维等。

-

半监督学习(Semi-Supervised Learning):

- 应用场景:半监督学习是介于监督学习和无监督学习之间的学习方式,它结合了标记和未标记数据来提高模型性能。应用场景包括利用未标记数据进行标记样本扩充,提高模型泛化能力。

-

强化学习(Reinforcement Learning):

- 应用场景:强化学习是一种通过试错来学习决策和行为的方法。它在环境中执行动作,通过观察反馈信号来调整策略,从而最大化累积奖励。应用场景包括智能游戏玩家、自动驾驶汽车等。

-

迁移学习(Transfer Learning):

- 应用场景:迁移学习利用已学习的知识来帮助新任务的学习。在目标任务数据较少时,从一个相关的源任务中迁移已学到的知识,以加快模型训练和提高性能。

-

生成式学习(Generative Learning):

- 应用场景:生成式学习是一类生成新样本的学习方法,它可以用于生成文本、图像、音频等。应用场景包括图像生成、语言模型、音乐合成等。

-

增强学习(Meta Learning):文章来源:https://www.toymoban.com/news/detail-602722.html

- 应用场景:增强学习是一种用于学习学习算法或优化算法的学习方法。它可用于优化神经网络超参数、自动机器学习等。

每种类型的机器学习都有其独特的应用场景和优势。在实际应用中,通常需要根据任务的需求和数据的特点选择适当的学习方法。当涉及到不同类型的机器学习,以下是各类机器学习的一些示例和应用场景:

-

监督学习(Supervised Learning):

- 分类:垃圾邮件分类、手写数字识别、疾病诊断、情感分析等。

- 回归:房价预测、销售预测、股票价格预测等。

-

无监督学习(Unsupervised Learning):

- 聚类:用户分群、图像分割、新闻主题提取等。

- 降维:数据可视化、图像压缩、特征提取等。

-

半监督学习(Semi-Supervised Learning):

- 图像分类:使用未标记图像进行训练,提高图像分类性能。

- 文本分类:使用未标记的文本数据进行标记样本扩充,提高文本分类模型性能。

-

强化学习(Reinforcement Learning):

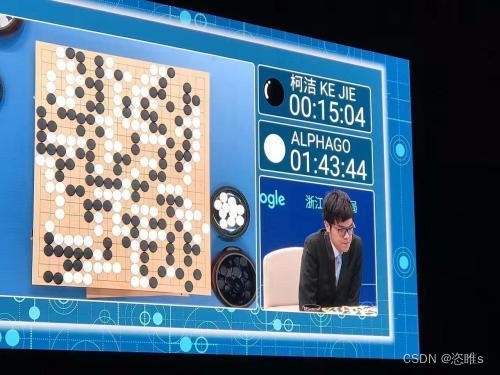

- 游戏玩家:AlphaGo在围棋、AlphaZero在象棋等游戏中表现出色。

- 自动驾驶:训练智能汽车通过强化学习来学习驾驶决策。

-

迁移学习(Transfer Learning):

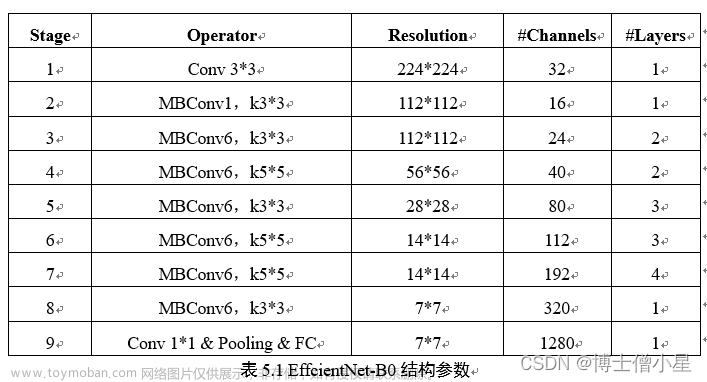

- 图像识别:使用在大规模图像数据集上预训练的卷积神经网络,然后在特定任务上进行微调。

- 自然语言处理:使用预训练的语言模型进行文本分类、命名实体识别等任务。

-

生成式学习(Generative Learning):

- 图像生成:GANs用于生成逼真的图像样本,如人脸生成、艺术图像创作等。

- 语言模型:使用RNN或Transformer进行文本生成、机器翻译等任务。

-

增强学习(Meta Learning):

- 超参数优化:使用增强学习来优化神经网络的超参数选择,以提高模型性能。

- 自动机器学习:自动选择合适的学习算法、特征工程、模型架构等。

这些示例展示了不同类型的机器学习在各种实际应用中的广泛用途。机器学习技术在许多领域都取得了显著的进展,并持续推动着人工智能的发展。文章来源地址https://www.toymoban.com/news/detail-602722.html

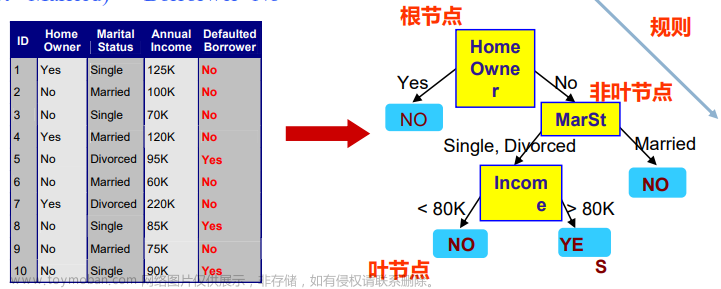

几种经典算法的比较

| 算法 | 优点 | 缺点 | 应用场景 | 技术原理 | 步骤 |

|---|---|---|---|---|---|

| SVM | 1. 适用于高维数据和特征较少的情况 2. 可有效处理非线性问题 3. 对于小样本数据集表现良好 4. 通过使用核函数可以处理非线性分类问题 |

1. 对于大规模数据集需要较长的训练时间 2. 需要仔细选择合适的核函数和参数 3. 对于噪声较多的数据敏感 |

图像分类、文本分类、生物信息学、金融分析等 | 基于支持向量和间隔最大化的原理进行分类 | 1. 数据预处理 2. 选择合适的核函数和参数 3. 训练SVM模型 4. 对新样本进行预测 |

| 决策树 | 1. 直观且易于理解和解释 2. 可处理数值型和类别型数据 3. 对缺失值和异常值有较好的容忍度 4. 可用于分类和回归问题 |

1. 容易出现过拟合问题 2. 对输入数据的变化较敏感 3. 生成的树可能较复杂 |

医学诊断、金融风险评估、客户分类等 | 根据特征选择最佳划分的标准构建决策树 | 1. 数据预处理 2. 特征选择和树构建 3. 剪枝操作 4. 对新样本进行预测 |

| 朴素贝叶斯 | 1. 算法简单、易于实现 2. 对大规模数据集有较好的可扩展性 3. 对缺失数据不敏感 |

1. 假设特征之间相互独立,可能导致模型过于简化 2. 对输入数据的分布假设限制较强 |

文本分类、垃圾邮件过滤、情感分析等 | 基于贝叶斯定理和特征条件独立性的假设进行分类 | 1. 数据预处理 2. 计算类别和特征的概率 3. 对新样本进行预测 |

| 聚类 | 1. 无需标记的数据集可以进行分组 2. 可发现数据内在的结构和模式 3. 对异常值具有较好的容忍度 |

1. 需要选择合适的距离度量和聚类算法 2. 对初始聚类中心的选择敏感 3. 结果可能受到数据噪声的影响 |

市场细分、图像分割、推荐系统等 | 根据数据间的相似性将样本划分为不同的聚类 | 1. 数据预处理 2. 选择合适的距离度量和聚类算法 3. 初始化聚类中心 4. 迭代更新聚类中心和样本分类 5. 输出聚类结果 |

到了这里,关于机器学习小记-序的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!