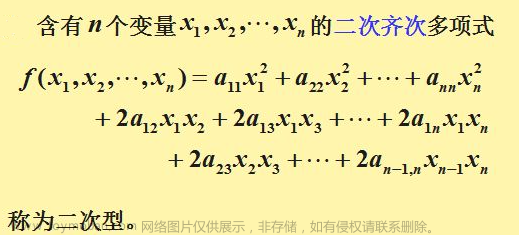

设矩阵

A

A

A的第

i

i

i大特征值为

λ

i

\lambda_i

λi, 对应特征向量

v

i

v_i

vi,

A

=

A

H

A=A^H

A=AH 求:

∇

A

λ

i

=

∂

λ

i

∂

A

∗

\nabla_A\lambda_i=\frac{\partial \lambda_i}{\partial A^*}

∇Aλi=∂A∗∂λi

目标: 写出

d

λ

i

=

t

r

(

B

d

A

H

)

d\lambda_i=tr(BdA^H)

dλi=tr(BdAH)

则有

∇

A

λ

i

=

B

\nabla_A\lambda_i=B

∇Aλi=B。文章来源:https://www.toymoban.com/news/detail-604366.html

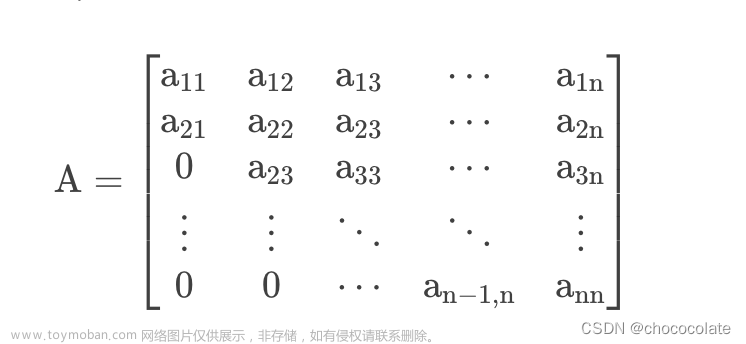

根据特征值定义:

A

v

i

=

λ

i

v

i

,

v

i

H

v

i

=

1

Av_i=\lambda_iv_i, v_i^Hv_i=1

Avi=λivi,viHvi=1

有:

d

(

A

v

1

)

=

d

A

∗

v

1

+

A

d

v

i

=

d

(

λ

i

v

i

)

=

d

λ

i

∗

v

i

+

λ

i

(

d

v

i

)

(1)

d(Av_1)=dA * v_1 + Adv_i =d(\lambda_iv_i)=d\lambda_i *v_i +\lambda_i (dv_i)\tag{1}

d(Av1)=dA∗v1+Advi=d(λivi)=dλi∗vi+λi(dvi)(1)

以及:

d

(

v

i

H

v

i

)

=

d

(

1

)

=

0

=

2

v

i

H

d

v

i

⇒

v

i

H

d

v

i

=

0

d(v_i^Hv_i)=d(1)=0=2v_i^Hdv_i\Rightarrow v_i^Hdv_i =0

d(viHvi)=d(1)=0=2viHdvi⇒viHdvi=0

将式(1)左右左乘

v

i

H

v_i^H

viH, 得到:

v

i

H

(

d

A

)

v

i

+

v

i

H

A

d

v

i

=

v

i

H

(

d

λ

i

)

v

i

+

v

i

H

λ

i

(

d

v

i

)

v_i^H(dA)v_i +v_i^HAdv_i=v_i^H(d\lambda_i)v_i+v_i^H\lambda_i(dv_i)

viH(dA)vi+viHAdvi=viH(dλi)vi+viHλi(dvi)

而

v

i

H

A

=

λ

i

v

i

v_i^HA=\lambda_iv_i

viHA=λivi, 因此

v

i

H

A

d

v

i

=

0

v_i^HAdv_i=0

viHAdvi=0。 类似的,

v

i

H

λ

i

(

d

v

i

)

=

0

v_i^H\lambda_i(dv_i)=0

viHλi(dvi)=0。

因此:

v

i

H

(

d

A

)

v

i

=

v

i

H

(

d

λ

i

)

v

i

=

v

i

H

v

i

d

λ

i

=

d

λ

i

v_i^H(dA)v_i=v_i^H(d\lambda_i)v_i=v_i^Hv_id\lambda_i=d\lambda_i

viH(dA)vi=viH(dλi)vi=viHvidλi=dλi

因此

(

d

A

=

d

A

H

)

(dA = dA^H)

(dA=dAH)

d

λ

i

=

t

r

(

v

i

v

i

H

d

A

H

)

d\lambda_i = tr(v_iv_i^HdA^H)

dλi=tr(viviHdAH)

∇

A

λ

i

=

B

=

v

i

v

i

H

\nabla_A\lambda_i=B = v_iv_i^H

∇Aλi=B=viviH文章来源地址https://www.toymoban.com/news/detail-604366.html

到了这里,关于特征值求导推导的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!