题目:Patch-NetVLAD: Multi-Scale Fusion of Locally-Global Descriptorsfor Place Recognition

团队:澳大利亚昆士兰理工大学,电气工程与机器人学院和QUT机器人中心

解决的问题:克服视点和外观变化的双重问题

创新点:与现有局部关键点特征的固定空间邻域制度不同,我们的方法能够聚集和匹配在特征空间网格上定义的深度学习局部特征。进一步通过完整的特征空间引入一种具有互补尺度(块大小)的多尺度特征融合。

(1)提出一种基于多尺度Patch的NetVLAD算法,相比于原始的NetVLAD VPR召回率有了大幅度提升;

(2)提出一种加速多尺度Patch特征描述子计算的IntegralVLAD;

(3)提出一种快速图像间相似度评分方法

新概念:图像检索任务

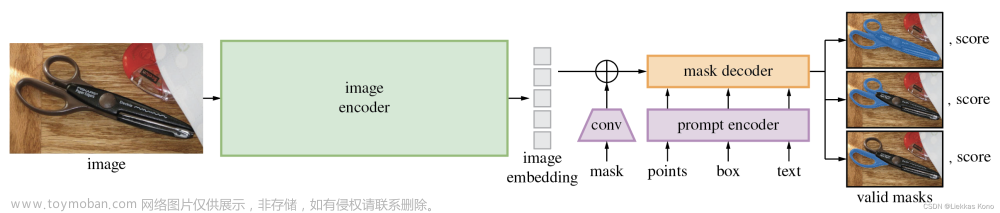

使用全局特征描述:使用查询图像和参考图像之间的最近邻搜索来执行;通常在对外观和光照变化的鲁棒性方面更胜一筹,因为它们直接被优化用于地点识别,通过基于深度学习的架构重新制定这些方法演化出NetVLAD。

针对感兴趣区域的局部特征描述:通常是交叉匹配的,然后是几何验证,局部描述子技术优先考虑空间精度,主要在像素级,使用固定大小的空间邻域来优化高精度的6自由度姿态估计

全局图像描述符:局部聚合描述符向量(VLAD)对局部关键点描述符进行聚合

局部关键点描述符:使用局部特征进行地点识别最常见的两种方法是:1)局部聚合获得全局图像描述符[49]; 2)图像对之间的局部描述符交叉匹配,如orb sift。

效果:对季节、结构和光照等外界条件,以及视点(平移和旋转)变化具有较高的不变性文章来源:https://www.toymoban.com/news/detail-604985.html

代码:https:// github.com/QVPR/Patch-NetVLAD 文章来源地址https://www.toymoban.com/news/detail-604985.html

到了这里,关于论文阅读笔记3:Patch-NetVLAD的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[论文阅读笔记18] DiffusionDet论文笔记与代码解读](https://imgs.yssmx.com/Uploads/2024/01/401181-1.png)