一、介绍

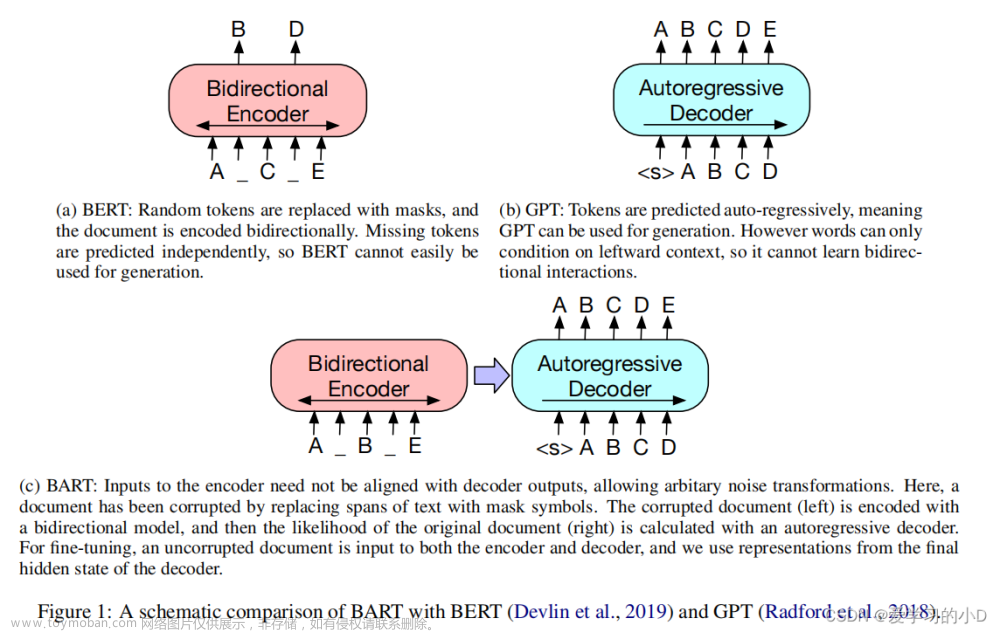

在这篇博文中,我将讨论像BERT,BART和T5这样的大型语言模型。到2020年,LLM领域取得的主要进展包括这些模型的开发。BERT和T5由Google开发,BART由Meta开发。我将根据这些模型的发布日期依次介绍这些模型的详细信息。在之前的博客文章自然语言处理的自回归模型中,我讨论了生成式预训练转换器的自回归性质。在这篇博客中,我将比较这些模型与自回归模型的不同之处。因此,如果您还没有查看上一篇文章,请去查看。BERT 论文于 2018 年发布,BART 于 2019 年发布,T5 于 2020 年发布。我将以相同的顺序介绍论文的细节。文章来源地址https://www.toymoban.com/news/detail-607430.html

二、变压器的双向编码器表示 (BERT)

文章来源:https://www.toymoban.com/news/detail-607430.html

到了这里,关于【NLP】BERT,BART和T5等LLM模型的比较的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!