- λ对Jcv和Jtrain的影响

- 假设该模型为四阶多项式

- 当λ很大时,在最小化J的过程中,w会很小且接近0,此时模型f(x)近似于一个常数,所以此时模型欠拟合,Jtrain和Jcv都很大

- 当λ很小时,表示模型几乎没有正则化,而四阶多项式的模型十分弯曲,所以此时模型过拟合,Jtrain很小,Jcv远大于Jtrain

- 当λ取中间值,模型刚好拟合良好、泛化良好,此时Jtrain很小、Jcv也很小

- 如何选择一个合适的λ

- 第一次,假设λ为0,最小化成本函数J后得到一组w、b,之后计算这组参数对应的Jcv

- 第二次,假设λ为0.01,最小化成本函数J后得到一组w、b,之后计算这组参数对应的Jcv

- …以此类推,例如:第十二次,假设λ为10…

- 通过这些不同λ对应的Jcv的值,来选择一个最小的Jcv对应的λ值,此时的λ为正则化参数的最佳值

- 此例中,如果第5次的Jcv最小,则我们选择第5次的λ、w、b,最后可以选择输出第5次的模型所对应的Jtest值,即该模型的test泛化能力

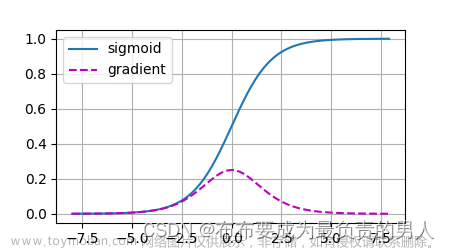

- λ如何影响Jtrain和Jcv

- λ对Jtrain和Jcv的影响如上图所示,此图近似看作d对Jtrain和Jcv的影响图的镜像,

- 通过最小Jcv,可以帮助选择一个合适的λ、d,从而帮助选择合适的模型(泛化良好、拟合良好)

文章来源地址https://www.toymoban.com/news/detail-613639.html

文章来源:https://www.toymoban.com/news/detail-613639.html

到了这里,关于机器学习 day30(正则化参数λ对模型的影响)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!